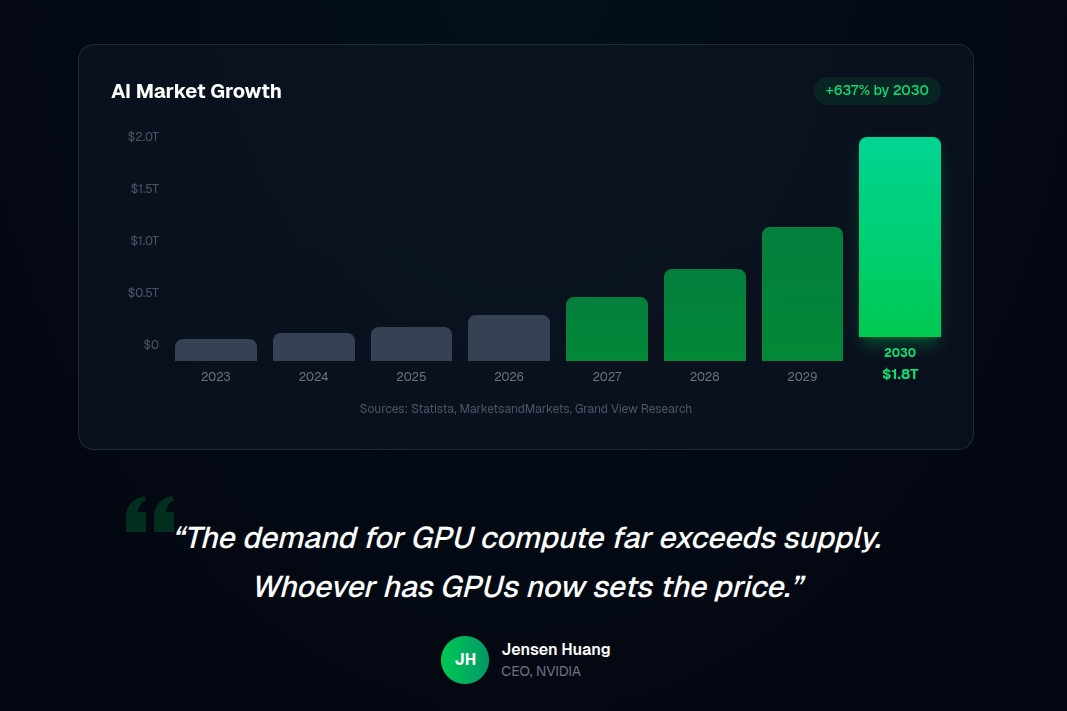

Der KI-Rechenleistungsengpass 2026: Warum der explosionsartige Token-Verbrauch AWS, Google Cloud und andere zu Preiserhöhungen zwingt

KI-Rechenleistungsengpass 2026: Token-Anstieg treibt Preiserhöhungen an

Anfang 2026 erreichte die KI-Branche einen Wendepunkt, den viele vorhergesagt, aber nur wenige vorbereitet hatten: Das Rechenkapazitätsangebot kann mit der Nachfrage nicht mehr Schritt halten.Die

Der Tokenverbrauch – die grundlegende Einheit zur Messung der tatsächlichen Nutzung von KI-Modellen – ist explosionsartig angestiegen. Dieser Anstieg treibt nun direkt die Kosten für die Anmietung von Rechenleistung in die Höhe. Im Januar 2026 erhöhte AWS stillschweigend die Preise für seine EC2-Kapazitätsblöcke für maschinelles Lernen um rund 15 %. Google Cloud zog mit der Ankündigung von Preiserhöhungen von bis zu 100 % für wichtige Netzwerkdienste ab dem 1. Mai 2026 nach. Chinesische Cloud-Anbieter prüfen derzeit offen ähnliche Preiserhöhungen.

Wenn Sie Inferenz in großem Umfang durchführen, Modelle trainieren oder einfach GPUs für KI-Workloads mieten, werden Ihre Cloud-Kosten bald deutlich steigen. Hier finden Sie alle Informationen dazu – sowie die neuen Lösungen, auf die zukunftsorientierte Entwickler bereits umsteigen.

Die Token-Konsumexplosion: Von Millionen auf Milliarden pro Tag

Noch vor drei Jahren verbrauchte ein intensiver KI-Nutzer vielleicht 5.000 bis 10.000 Token pro Tag. Heute verbrauchen Power-User mit agentenbasierten Workflows routinemäßig deutlich mehr. Millionen von Token täglich — eine Steigerung um das 50-fache.

Die Treiber sind klar: Intelligentere Modelle, autonome Agenten und Inferenz beanspruchen mittlerweile rund zwei Drittel der gesamten KI-Rechenleistung. Weltweit gibt es etwa eine Milliarde aktive LLM-Nutzer. Jeder zusätzliche Token verbraucht GPU-Zyklen, Speicher und Energie. Die Folge? Ein klassischer Angebotsengpass. Markt für KI-RechnervermietungDie

AWS erhöht die EC2-Kapazitätsblöcke für ML um ca. 15 % (Januar 2026)

Am oder um den 4./5. Januar 2026 erhöhte AWS:

- p5e.48xlarge: 34,61 $ → 39,80 $ pro Stunde (~15 %)

- Ähnliche Sprünge auf p5en-Instanzen

Die Preiserhöhungen von Google Cloud für CDN Interconnect- und Peering-Dienste zum 1. Mai 2026 (bis zu 100 % in einigen Regionen) verschärfen die Situation für datenintensive KI-Workloads zusätzlich.

Warum gerade jetzt? Der perfekte Sturm

Weltweite Engpässe bei HBM und DRAM, Energiebeschränkungen (KI-Rechenzentren werden voraussichtlich 2026 über 500 TWh verbrauchen) und Investitionen, die nicht schnell genug skaliert werden können, haben die angespannte Lage verursacht. Die Spotpreise für GPUs gaben Ende 2025 kurzzeitig nach, doch die reservierten, garantierten Kapazitäten verknappen sich wieder.

Neue Alternativen: AICCs einheitliche API + dezentraler Rechenmarkt

Während Hyperscaler die Preise erhöhen, entwickelt sich eine Plattform still und leise zum bevorzugten Ausweg für kostenbewusste Teams: AICC (AI.cc)Die

AICC hat sich von einem einfachen Anwendungsgebiet zu einem umfassenden KI-Ökosystem entwickelt, das die konkreten Schwachstellen der Rechenleistungskrise von 2026 direkt angeht:

1. Eine API – über 300 Modelle, 20–80 % geringere Kosten

Ändern Sie Ihre Basis-URL in https://api.ai.ccund behalten Sie das gleiche OpenAI-kompatible Format bei. Greifen Sie sofort auf über 300 Spitzenmodelle zu (GPT-5.2, Claude 4.5 Arbeit, Gemini 3, DeepSeek, ByteDance, Meta und Dutzende weitere).

Da AICC die Nachfrage einer riesigen globalen Nutzerbasis bündelt und auf einer leistungsstarken serverlosen Architektur läuft, liefert es 20–80 % Einsparungen im Gegensatz zum direkten Anruf bei den ursprünglichen Anbietern.

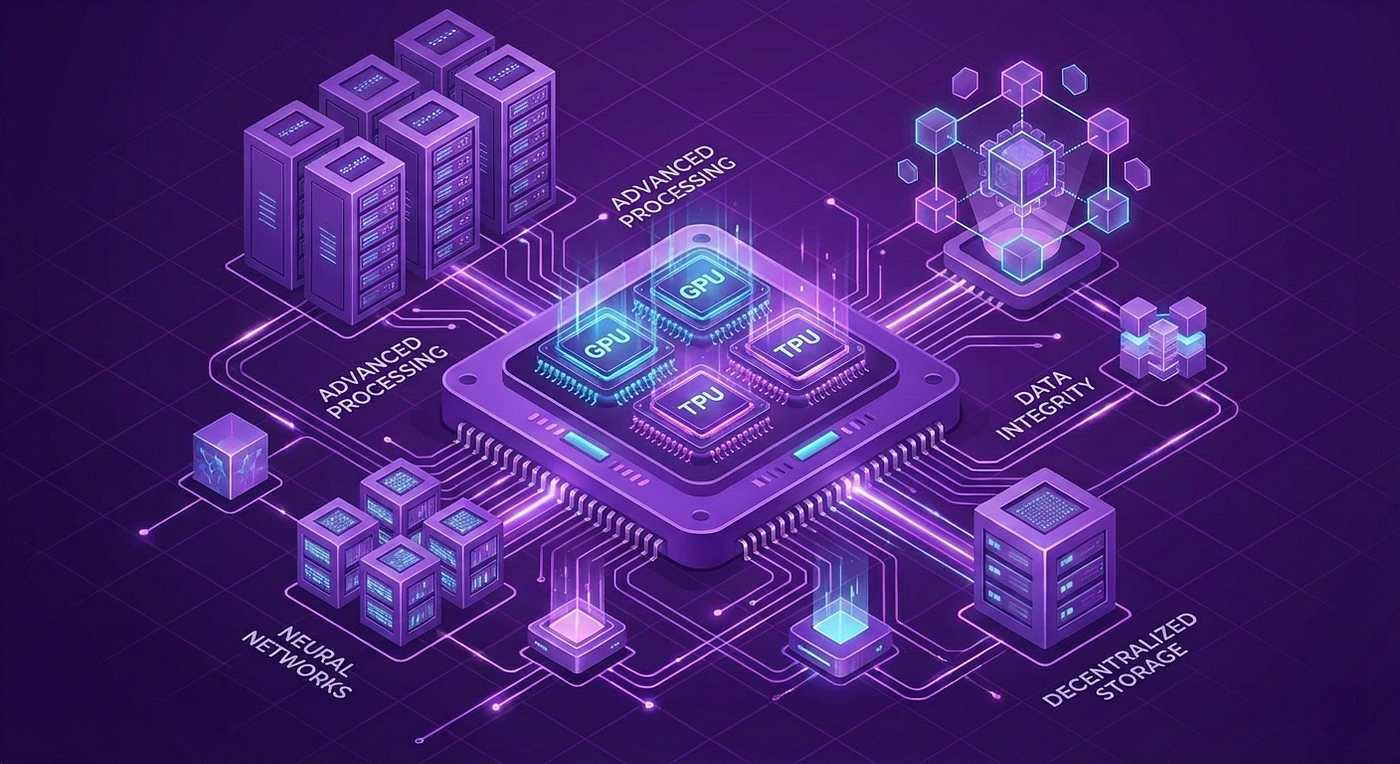

2. AICCTOKEN – Dezentrale Rechenleistung (DePIN), die tatsächlich funktioniert

Um die eigentliche Ursache – die extrem hohen, zentralisierten GPU-Kosten, die von AWS/Google kontrolliert werden – zu beheben, hat AICC das … ins Leben gerufen. AICCTOKEN Projekt.

- On-Demand-Verleih ohne teure Langzeitverträge

- Deutlich niedrigere Kosten als Hyperscaler reservierte Instanzen

- Antizensur und hohe Verfügbarkeit — kein einzelner Schwachpunkt

In einem Markt, in dem der Token-Konsum explosionsartig zunimmt und zentralisierte Anbieter die Preise erhöhen, bietet AICC eine Kombination aus einheitliche, kostengünstige Inferenz + dezentraler GPU-Marktplatz wird zur strategischen Absicherung, die jeder ernstzunehmende KI-Entwickler benötigt.

Was dies für KI-Entwickler und Unternehmen im Jahr 2026 bedeutet

Ihre Cloud-Kosten steigen um 10–25 % und mehr, wenn Sie nicht handeln. Teams, die bereits Teile ihrer Workloads zu AICC migrieren, berichten jedoch von sofortiger Entlastung: Geringere Betriebskosten durch Einsparungen bei der Aggregation, garantierte Kapazität dank DePIN und zukunftssichere Architektur.

Wie man sich wehrt: Praktische Strategien zur Kostenoptimierung

Schnelles Caching, kleinere Routing-Modelle, feste Token-Budgets.

Kritische Produktionsprozesse sollten auf Hyperscalern weiterlaufen, aber 30–70 % der Inferenz sollten über die One API von AICC geleitet werden, um sofort 20–80 % Kosten zu sparen.

Mix On-Demand + Spot + Reserviert + AICC DePIN. Monitoring mit plattformübergreifenden Tools.

Verhandeln Sie frühzeitig Unternehmensverträge und nutzen Sie den hochwertigen 7,3 Billionen Token umfassenden Korpus von AICC, wenn Sie Ihre eigenen Modelle trainieren.

Der Weg vor uns

Der Rechenleistungsengpass ist real und wird sich bis 2027 noch verschärfen. Die Zeiten, in denen die Cloud-Preise nur sanken, sind für KI-Workloads vorbei. Token-Konsum ist das neue Öl.

Die Gewinner werden aber nicht diejenigen sein, die einfach mehr an AWS und Google zahlen – sondern diejenigen, die die Zuverlässigkeit von Hyperscalern intelligent mit Plattformen wie … kombinieren. AICCDie

Fazit: Behandeln Sie die Rechenkosten als strategische Variable. Beginnen Sie diese Woche damit, den Datenverkehr über die One API von AICC zu leiten.

Seien Sie dem Druck einen Schritt voraus. Optimieren Sie frühzeitig – und diversifizieren Sie klug.

Einloggen

Einloggen