const { OpenAI } = require('openai');

const api = new OpenAI({

baseURL: 'https://api.ai.cc/v1',

apiKey: '',

});

const main = async () => {

const result = await api.chat.completions.create({

model: 'qwen3-235b-a22b-thinking-2507',

messages: [

{

role: 'system',

content: 'You are an AI assistant who knows everything.',

},

{

role: 'user',

content: 'Tell me, why is the sky blue?'

}

],

});

const message = result.choices[0].message.content;

console.log(`Assistant: ${message}`);

};

main();

const { OpenAI } = require('openai');

const api = new OpenAI({

baseURL: 'https://api.ai.cc/v1',

apiKey: '',

});

const main = async () => {

const result = await api.chat.completions.create({

model: 'qwen3-235b-a22b-thinking-2507',

messages: [

{

role: 'system',

content: 'You are an AI assistant who knows everything.',

},

{

role: 'user',

content: 'Tell me, why is the sky blue?'

}

],

});

const message = result.choices[0].message.content;

console.log(`Assistant: ${message}`);

};

main();

Produktdetails

Wir stellen Qwen3-Thinking vor: Eine leistungsstarke KI für komplexe Aufgaben

Qwen3-Denken stellt ein hochmodernes Text-zu-Text-KI-Modell dar, das sorgfältig für außergewöhnliche Leistung entwickelt wurde in komplexes Denken, vielfältig mehrsprachige Aufgabenund umfangreich Verarbeitung großer KontexteDurch die Nutzung der robusten Infrastruktur von Alibaba Cloud ist dieses Modell speziell für die Bewältigung komplexer Arbeitsabläufe optimiert, die tiefgreifende Analysefähigkeiten und intelligente Entscheidungsfindung erfordern.

Technische Spezifikationen und Leistung

🔧 Kern-Benchmarks:

- Kontextfenster: 131.000 Tokens – für ein tiefgreifendes Verständnis umfangreicher Inhalte.

- Aufgaben: Text-zu-Text-Generierung – vielseitig einsetzbar für eine Vielzahl von Anwendungen.

- Architektur: Basierend auf Transformer-Technologie, mit 235 Milliarden Parametern für beispiellose Intelligenz.

📈 Verbesserte Leistungskennzahlen:

Qwen3-Thinking bietet wesentliche Verbesserungen in Denkvermögen, wodurch in wichtigen Bereichen wie beispielsweise Logik, Mathematik und ProgrammierungDiese Version zeichnet sich zudem durch überlegene allgemeine Fähigkeiten aus, darunter die fortgeschrittene Befolgung von Anweisungen und die Generierung hochwertiger Texte. Ihre verfeinerte Langzeitkontextverständnis Die erweiterte „Denkzeit“ macht es zur optimalen Wahl für hochkomplexe Denkaufgaben.

🔎 Kernkompetenzen: Innovationsförderung

- Komplexes Denken: Löst mehrstufige logische Herausforderungen in Mathematik, Naturwissenschaften und Analytik mit außergewöhnlicher Präzision.

- Mehrsprachigkeit: Bietet flüssiges Verstehen und Generieren in 119 Sprachen und Dialekten, einschließlich anspruchsvoller Varianten aus ressourcenarmen Gebieten.

- Verarbeitung großer Kontexte: Kann Dokumente mit bis zu 131.000 Tokens analysieren und so eine effiziente Zusammenfassung, Wissensextraktion und umfassende Dokumentensynthese ermöglichen.

- Werkzeugintegration: Unterstützt nahtlos erweiterte Funktionsaufrufe und strukturierte JSON-Ausgabe für anspruchsvolle Automatisierung.

💰 API-Preisstruktur:

- Eingang: 0,2415 USD pro Million Token

- Ausgabe: 2,415 USD pro Million Token

💡 Optimale Anwendungsfälle: Wo Qwen3-Denken seine Stärken ausspielt

- Wissenschaftliche Forschung: Beschleunigung der Bearbeitung von Forschungsarbeiten, komplexe Dateninterpretation und rigorose Hypothesenprüfung.

- Mehrsprachige Anwendungen: Unterstützung von fortgeschrittenen Übersetzungsprozessen, der Erstellung sprachübergreifender Inhalte und präzisen Lokalisierungsmaßnahmen.

- Unternehmensanalysen: Herausarbeiten kritischer Erkenntnisse aus riesigen Mengen technischer Berichte, juristischer Verträge oder komplexer regulatorischer Dokumente.

- Ausbildung: Wir betreiben hochentwickelte Tutoringsysteme für Fächer wie Mathematik, Physik und fortgeschrittene Programmierung.

💻 Codebeispiel

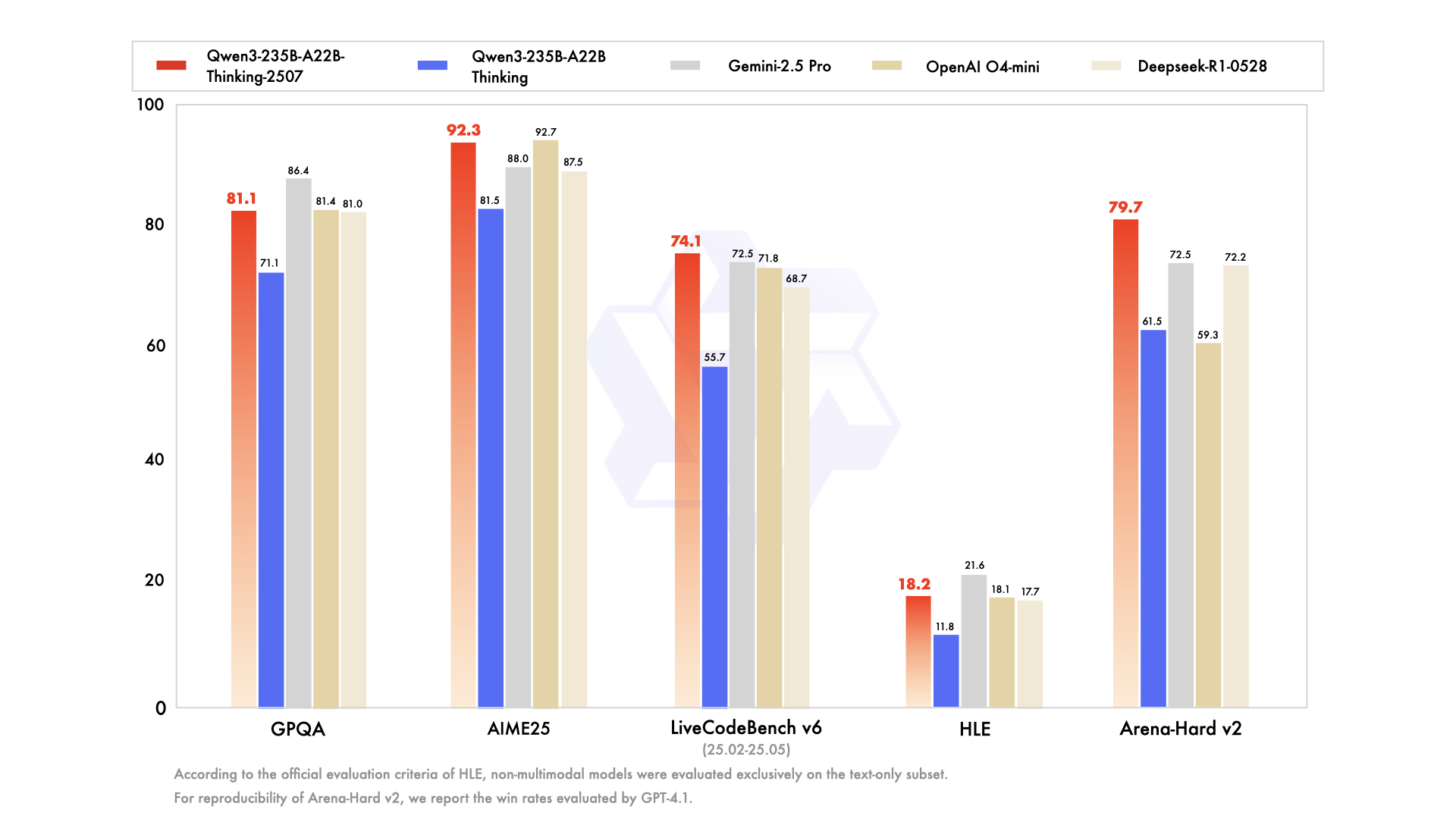

💬 Vergleich mit anderen führenden Modellen:

Vs. Claude 4 Opus

Qwen3-Denken legt Wert auf hohe Präzision bei komplexen Aufgaben mit einer beeindruckenden 256K Token-Kontextfenster (erweiterbar). Im Gegensatz dazu Claude 4 Arbeit zeichnet sich durch hohe Codierungsgenauigkeit und API-Automatisierung aus, bietet einen Token-Kontext von 200.000 und einen führenden SWE-Benchmark-Score von 72,5 % und ist damit ideal für stabile analytische und generative Aufgaben geeignet.

Im Vergleich zu Gemini 2.5 Flash

Während Qwen3-Denken zeichnet sich durch überlegene Unterstützung langer Kontexte und fortschrittliche agentenbasierte Arbeitsabläufe aus, Gemini 2.5 Blitz ist auf Geschwindigkeit und Kosteneffizienz optimiert und verfügt über einen Token-Kontext von 128K sowie ein SWE-Bench-Ergebnis von 63,8%.

Im Vergleich zu OpenAI o3-mini

Qwen3-Denken konzentriert sich auf die Beschleunigung agentenbasierter Arbeitsabläufe und den Einsatz intelligenter Werkzeuge. Im Gegensatz dazu OpenAI o3-mini Bewältigt effektiv allgemeine Aufgaben, unterstützt einen 128K-Token-Kontext und erreicht 69,1 % auf SWE-bench, mit dem Ziel, ein breiteres Anwendungsspektrum ohne tiefgreifende agentenbasierte Integration zu ermöglichen.

⚠ Einschränkungen: Wichtige Hinweise

Obwohl Qwen3-Thinking herausragende Fähigkeiten bietet, insbesondere bei der Verarbeitung langer Kontexte und der agentenbasierten Aufgabenausführung, erfordert seine Implementierung bedeutende Rechenressourcen und spezialisierter Infrastruktur. Wie andere große Modelle kann es bei neuartigen oder mehrdeutigen Aufgaben auf Herausforderungen stoßen und profitiert dabei stark von menschliche Beteiligung zur Qualitätskontrolle, Sicherheit und Ergebnisverifizierung. Die dem Modell inhärente Komplexität kann auch zu erhöhten BetriebskostenDie

ⓘ Häufig gestellte Fragen (FAQ)

Frage 1: Wozu ist Qwen3-Denken konzipiert?

Qwen3-Thinking ist ein fortschrittliches Text-zu-Text-KI-Modell, das für komplexes Denken, mehrsprachige Aufgaben und die Verarbeitung großer Kontexte optimiert ist und sich besonders für komplizierte Arbeitsabläufe eignet, die tiefgreifende analytische Fähigkeiten erfordern.

Frage 2: Was ist das maximale Kontextfenster, das Qwen3-Thinking verarbeiten kann?

Qwen3-Thinking unterstützt ein großes Kontextfenster von bis zu 131.000 Tokens und ermöglicht so die Analyse umfangreicher Dokumente zur Zusammenfassung, Wissensextraktion und Synthese.

Frage 3: Wie schlägt sich Qwen3-Thinking in mehrsprachigen Szenarien?

Das Modell zeichnet sich durch hohe Mehrsprachigkeit aus und beherrscht 119 Sprachen und Dialekte, darunter auch verschiedene Dialekte aus ressourcenarmen Gebieten, wodurch es sich hervorragend für globale Anwendungen eignet.

Frage 4: Was sind die Hauptvorteile der Verwendung von Qwen3-Thinking für komplexe Denkaufgaben?

Es bietet deutliche Verbesserungen der Denkfähigkeit in den Bereichen Logik, Mathematik und Programmierung, kombiniert mit einem verbesserten Verständnis des Langzeitkontexts, wodurch es sich ideal für hochkomplexe mehrstufige Probleme und analytische Aufgaben eignet.

Frage 5: Was sind die größten Einschränkungen des Qwen3-Denkens?

Zu den Hauptbeschränkungen gehören der Bedarf an erheblichen Rechenressourcen und spezialisierter Infrastruktur, potenzielle Schwierigkeiten bei extrem neuartigen Aufgaben sowie höhere Betriebskosten aufgrund der Komplexität und des Umfangs.

KI-Spielplatz

Einloggen

Einloggen.webp)