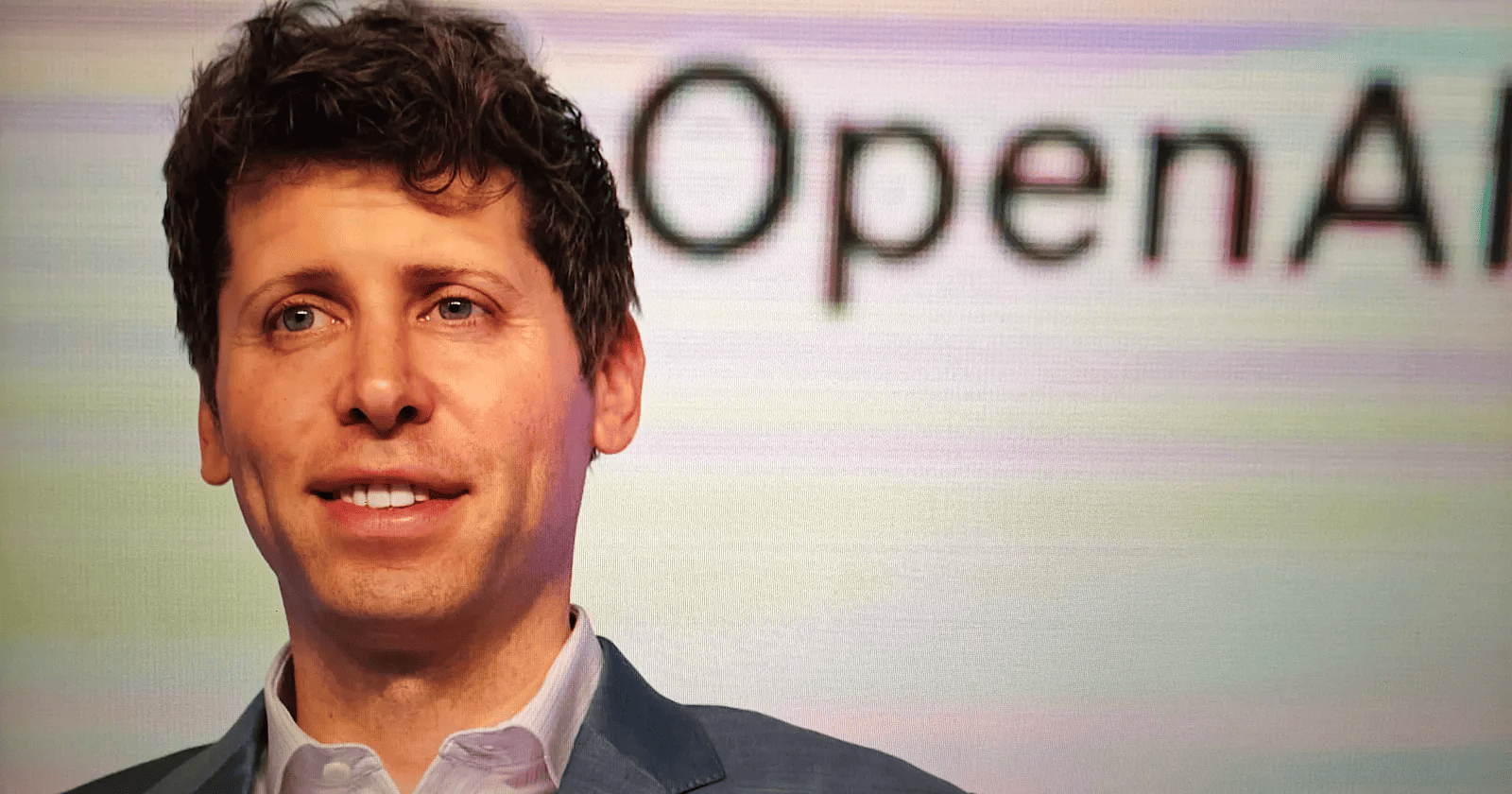

OpenAI发布面向开发者的开源权重AI安全模型

2025-12-28 由 AICC 提供

OpenAI 该公司通过发布其新型“保障”模型的研究预览版,在人工智能治理方面取得了重大进展。 gpt-oss-safeguard 该系列产品代表着一项战略举措,旨在为开发者提供专门为高度可定制的内容分类和审核而设计的开源工具。

该版本包含两个主要版本:强大的版本 gpt-oss-safeguard-120b 而且更紧凑 gpt-oss-safeguard-20b.根据以下条款发布 Apache 2.0 许可证这些模型使组织能够根据自身独特的需求修改和部署安全框架,而无需克服限制性的许可障碍。

利用动态策略推理革新人工智能安全

与依赖于僵化的预训练规则的传统安全层不同,这些模型利用了 高级推理能力 在推断阶段解读开发者策略。根据原始报告, OpenAI 为开发者推出开源 AI 安全模型这样就允许采用“推理优先”的方法,开发人员可以完全控制安全框架。

开发者的主要优势:

- 提高透明度: 通过利用 思维链过程这些模型为每个分类决策提供了清晰的逻辑路径,摆脱了“黑箱”人工智能系统。

- 运营敏捷性: 安全策略并非永久固定在重量片上。开发人员可以 立即更新和迭代指南 无需进行昂贵或耗时的再培训周期。

赋能开源社区

这种转变使行业摆脱了“一刀切”式的审核方式。使用开源生态系统的开发者现在可以精准地执行自己的社区标准。这些模型将托管在…… 拥抱脸平台确保全球人工智能研究界能够广泛获取相关信息。

相关行业新闻: OpenAI 进行重组,开启与微软合作的“新篇章”。

登录

登录