const { OpenAI } = require('openai');

const api = new OpenAI({

baseURL: 'https://api.ai.cc/v1',

apiKey: '',

});

const main = async () => {

const result = await api.chat.completions.create({

model: 'deepseek/deepseek-reasoner-v3.1-terminus',

messages: [

{

role: 'system',

content: 'You are an AI assistant who knows everything.',

},

{

role: 'user',

content: 'Tell me, why is the sky blue?'

}

],

});

const message = result.choices[0].message.content;

console.log(`Assistant: ${message}`);

};

main();

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.ai.cc/v1",

api_key="",

)

response = client.chat.completions.create(

model="deepseek/deepseek-reasoner-v3.1-terminus",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices[0].message.content

print(f"Assistant: {message}")

Produktdetails

✨ DeepSeek V3.1 Terminus: Fortschrittliche hybride KI für logisches Denken

Der DeepSeek V3.1 Terminus stellt eine bedeutende Weiterentwicklung von KI-Modellen für hybrides logisches Denken im großen Maßstab dar und wurde sorgfältig für anspruchsvollste Aufgaben mit komplexen Denkketten entwickelt. Dieses Update der DeepSeek V3-Serie konzentriert sich auf die Bereitstellung beispielloser Ergebnisse. Stabilität, optimiert Agenten-/Tool-Workflowsund robust mehrstufige SchlussfolgerungsfähigkeitenEs ist eine ideale Lösung für komplexe Anwendungen wie fortgeschrittene Codierung, intuitive Webnavigation und Kommandozeilenautomatisierung, die leistungsstarke Modellkapazität nahtlos mit flexiblen Inferenzmodi verbindet.

⚙️ Technische Spezifikationen

- Modelltyp: Hybrides Mixture-of-Experts (MoE) großes Sprachmodell

- Gesamtparameter: 671 Milliarden

- Aktive Parameter pro Vorwärtsdurchlauf: 37 Milliarden

- Hybride Denkmodi: Unterstützt beides "Denkmodus" (komplexe interne Schlussfolgerungen, Werkzeugplanung) und "Nicht-Denkmodus" (schnellere direkte Antworten) innerhalb desselben Netzwerks.

- Kontextfenstergröße: Bis zu 128.000 Token, wodurch eine umfassende Kontextverarbeitung und ein längeres Denken ermöglicht werden.

- Agentenfunktionen: Verfügt über spezialisierte integrierte Agenten, darunter Code Agent, Search Agent, Browse Agent und Terminal Agent.

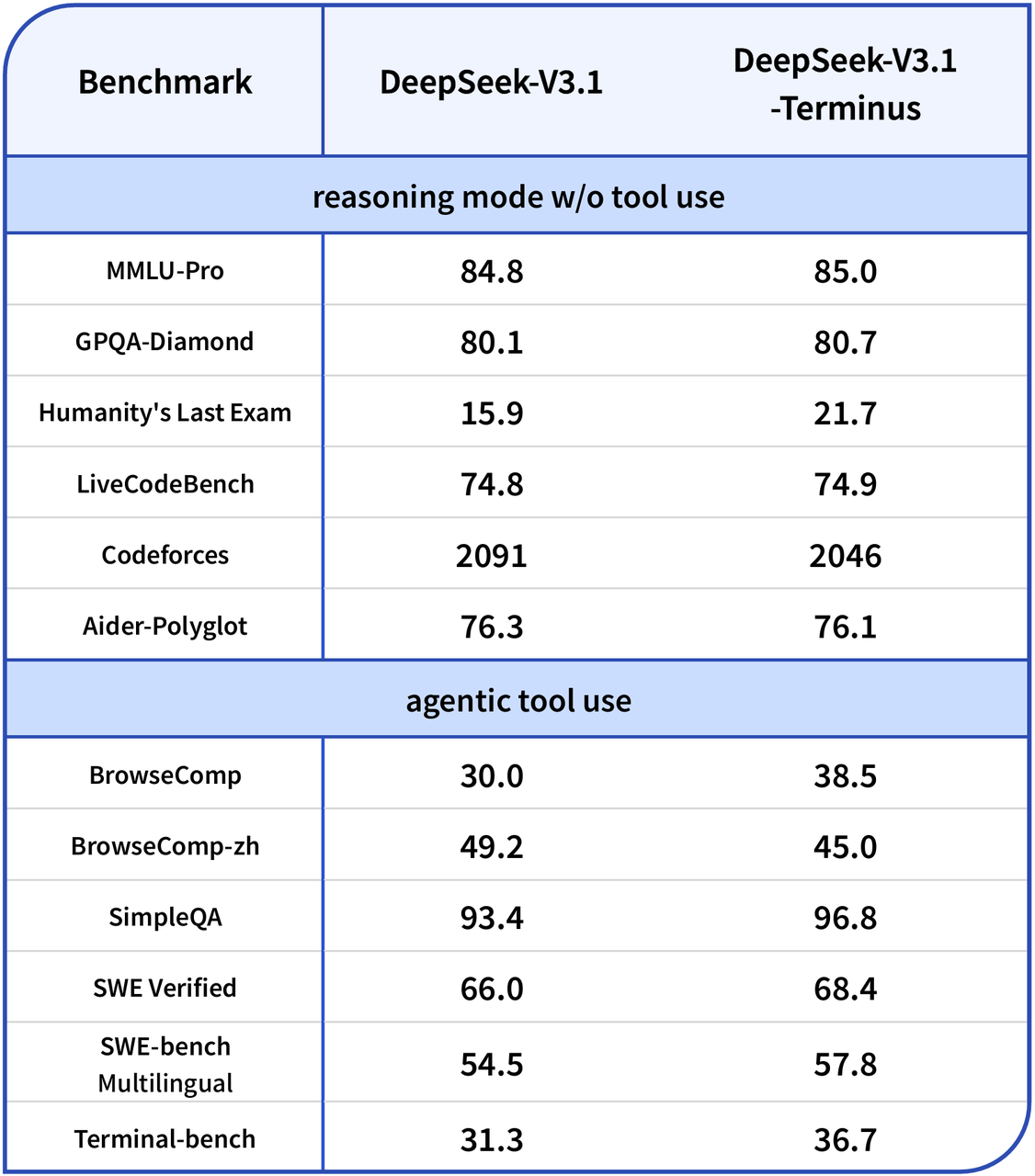

📊 Leistungsbenchmarks

- MMLU-Pro Reasoning: Verbessert von 84,8 auf 85,0 (Endstation)

- GPQA-Diamant: 80,7

- Die letzte Prüfung der Menschheit: Deutlicher Sprung von 15,9 auf 21,7

- LiveCodeBench: Marginaler Gewinn auf 74,9

- Codeforces-Wertung: Geringfügige Abweichungen um das Jahr 2046

- Software-Engineering-Verifizierung: Verbessert von 66,0 auf 68,4

🌟 Hauptmerkmale von DeepSeek V3.1 Terminus

- Großes Kontextfenster: Prozesse bis zu 128.000 Token, wodurch das Verständnis umfangreicher Dokumente und komplexer, mehrstufiger Schlussfolgerungen ermöglicht wird.

- Erweiterte Agentenintegration: Bietet optimierte, mehrstufige Agenten-Workflows mit überragender Zuverlässigkeit beim Tool-Aufruf, einschließlich spezialisierter Agenten für Codegenerierung, suchen, Durchsuchen, Und TerminalbetriebDie

- Effizienzverbesserungen: Erreicht eine bemerkenswerte 20–50 % Reduzierung bei durchschnittlichem Tokenverbrauch im Reasoning-Modus, und das alles bei gleichbleibender oder sogar verbesserter Ausgabequalität.

- Verbesserte Sprachkonsistenz: Minimiert deutlich Probleme mit zufälligen Zeicheneinfügungen und unerwünschter Sprachvermischung und sorgt so für durchgehend flüssigere und kohärentere Ausgaben.

- Überragende Codierungsleistung: Bietet fortschrittliche Codegenerierungsfunktionen, die die Erstellung komplexer Anwendungen und eine nahtlose Interaktion mit Game-Engines wie Godot ohne Build-Fehler ermöglichen.

💰 API-Preise

- 1 Million Input-Tokens: 0,294 $

- 1 Million Output-Token: 0,441 USD

🎯 Primäre Anwendungsfälle

- Komplex mehrstufige Denkaufgaben Erforderliche logische Ketten.

- Automatisiert Codierung und Unterstützung bei der Softwareentwicklung.

- Befehlszeilenautomatisierung und fortgeschrittene SkripterstellungDie

- Web-Scraping und anspruchsvoller Datenabruf via Browser-AgentenDie

- Anspruchsvolle Frage-Antwort-Runde, die ein umfassendes Kontextverständnis erfordert.

- Forschungssynthese und Zusammenfassung von lange DokumenteDie

💻 Codebeispiel

🔍 Vergleich mit anderen Modellen

vs GPT-4: GPT-4 wird für seine Vielseitigkeit und seine kreativen Ergebnisse gefeiert und zeichnet sich insbesondere durch sein allgemeines Denkvermögen und seine Dialogqualität aus. DeepSeek-Terminus zeichnet sich durch herausragende Leistungen aus in Agenten-Workflows und hocheffizient mehrstufiger Werkzeugaufruf, oft zu niedrigeren Tokenkosten.

vs Claude 4.1: Claude 4.1 ist bekannt für seine intuitive, kreative, mehrstufige Argumentation und die reibungslose Ausführung der Gedankengänge. DeepSeek-Terminus bietet eine gute Übereinstimmung in komplexen agentenbasierten Arbeitsabläufen, insbesondere dort, wo präzise Werkzeugintegration und explizit Planung sind von größter Bedeutung.

vs DeepSeek R1: Endpunkt bietet eine vergleichbare Argumentationsqualität, jedoch mit den zusätzlichen Vorteilen von schnellere Reaktionszeiten und reduziertem Output-Token-Verbrauch.

vs DeepSeek V3.1: Endpunkt verbessert die Sprachstabilität deutlich, beseitigt nahezu vollständig Zeichenfehler und optimiert die Gesamtleistung. Agenten-/Werkzeugkoordination für ein reibungsloseres Benutzererlebnis.

❓ Häufig gestellte Fragen (FAQ)

Frage 1: Was ist der Hauptfokus von DeepSeek V3.1 Terminus?

A1: DeepSeek V3.1 Terminus konzentriert sich in erster Linie auf die Verbesserung hybride Denkfähigkeiten für komplexe Gedankengänge, mit verbesserter Stabilität, optimierten Agenten-/Werkzeug-Workflows und zuverlässigem mehrstufigem Schließen über verschiedene Anwendungen hinweg.

Frage 2: Welchen Nutzen hat die Größe des Kontextfensters für die Nutzer?

A2: Mit einem beträchtlichen Kontextfenster von bis zu 128.000 TokenTerminus kann unglaublich lange Dokumente verarbeiten und komplexe Schlussfolgerungsketten aufrechterhalten, was für Recherchen, Zusammenfassungen und tiefgehende Analyseaufgaben unerlässlich ist.

Q3: Welche wesentlichen Effizienzgewinne bietet Terminus?

A3: Es bietet deutliche Effizienzverbesserungen und reduziert den durchschnittlichen Tokenverbrauch um 20%–50% im Denkmodus, wobei die Qualität der Ergebnisse im Vergleich zu früheren Versionen beibehalten oder sogar verbessert wird.

Q4: Kann DeepSeek V3.1 Terminus fortgeschrittene Codierungsaufgaben bewältigen?

A4: Ja, es beinhaltet überlegene Codierungsleistung, das in der Lage ist, komplexe Anwendungen zu generieren und reibungslos mit Game-Engines wie Godot zu interagieren, wodurch minimale Build-Fehler und eine robuste Funktionalität gewährleistet werden.

Frage 5: Was zeichnet Terminus in agentenbasierten Arbeitsabläufen aus?

A5: Terminus rühmt sich verbesserte Agentenintegration, wodurch optimierte, mehrstufige Agenten-Workflows und eine verbesserte Zuverlässigkeit beim Aufruf von Tools bereitgestellt werden, einschließlich spezialisierter Agenten für Codierung, Suche, Browsen und Terminaloperationen.

KI-Spielplatz

Einloggen

Einloggen