const { OpenAI } = require('openai');

const api = new OpenAI({

baseURL: 'https://api.ai.cc/v1',

apiKey: '',

});

const main = async () => {

const result = await api.chat.completions.create({

model: 'deepseek/deepseek-non-reasoner-v3.1-terminus',

messages: [

{

role: 'system',

content: 'You are an AI assistant who knows everything.',

},

{

role: 'user',

content: 'Tell me, why is the sky blue?'

}

],

});

const message = result.choices[0].message.content;

console.log(`Assistant: ${message}`);

};

main();

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.ai.cc/v1",

api_key="",

)

response = client.chat.completions.create(

model="deepseek/deepseek-non-reasoner-v3.1-terminus",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices[0].message.content

print(f"Assistant: {message}")

Détails du produit

✨ Chat DeepSeek V3.1 est un modèle d'IA conversationnelle hybride spécialisé axé sur réponses rapides et directes sans recourir à un raisonnement complexe. S'appuyant sur l'architecture DeepSeek V3.1, cette variante omet le mode de réflexion Elle privilégie les sorties à faible latence tout en conservant de solides capacités multimodales. Optimisée pour les applications nécessitant des interactions efficaces et directes entre le chat, la génération de code et les flux de travail des agents, elle convient aux développeurs et aux entreprises qui privilégient des temps de réponse rapides et une exécution des tâches simplifiée.

Spécifications techniques

- Fenêtre contextuelle jusqu'à 128 000 jetons pour prendre en charge les conversations et les sessions de codage prolongées à plusieurs tours de parole.

- Limite de jetons de sortie jusqu'à 8 000 jetons optimisé pour des réponses concises et cohérentes.

- Architecture de transformateur hybride avec Couches de mélange d'experts (MoE) pour une allocation de calcul efficace.

- Prend en charge les appels d'outils structurés, les fonctionnalités d'agent de code et les agents de recherche pour améliorer la flexibilité des tâches.

- Entraînement étendu sur des ensembles de données à contexte long utilisant la micro-échelle FP8 pour une efficacité d'inférence accrue.

- Assistance multilingue sur Plus de 100 langues avec une grande précision contextuelle.

Caractéristiques principales

🚀 DeepSeek V3.1 Chat fonctionne exclusivement dans un mode non-pensée qui livre réponses rapides et directes sans recourir à un raisonnement en plusieurs étapes. Cette configuration permet des possibilités extrêmement interactions à faible latence Parfaitement adapté aux requêtes simples et à l'exécution de tâches, ce modèle conserve des capacités avancées d'appel d'outils et d'agents, permettant une intégration fluide avec les agents de code et les agents de recherche pour des flux de travail polyvalents. Reposant sur une architecture de transformateur MoE optimisée, il assure une utilisation efficace des ressources tout en prenant en charge les appels de fonctions structurés pour une invocation précise des outils. Bien qu'il n'effectue pas de raisonnement complexe, il est idéal pour les conversations multimodales, la génération rapide de code et les flux de travail d'agents rationalisés nécessitant une sortie rapide et fiable.

Performances et capacités

- ⚡ Temps de réponse rapides avec une utilisation optimisée des outils et une surcharge de calcul minimale.

- Haute précision dans la génération directe de code et l'exécution des tâches avec de faibles taux d'erreur.

- Gestion efficace des entrées multimodales, notamment du texte et des images, axée sur des tâches ne nécessitant pas de raisonnement.

- Adaptable aux environnements d'ingénierie logicielle, d'assistance à la recherche et d'applications multi-agents.

Cas d'utilisation

- Assistance rapide en ingénierie logicielle, incluant la synthèse de code et le débogage.

- Chatbots multimodaux axés sur la compréhension d'images et de textes avec des réponses rapides.

- Recherche de routine et analyse de documents avec des exigences de contexte modérées.

- Dialogue efficace à plusieurs tours de parole, adapté aux outils pédagogiques de base axés sur les tâches.

- Processus de veille stratégique axés sur l'interprétation rapide des données visuelles.

- Applications multi-agents nécessitant des appels d'outils intelligents sans surcharge de raisonnement complexe.

Tarification de l'API

• 1 million de jetons d'entrée : 0,294 $

• 1 million de jetons de sortie : 0,441 $

Exemple de code

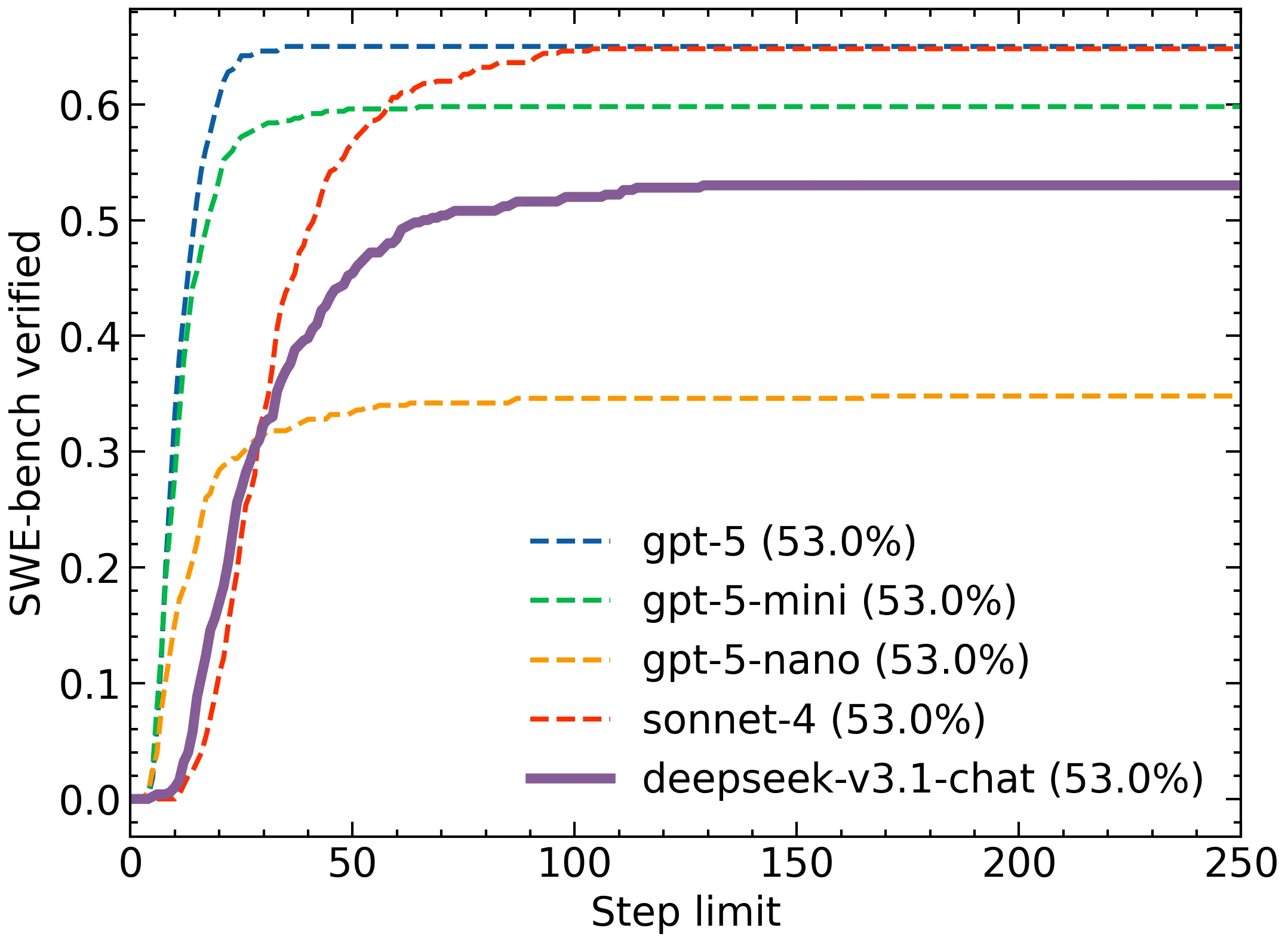

Comparaison avec d'autres modèles

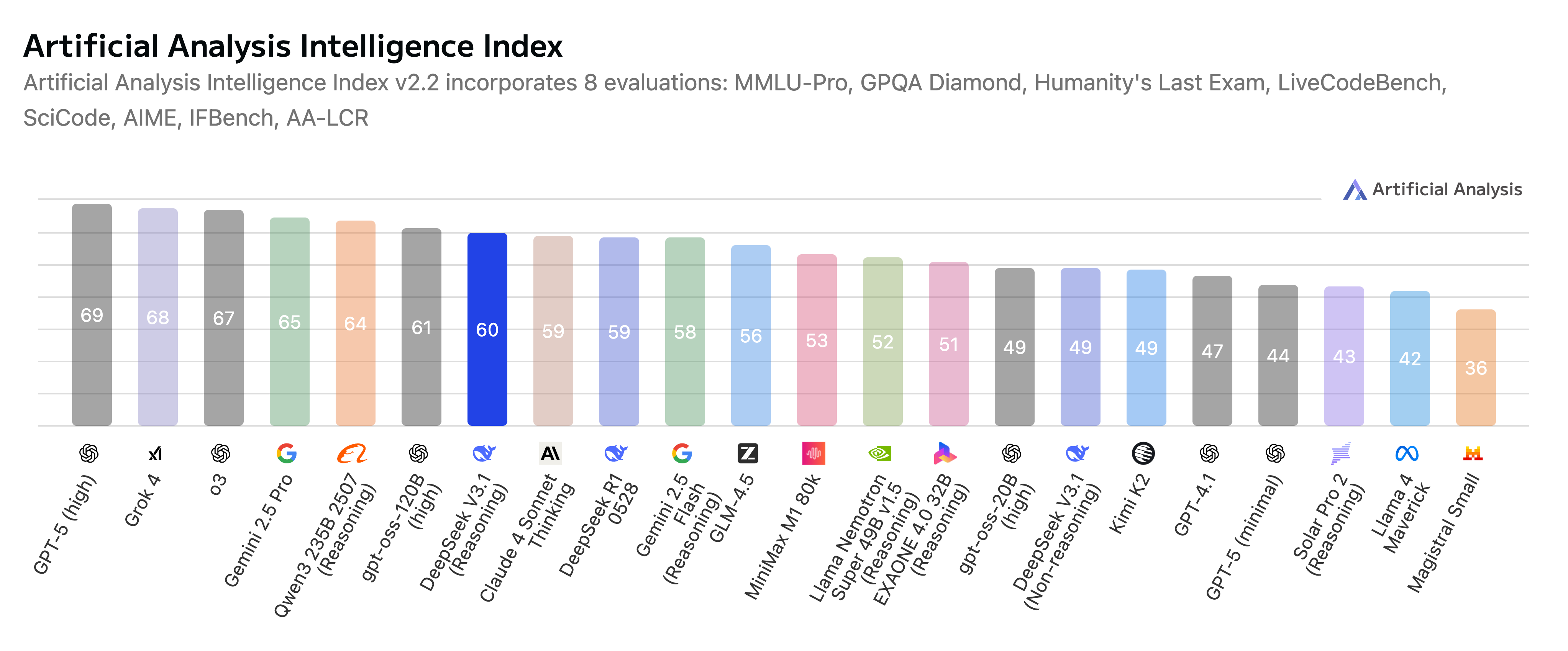

DeepSeek V3.1 Chat offre un équilibre optimal entre inférence rapide, intégration multimodale robuste et rentabilité pour les cas d'utilisation ne nécessitant pas un raisonnement approfondi. Il est conçu pour les développeurs et les entreprises qui privilégient la vitesse et l'exécution simplifiée des tâches dans les flux de travail d'IA conversationnelle multimodale et d'agents.

💡 contre GPT-5: Bien que GPT-5 dispose d'une fenêtre de contexte de 400 000 jetons beaucoup plus vaste et intègre des modalités audio/vidéo émergentes en plus des capacités de traitement du texte et de l'image, DeepSeek V3.1 Chat excelle par une intégration plus poussée de la manipulation du contexte visuel, une modularité dynamique des experts pour un calcul efficace et des outils avancés d'adaptation au domaine. DeepSeek propose une approche de modèle à pondération ouverte performante, offrant des avantages en termes de coûts, et se spécialise dans le raisonnement sur des images complexes et la fusion multimodale, tandis que GPT-5 domine en termes d'échelle de contexte et d'étendue multimodale, avec une intégration à l'écosystème d'entreprise.

💡 contre DeepSeek V3: La nouvelle version améliore la vitesse d'inférence d'environ 30 %, étend la fenêtre de contexte de 128 Ko à une échelle plus flexible optimisée pour les tâches de conversation, et renforce considérablement la précision de l'alignement multimodal. Ces améliorations permettent un meilleur raisonnement, notamment dans les langages à faibles ressources et les environnements visuels complexes, ce qui la rend plus performante pour l'IA conversationnelle avancée et la compréhension de code à grande échelle.

💡 contre OpenAI GPT-4.1: Comparé à l'architecture optimisée pour le code et centrée sur le texte de GPT-4.1, DeepSeek V3.1 équilibre la gestion de volumes importants d'entrées multimodales avec un système d'entraînement sophistiqué basé sur le modèle Mixture of Experts. Cet équilibre offre une cohérence visuelle et textuelle supérieure et une adaptation plus rapide à diverses tâches multimodales, rendant DeepSeek particulièrement adapté aux flux de travail nécessitant une intégration fluide du texte et des images avec un raisonnement avancé.

Foire aux questions (FAQ)

Quel est l'objectif principal de DeepSeek V3.1 Chat ?

DeepSeek V3.1 Chat est conçu pour IA conversationnelle rapide et directe, en privilégiant les réponses à faible latence pour les requêtes simples et l'exécution des tâches, plutôt que les raisonnements complexes en plusieurs étapes.

Comment DeepSeek V3.1 Chat parvient-il à des temps de réponse aussi rapides ?

Le modèle fonctionne exclusivement dans un mode « non-pensée », en omettant un raisonnement en plusieurs étapes pour fournir des résultats immédiats. Son architecture de transformateur Mixture of Experts (MoE) optimisée contribue également à une utilisation efficace des ressources et à une vitesse accrue.

Quelles sont les fonctionnalités multimodales offertes par DeepSeek V3.1 Chat ?

Elle conserve de solides capacités multimodales, favorisant des interactions efficaces entre elles. texte et images pour des tâches telles que le chat multimodal et la génération rapide de code, même sans fonctionnalité de raisonnement approfondi.

Dans quels scénarios DeepSeek V3.1 Chat est-il le plus efficace ?

Il est optimisé pour les applications nécessitant interactions efficaces et directes Dans les domaines du chat, de la génération de code et des flux de travail des agents, idéal pour les développeurs et les entreprises qui privilégient des temps de réponse rapides et une exécution des tâches rationalisée.

Terrain de jeu de l'IA

Se connecter

Se connecter