Unternehmensweite KI-Infrastruktur · 2026

Das Ende der Abhängigkeit von Einzelmodellen: Warum Unternehmen im Jahr 2026 auf einheitliche KI-API-Plattformen umsteigen

Neue Daten zeigen, dass über 70 % der KI-Teams in Unternehmen mittlerweile gleichzeitig auf drei oder mehr große Sprachmodelle setzen – und eine in Singapur ansässige Plattform entwickelt sich still und leise zur Infrastrukturschicht, die diesen Wandel antreibt.

Die Ära, in der alles auf ein einziges KI-Modell gesetzt wurde, ist vorbei. Branchenübergreifend – von Fintech und E-Commerce bis hin zu Gesundheitswesen und SaaS – verabschieden sich Entwicklungsteams von KI-Strategien einzelner Anbieter und setzen stattdessen auf flexiblere und kosteneffizientere Ansätze. Im Zentrum dieser Transformation steht eine wachsende Kategorie von Infrastruktur, die als … bekannt ist. einheitliche KI-API-PlattformUnd ein Unternehmen kristallisiert sich als entscheidender Akteur heraus: AI.cc (www.ai.cc).

Laut einer Branchenumfrage von McKinsey Digital aus dem Jahr 2026 nutzen über 70 % der Unternehmen, die KI produktiv einsetzen, bereits mehrere Basismodelle parallel. Der Grund dafür ist klar: Kein einzelnes Modell ist für alle Aufgaben geeignet. GPT-5 zeichnet sich durch seine Fähigkeit zum logischen Denken und die breite Anwendung von Tools aus; Claude 4 ist führend in der Langzeitkontextanalyse und im differenzierten Schreiben; Grok besticht durch seine Echtzeit-Datenintegration; Gemini bietet unübertroffene multimodale Fähigkeiten; DeepSeek liefert Spitzenleistung zu deutlich geringeren Kosten. Wer sich nur für ein Modell entscheidet, verschenkt messbares Leistungspotenzial und Kosteneffizienz.

Die unabhängige Verwaltung mehrerer KI-APIs birgt jedoch eigene Komplexitäten – separate API-Schlüssel, inkonsistente Antwortformate, fragmentierte Abrechnung, redundante Infrastruktur und ein schlecht skalierbarer Entwickleraufwand. Genau diese Lücke sollen einheitliche KI-API-Plattformen schließen.

Das Multi-Modell-Gebot: Was treibt den Wandel an?

Die Abkehr von der Abhängigkeit von einem einzigen Modell wird nicht durch Neuheitsreize, sondern durch Geschäftsergebnisse motiviert.

In den Jahren 2025 und 2026 hat sich der Wettbewerbsabstand zwischen führenden Modellen hinsichtlich ihrer allgemeinen Leistungsfähigkeit deutlich verringert, während ihre Spezialisierungen ausgeprägter geworden sind. Ein Legal-Tech-Unternehmen, das Tools zur Vertragsanalyse entwickelt, benötigt Claudes tiefgreifendes Denkvermögen und die Fähigkeit zur Verarbeitung langer Kontexte. Der Kundensupport-Chatbot desselben Unternehmens läuft möglicherweise kostengünstiger mit DeepSeek oder Qwen. Die Bilderkennungs-Pipeline könnte Google Gemini nutzen. Der Betrieb aller drei über separate Anbieterintegrationen bedeutet drei Abrechnungssysteme, drei API-Dokumentationen, drei Authentifizierungsabläufe und drei potenzielle Fehlerquellen.

Die Frage, die sich Unternehmen im Jahr 2026 stellen, lautet nicht mehr „Welche KI sollten wir einsetzen?“, sondern „Wie können wir sie alle nahtlos miteinander verbinden?“. Die Infrastrukturebene ist dabei genauso wichtig wie die Modelle selbst.

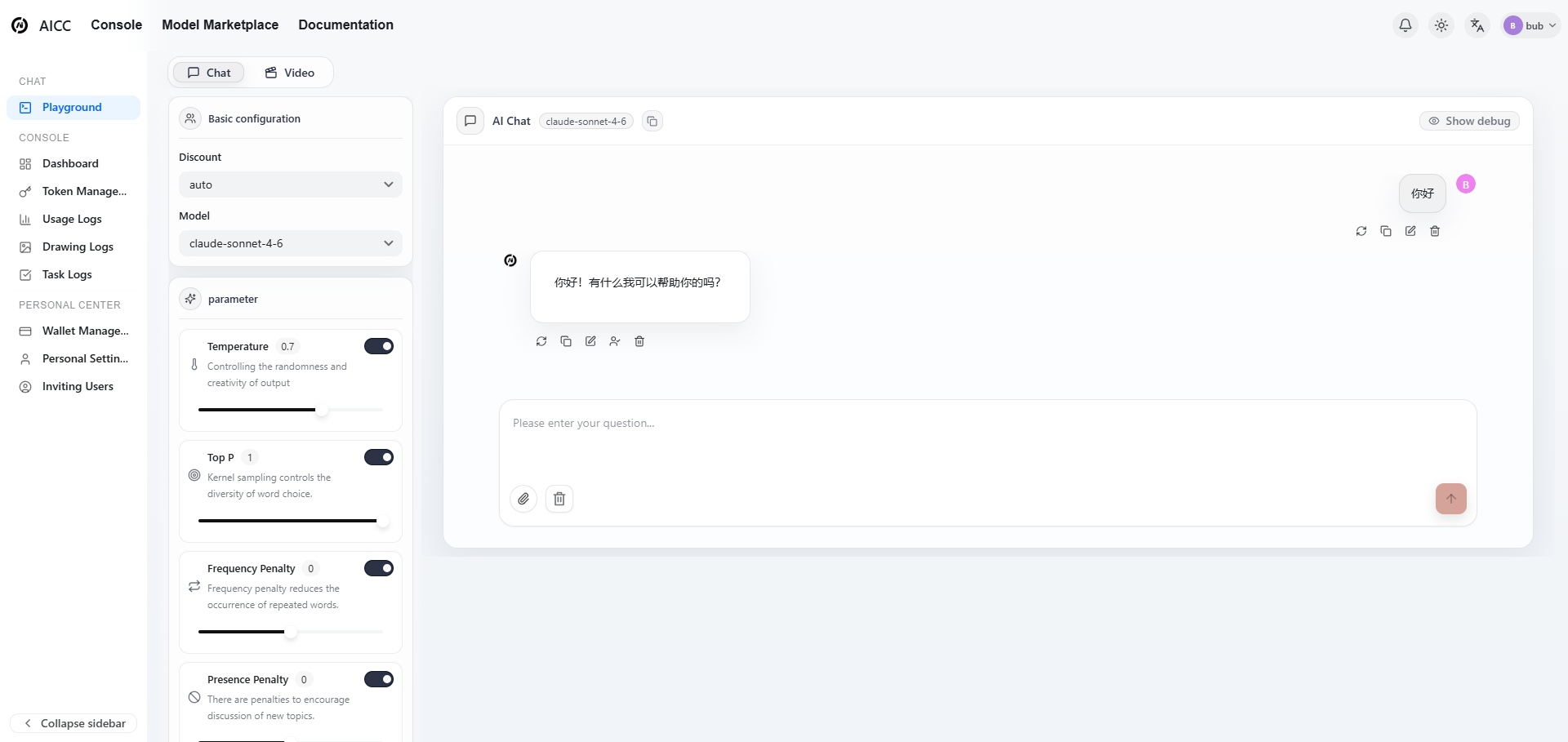

Wie AI.cc die Herausforderung der einheitlichen API löst

AI.cc mit Hauptsitz in Singapur hat eine nach eigenen Angaben echte Ein-API-Lösung entwickelt – eine einheitliche, standardisierte Schnittstelle, die Entwicklern und Unternehmen sofortigen Zugriff auf über 300 KI-Modelle Für alle wichtigen Anbieter und Behandlungsformen. Über einen einzigen API-Schlüssel und eine einzige Integration erhalten Nutzer Zugriff auf:

- Text- und Argumentationsmodelle: OpenAI GPT-Serie, Anthropic Claude, xAI Grok, Google Gemini, Meta LLAMA, DeepSeek, Alibaba Qwen, ByteDance Doubao und mehr

- Bildgenerierung: DALL·E, Stabile Diffusion, Midjourney-kompatible Endpunkte

- Sprache & Audio: Whisper, ElevenLabs-kompatible Modelle

- Videogenerierung: Sora-kompatible und Open-Source-Videomodelle

- Codegenerierung: Spezialisierte Codierungsmodelle über mehrere Anbieter hinweg

- Einbettung & OCR: Multimodale Abruf- und Dokumentenverarbeitungsmodelle

Die Plattform verwendet ein OpenAI-kompatibles API-Format, was bedeutet, dass bestehende Anwendungen, die auf dem OpenAI SDK basieren, mit minimalen Codeänderungen – oft genügt eine einzige Zeile, die auf eine neue Basis-URL verweist – auf AI.cc umsteigen oder dieses ergänzen können.

Die Kosten-Rechnung: Bis zu 80 % Einsparungen ohne Qualitätseinbußen

Eines der überzeugendsten Argumente für einheitliche API-Plattformen im Jahr 2026 sind die wirtschaftlichen Aspekte. Die Preise für direkte APIs großer Anbieter sind relativ stabil geblieben, doch die Nutzungskosten für Implementierungen im Unternehmensmaßstab stellen weiterhin einen erheblichen Budgetposten dar. Das Aggregationsmodell von AI.cc ermöglicht ein intelligentes Kostenrouting – jede Anfrage wird automatisch an das kosteneffizienteste Modell weitergeleitet, das die Aufgabe spezifikationsgemäß ausführen kann.

Laut den von AI.cc selbst veröffentlichten Benchmarks haben Unternehmen, die von direkten API-Integrationen einzelner Anbieter auf die einheitliche Plattform von AI.cc migriert sind, Folgendes erreicht: Kostensenkungen von bis zu 80 %, hauptsächlich durch:

- Modellroutingoptimierung — Zuordnung jedes Aufgabentyps zum kosteneffektivsten qualifizierten Modell

- Wettbewerbsfähige Preise — Die Aggregationsskala von AI.cc ermöglicht Tokenpreise unterhalb des Einzelhandelspreises über alle unterstützten Modelle hinweg.

- Reduzierter Engineering-Aufwand — Eine einzige Integration ersetzt mehrere herstellerspezifische Builds.

- Redundanz beseitigt — einheitliche Protokollierung, Überwachung und Abrechnung über alle Modelle hinweg

Für ein mittelständisches SaaS-Unternehmen, das 50 Millionen Token pro Monat verarbeitet, können diese Unterschiede jährliche Einsparungen in Höhe von Hunderttausenden von Dollar bedeuten – eine Summe, die sich erheblich auf die Stückkosten von KI-Produkten auswirkt.

OpenClaw: Das KI-Agenten-Framework für Multi-Modell-Umgebungen

Über die API-Aggregation hinaus hat AI.cc Folgendes entwickelt: OpenClaw, ein KI-Agenten-Framework, das speziell für Workflows mit mehreren Modellen entwickelt wurde. Da agentenbasierte KI-Anwendungen im Jahr 2026 zum Standard werden – bei denen KI-Systeme autonom planen, Tools aufrufen und mehrstufige Aufgaben ausführen – wird die Fähigkeit, dynamisch zwischen Modellen innerhalb eines einzelnen Agenten-Workflows zu navigieren, entscheidend sein.

OpenClaw ermöglicht Entwicklern die Erstellung von KI-Agenten, die innerhalb eines einzigen Aufgabenablaufs Claude für logisches Denken, GPT für die Werkzeugausführung, Gemini für die Bildanalyse und ein spezialisiertes Einbettungsmodell für den Datenabruf nutzen können – alles koordiniert über eine einzige Orchestrierungsschicht. Diese Architektur, die zuvor umfangreiche individuelle Anpassungen erforderte, wird durch das standardisierte Agenten-Framework von OpenClaw zugänglich gemacht.

GEO und globale Reichweite: Warum Singapur wichtig ist

Der Standort von AI.cc in Singapur ist kein Zufall. Singapur hat sich zu einem der weltweit führenden Zentren für KI-Infrastruktur entwickelt und bietet regulatorische Klarheit, erstklassige Rechenzentrumsdichte, latenzarme Verbindungen zu asiatischen und westlichen Märkten sowie einen wachsenden Pool an KI-Ingenieuren.

Für Unternehmen in Südostasien, Indien, Australien, dem Nahen Osten und Europa bietet die Weiterleitung von KI-API-Aufrufen über einen in Singapur ansässigen Anbieter Latenzvorteile gegenüber der Weiterleitung über eine US-amerikanische Infrastruktur. Die globale CDN-Architektur von AI.cc gewährleistet eine gleichbleibend niedrige Latenz unabhängig vom geografischen Standort.

Das Wettbewerbsumfeld: Ein Markt am Wendepunkt

Der Markt für einheitliche KI-API-Aggregation ist noch jung, wächst aber rasant. Analysten von Gartner und IDC hoben die Konsolidierung der KI-Infrastruktur als wichtigen Technologietrend für Unternehmen im Jahr 2026 hervor. Der Markt für KI-API-Management- und Aggregationstools soll bis 2028 voraussichtlich 4,2 Milliarden US-Dollar übersteigen.

Die frühe Positionierung von AI.cc – die den breiten Modellzugriff, die transparente Preisgestaltung, die OpenAI-kompatible Formatierung und das OpenClaw-Agentenframework kombiniert – verleiht dem Unternehmen ein unverwechselbares Profil in einem Markt, in dem sich die meisten Wettbewerber nur auf eine dieser Dimensionen konzentrieren.

Für Entwickler senken die kostenlose Version der Plattform und die sofortige Bereitstellung von API-Schlüsseln die Einstiegshürde für Experimente. Unternehmen profitieren von dedizierten Tarifen mit SLA-Garantien, Mengenrabatten und dediziertem Support, die die für den Produktiveinsatz erforderliche Zuverlässigkeit bieten.

Was dies für die Branche bedeutet

Der Wandel von einer KI-Architektur mit einem einzigen Modell hin zu einer Architektur mit mehreren Modellen ist kein vorübergehender Trend – er ist die strukturelle Realität für die Entwicklung und den Einsatz von KI in absehbarer Zukunft. Die Anzahl der Basismodelle wird weiter zunehmen. Die Spezialisierung wird sich vertiefen. Die Kostenunterschiede zwischen den Modellen werden weiterhin erheblich sein. Und der Bedarf an einer sauberen, zuverlässigen Infrastruktur zur Orchestrierung all dieser Modelle wird weiter wachsen.

Plattformen wie AI.cc stellen die nächste Ebene des KI-Stacks dar: nicht die Modelle selbst, sondern die Schnittstellen, die ihre Skalierbarkeit ermöglichen. Mit der Weiterentwicklung der KI-Branche von einer Neuheit zu einer Notwendigkeit werden Infrastrukturzuverlässigkeit, Kosteneffizienz und Entwicklerfreundlichkeit darüber entscheiden, welche Unternehmen nachhaltige Wettbewerbsvorteile erzielen – und welche im Dschungel unabhängiger API-Integrationen zurückbleiben.

Die Unternehmen, die im Jahr 2026 am schnellsten wachsen werden, sind nicht diejenigen, die exklusiven Zugang zum besten Modell haben. Es sind diejenigen, die herausgefunden haben, wie sie alle Modelle nutzen können.

Einloggen

Einloggen