Der explosive Dwarkesh-Podcast von Nvidia-CEO Jensen Huang: Wettbewerbsvorteile in der Lieferkette, TPU-Wettbewerb, Chipverkäufe in China und warum der KI-Dialog zwischen den USA und China jetzt unabdingbar ist (April 2026)

Innerhalb von nur 24 Stunden nach Veröffentlichung am 15. April 2026 erreichte das 1 Stunde und 43 Minuten lange Gespräch zwischen Nvidia-CEO Jensen Huang und Dwarkesh Patel Hunderttausende Aufrufe auf YouTube, X und Spotify. Die Folge mit dem Titel „Jensen Huang – TPU-Wettbewerb, warum wir Chips nach China verkaufen sollten und Nvidias Lieferkettenvorteil“ gilt als eines der offensten und strategisch aufschlussreichsten Interviews, die Huang je gegeben hat.

Als Betreiber von www.ai.cc Mit über zehn Jahren Erfahrung in der Entwicklung von KI-Tools, der Beobachtung von Infrastrukturtrends und der Beratung von Entwicklungsteams zur Skalierung von Rechenkapazitäten habe ich jede wichtige Telefonkonferenz von Nvidia zu den Quartalsergebnissen und jede Keynote der Global Trade Conference (GTC) verfolgt. Dieser Podcast sticht besonders hervor, da Huang nicht nur Nvidias Dominanz verteidigt, sondern den gesamten Wettbewerb um KI-Hardware neu definiert. Knappheit in der Lieferkette, Gesamtbetriebskosten (TCO), Und geopolitische RealitätUnd in einer Woche, die bereits von Anthropics Mythos Preview dominiert wurde, schlugen seine Kommentare zur KI-Kooperation zwischen den USA und China wie ein Donnerschlag ein.

Nvidias eigentlicher Wettbewerbsvorteil ist nicht CUDA – es ist die Engpass-Lieferkette

Huangs zentrale These ist unmissverständlich: Die knappste Ressource in der KI sind weder Talente noch Algorithmen – es sind … fortschrittliche HalbleiterfertigungskapazitätNvidia hat sich die weltweit engsten Lieferketten für High-Bandwidth-Speicher (HBM), fortschrittliche Gehäusetechnologien und modernste Wafer gesichert. „Wenn wir in den nächsten Jahren ein Volumen von einer Billion Dollar erreichen, verfügen wir über die nötige Lieferkette“, erklärte er und verwies auf Nvidias mehrjährige, milliardenschwere Verträge mit TSMC, Samsung und ASML.

Das ist keine Marketingfloskel. In einer Zeit, in der jeder Hyperscaler um den Bau von Clustern mit Millionen von GPUs wetteifert, argumentiert Huang, dass der Besitz der physischen Infrastruktur für KI-Rechenleistung Nvidia unübertroffene Geschwindigkeit und Stabilität verleiht. Wettbewerber können zwar ASICs entwickeln, benötigen aber dennoch dieselben knappen Produktionskapazitäten – und Nvidia hat diese auf Jahre im Voraus ausgebucht.

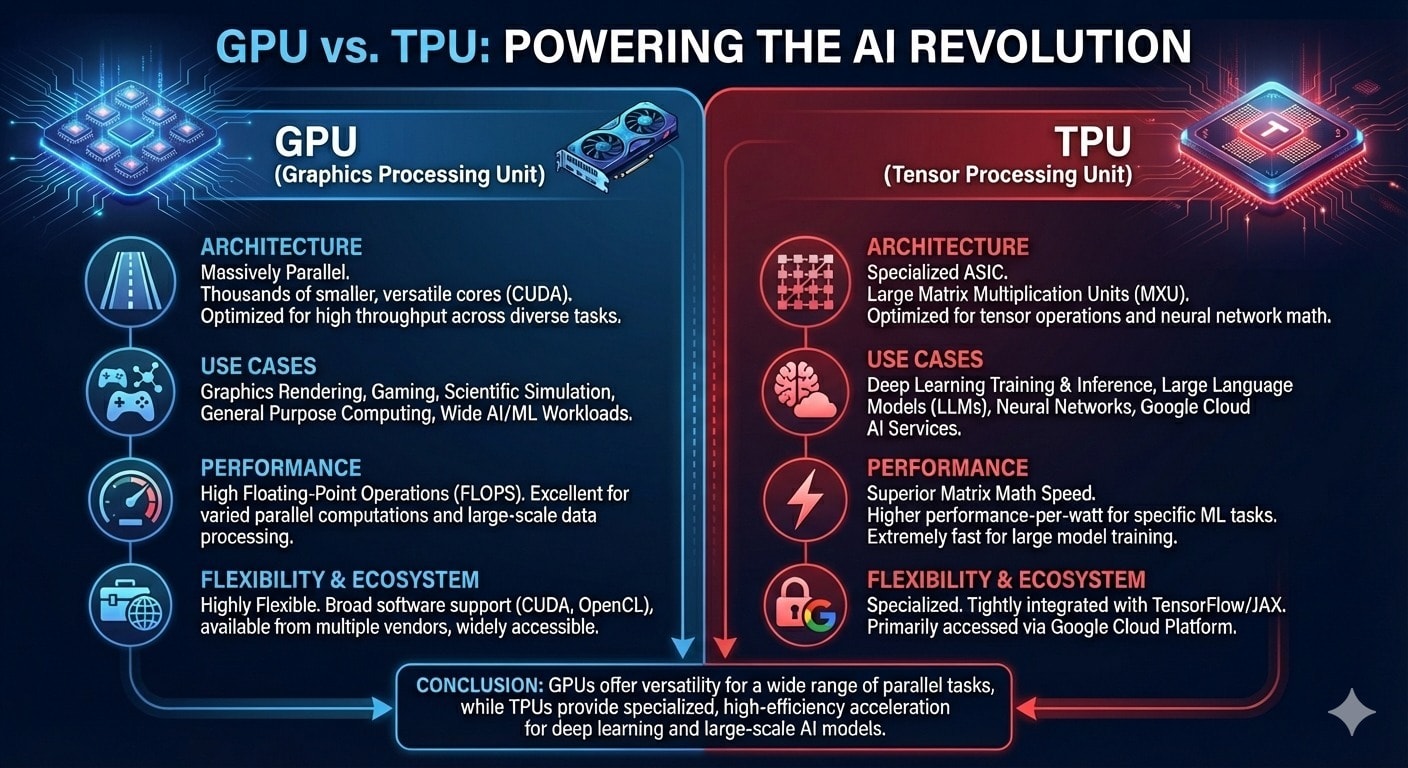

TPU-Wettbewerb: Jensen fordert Google und Amazon zum Benchmark heraus

Eines der am meisten erwarteten Segmente (ab ca. 16:25) behandelt das allseits bekannte Thema: Google TPUs und Amazon Trainium. Claude und Gemini wurden auf TPUs trainiert, und Hyperscaler preisen gerne die geringeren Inferenzkosten an. Huangs Antwort? Nur zu!

Er forderte Google und Amazon wiederholt auf, Ergebnisse für öffentliche Benchmarks wie InferenceMax und MLPerf vorzulegen. „Niemand kann mir eine Plattform mit einem besseren Preis-Leistungs-Verhältnis zeigen. Kein einziges Unternehmen.“ Huang betonte, dass TPUs zwar bei eng begrenzten, hochoptimierten Workloads innerhalb von Googles eigener Technologieplattform hervorragende Leistungen erbringen, Nvidias gesamtes Software-Ökosystem (CUDA, cuDNN, Triton) jedoch überlegene Leistung bietet. von Anfang bis Ende Wertschöpfung über Trainings-, Inferenz- und agentenbasierte Arbeitsabläufe hinweg.

Die China-Frage: Warum Huang behauptet, der Verkauf von Chips sei tatsächlich gut für die US-Sicherheit

Der politisch brisanteste Teil beginnt etwa bei Minute 57:36. Huang plädiert unmissverständlich für eine Lockerung der Exportkontrollen für KI-Chips nach China. Er argumentiert, dass die Isolation von 40 % des globalen Technologiemarktes die amerikanische Innovationskraft und Sicherheit schwächt, anstatt sie zu stärken. Die geringen Umsätze mit China, so Huang, hielten US-Unternehmen an der Spitze, während China mehrere Technologieknoten zurückliege (weitgehend immer noch bei 7 nm feststeckend, während Nvidia bereits 3 nm/2 nm liefert).

Diese Haltung stieß auf heftigen Widerstand – insbesondere aus anthropischen Kreisen –, doch Huang deutet sie als pragmatischen Realismus und nicht als Idealismus.

Mythos-Moment: Warum der KI-Forschungsdialog zwischen den USA und China „nicht länger optional“ ist

Huang bezog sich in seinen Kommentaren ausdrücklich auf Anthropics gerade erschienenes Claude Mythos Preview – das hochleistungsfähige Cybersicherheitsmodell, das Anthropic ausgewählt hatte. nicht Er riet von einer Veröffentlichung als Open Source aufgrund des anstößigen Potenzials ab. Mythos bezeichnete er als „Wendepunkt“, der einen formellen Dialog zwischen US-amerikanischen und chinesischen Forschern unerlässlich mache. „Wir wollen, dass die Vereinigten Staaten gewinnen, aber ich denke, ein Dialog, insbesondere ein Forschungsdialog, ist wahrscheinlich der sicherste Weg.“

In einer Woche, in der Banken, Aufsichtsbehörden und sogar Nvidias eigene Kunden fieberhaft versuchen, Cyberrisiken auf Mythos-Niveau zu bewerten, findet Huangs Botschaft Gehör: Die KI-Entwicklung schreitet schneller voran als Exportkontrollen oder Abkommen. Ein gemeinsames Verständnis zwischen den beiden größten KI-Mächten ist womöglich der einzig realistische Schutzmechanismus.

Die parallele Vision: Metas „Neuronale Computer“ und die Zukunft nach dem Betriebssystem

Während Nvidia verstärkt auf beschleunigte Hardware Im Gegensatz dazu schlägt Metas im April 2026 veröffentlichtes Paper „Neural Computers“ (in Zusammenarbeit mit KAUST) das gegenteilige Extrem vor: die Zusammenlegung von Rechenleistung, Speicher und Ein-/Ausgabe. vollständig in das neuronale Netzwerk selbstAuf Videodiffusionsmodellen basierende Prototypen simulieren vollständige Terminal-Sitzungen und Desktop-GUIs ohne ein herkömmliches Betriebssystem im Hintergrund.

Dieses „rein neuronale“ Paradigma – bei dem das Modell Ist Der Computer stellt das langfristige Gegenstück zu Nvidias hardwarelastiger Technologie dar. Huang ging nicht direkt darauf ein, doch der Kontrast ist frappierend: Die einen wetteifern darum, größere und effizientere Chips zu entwickeln; die anderen versuchen, Chips in erlernten latenten Zuständen verschwinden zu lassen.

Was dies für Entwickler, Teams und das KI-Ökosystem bedeutet

Für KI-Experten und Führungskräfte im Ingenieurwesen:

- Infrastrukturinvestitionen Es kommt nun mehr auf die Gesamtbetriebskosten und die Reife des Ökosystems an als auf die reinen FLOPS.

- Geopolitisches Risiko ist mittlerweile eine Grundvoraussetzung in jeder langfristigen Roadmap für Computertechnologien.

- Hybrid-Futures sind wahrscheinlich: Nvidia-GPUs für Flexibilität, kundenspezifische Siliziumchips für Hyperscale-Effizienz und neuronale native Laufzeitumgebungen für völlig neue Interaktionsmodelle.

Der Podcast hat bereits Tausende von Diskussionen auf X, ausführliche Reddit-Beiträge und Investorenkommentare ausgelöst. Das ist kein Hype, sondern eine Meisterklasse darin, wie die KI-Hardware-Ebene die nächsten 3–5 Jahre plant.

Als jemand, der das letzte Jahrzehnt damit verbracht hat, Teams bei genau diesen Infrastrukturveränderungen zu unterstützen, www.ai.ccIch kann sagen, dass dieses Interview verdeutlicht, warum es so wichtig ist, stets auf dem Laufenden zu bleiben. Hardware + Geopolitik + Modell Schnittmengenanalysen waren noch nie so wichtig. Egal, ob Sie zukunftsweisende Modelle trainieren, Agenten entwickeln oder einfach nur die Inferenzkosten im Griff behalten wollen: Das Verständnis von Nvidias Wettbewerbsvorteil, der TPU-Herausforderung und der aufkommenden neuronalen Bildverarbeitung wird Ihre Strategie maßgeblich beeinflussen.

Wenn Sie die aktuellsten Analysen, praxisnahe Tool-Übersichten, Infrastruktur-Benchmarks und praktische Leitfäden wünschen, die Ihr Team wirklich voranbringen, dann tauchen Sie tiefer ein unter AICC—Ihre tägliche Anlaufstelle für KI-Produktivität in der Praxis bei www.ai.ccWir werden jeden einzelnen Schritt dieser Geschichte weiterverfolgen.

Es geht darum, wer die Zukunft der Knappheit selbst kontrolliert.

Einloggen

Einloggen