El explosivo podcast de Jensen Huang, CEO de Nvidia, en Dwarkesh: la ventaja competitiva de la cadena de suministro, la competencia en TPU, las ventas de chips en China y por qué el diálogo sobre IA entre EE. UU. y China es ahora innegociable (abril de 2026).

Apenas 24 horas después de su lanzamiento el 15 de abril de 2026, la conversación de 1 hora y 43 minutos entre el CEO de Nvidia, Jensen Huang, y Dwarkesh Patel acumuló cientos de miles de visualizaciones en YouTube, X y Spotify. El episodio, titulado "Jensen Huang: la competencia de TPU, por qué deberíamos vender chips a China y la ventaja competitiva de la cadena de suministro de Nvidia", está siendo considerado una de las entrevistas más sinceras y estratégicamente reveladoras que Huang haya concedido.

Como operador de www.ai.cc Con más de una década de experiencia seleccionando herramientas de IA, siguiendo las tendencias de infraestructura y asesorando a equipos de desarrollo sobre escalado de computación, he visto todas las principales conferencias de resultados de Nvidia y presentaciones magistrales de GTC. Este podcast destaca porque Huang no solo defiende el dominio de Nvidia, sino que replantea toda la guerra del hardware de IA en torno a escasez en la cadena de suministro, costo total de propiedad (TCO), y realidad geopolíticaY en una semana ya dominada por el avance de Mythos de Anthropic, sus comentarios sobre la cooperación en IA entre EE. UU. y China cayeron como un trueno.

La verdadera ventaja competitiva de Nvidia no es CUDA, sino la cadena de suministro global con cuellos de botella.

La tesis central de Huang es tajante: el recurso más escaso en IA no es el talento ni siquiera los algoritmos, sino... capacidad de fabricación de semiconductores avanzadosNvidia ha asegurado las cadenas de suministro más limitadas del mundo para memorias de alto ancho de banda (HBM), empaquetado avanzado y obleas de última generación. «Si nuestros próximos años alcanzan una escala de un billón de dólares, tenemos la cadena de suministro para lograrlo», afirmó, haciendo referencia a los compromisos plurianuales y multimillonarios de Nvidia con TSMC, Samsung y ASML.

Esto no es una estrategia de marketing. En una era donde todos los proveedores de servicios en la nube compiten por construir clústeres de millones de GPU, Huang argumenta que controlar la infraestructura física para la computación de IA le otorga a Nvidia una velocidad y resiliencia inigualables. Los competidores pueden diseñar ASIC, pero aún necesitan los mismos espacios de fabricación, que Nvidia tiene reservados con años de anticipación.

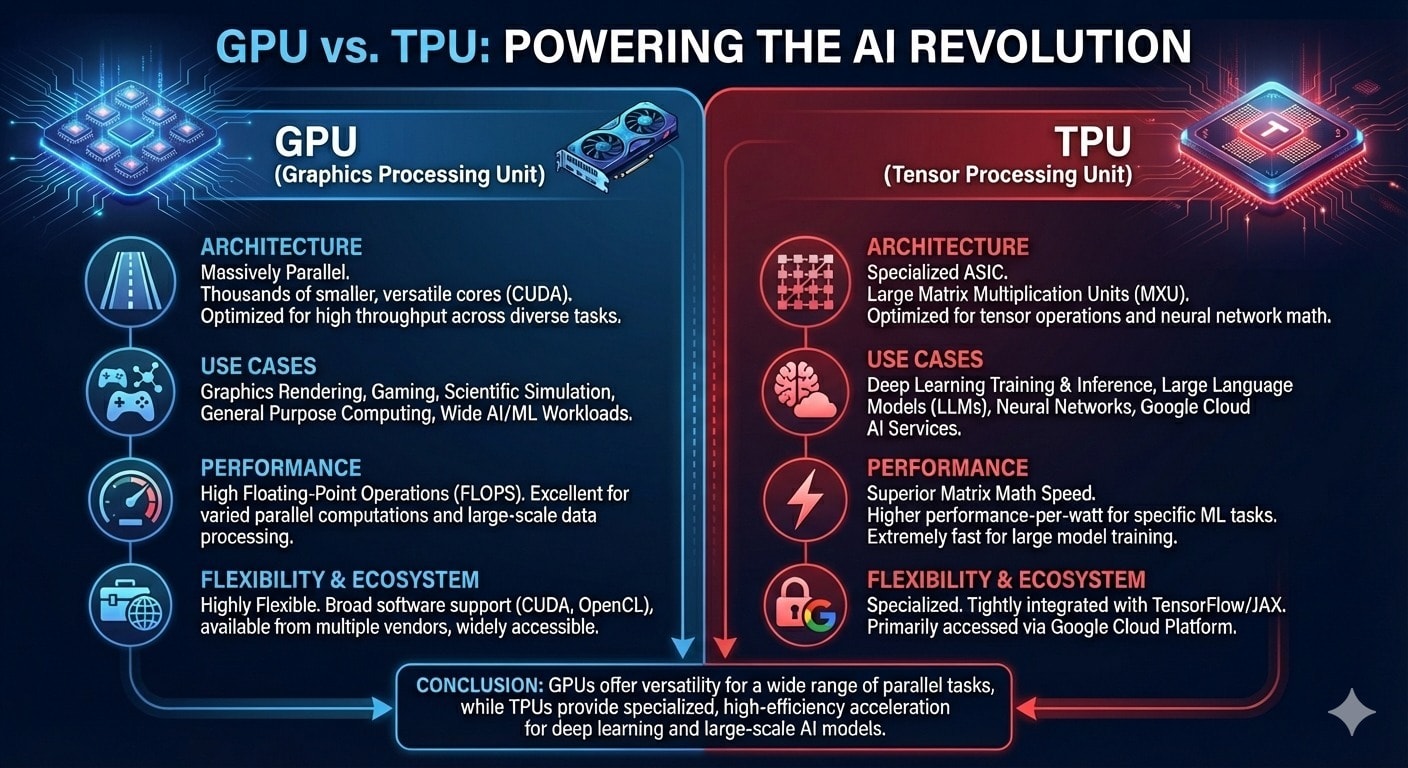

Competencia TPU: Jensen desafía a Google y Amazon a realizar pruebas de rendimiento.

Uno de los segmentos más esperados (que comienza alrededor del minuto 16:25) aborda el tema principal: las TPU de Google y Amazon Trainium. Claude y Gemini se han entrenado con TPU, y a las grandes empresas de computación en la nube les encanta presumir de menores costos de inferencia. ¿La respuesta de Huang? ¡Adelante!

Desafió repetidamente a Google y Amazon a que presentaran resultados a pruebas de rendimiento públicas como InferenceMax y MLPerf. “Nadie puede mostrarme una plataforma con mejor rendimiento por TCO. Ni una sola empresa”. Huang enfatizó que, si bien las TPU sobresalen en cargas de trabajo específicas y altamente optimizadas dentro del propio ecosistema de Google, el ecosistema de software completo de Nvidia (CUDA, cuDNN, Triton) ofrece un rendimiento superior. de extremo a extremo valor en los flujos de trabajo de entrenamiento, inferencia y agentes.

La cuestión de China: ¿Por qué Huang dice que vender chips es realmente bueno para la seguridad de Estados Unidos?

Quizás la parte más políticamente comprometida comienza alrededor del minuto 57:36. Huang defiende sin reservas la flexibilización de los controles de exportación de chips de IA a China. Argumenta que aislar el 40% del mercado tecnológico mundial debilita la innovación y la seguridad estadounidenses, en lugar de fortalecerlas. Según él, las ventas marginales a China mantienen a las empresas estadounidenses a la vanguardia, mientras que China se queda rezagada (sigue estancada en gran medida en los 7 nm, mientras que Nvidia comercializa chips de 3 nm/2 nm).

Esta postura ha suscitado una fuerte reacción, especialmente en los círculos antropológicos, pero Huang la presenta como un realismo pragmático más que como un idealismo.

Momento clave: Por qué el diálogo sobre investigación en IA entre EE. UU. y China “ya no es opcional”

Huang vinculó explícitamente sus comentarios con la presentación preliminar de Claude Mythos de Anthropic, el modelo de ciberseguridad ultra capaz que Anthropic eligió. no a código abierto debido a su potencial ofensivo. Calificó a Mythos como un “punto de inflexión” que hace esencial el diálogo formal entre investigadores de EE. UU. y China. “Queremos que Estados Unidos gane, pero creo que tener un diálogo, y un diálogo de investigación, es probablemente lo más seguro”.

En una semana en la que bancos, reguladores e incluso los propios clientes de Nvidia se esfuerzan por evaluar los riesgos cibernéticos del nivel de Mythos, el mensaje de Huang cobra relevancia: la IA de vanguardia avanza más rápido que los controles de exportación o los tratados. Un entendimiento mutuo entre las dos mayores potencias en IA podría ser la única salvaguarda realista.

La visión paralela: las “computadoras neuronales” de Meta y el futuro post-sistema operativo.

Mientras Nvidia redobla su apuesta por la aceleración hardware En cuanto a la infraestructura, el artículo de Meta de abril de 2026, titulado "Neural Computers" (con KAUST), propone el extremo opuesto: computación de pliegues, memoria y E/S. completamente dentro de la propia red neuronal.Los prototipos basados en modelos de difusión de vídeo simulan sesiones completas de terminal e interfaces gráficas de usuario de escritorio sin ningún sistema operativo tradicional subyacente.

Este paradigma “neuronal puro”, donde el modelo es La computadora representa el contrapunto a largo plazo a la arquitectura de hardware de Nvidia. Huang no lo mencionó directamente, pero el contraste es sorprendente: una parte se apresura a construir chips de silicio más grandes y eficientes; la otra intenta que el silicio desaparezca dentro de estados latentes aprendidos.

Qué significa esto para los desarrolladores, los equipos y el ecosistema de la IA.

Para profesionales de la IA y líderes de ingeniería:

- Apuestas en infraestructura Ahora dependen más del TCO y la madurez del ecosistema que de los FLOPS brutos.

- riesgo geopolítico Ahora es un requisito indispensable en cualquier hoja de ruta de computación a largo plazo.

- Futuros híbridos Es probable que se utilicen GPU de Nvidia para mayor flexibilidad, silicio personalizado para una eficiencia a hiperescala y entornos de ejecución nativos neuronales para modelos de interacción completamente nuevos.

El podcast ya ha generado miles de hilos en X, análisis exhaustivos en Reddit y notas para inversores. No es publicidad engañosa; es una lección magistral sobre cómo la capa de hardware de IA se proyecta hacia los próximos 3 a 5 años.

Como alguien que ha pasado la última década ayudando a equipos a navegar precisamente estos cambios de infraestructura en www.ai.ccPuedo decir que esta entrevista cristaliza por qué es importante mantenerse informado. hardware + geopolítica + modelo La interconexión nunca ha sido tan valiosa. Ya sea que estés entrenando modelos de vanguardia, creando agentes o simplemente tratando de controlar los costos de inferencia, comprender la ventaja competitiva de Nvidia, el desafío de la TPU y la visión artificial neuronal emergente definirá tu estrategia.

Si desea obtener los últimos análisis, recopilaciones prácticas de herramientas, comparativas de infraestructura y guías prácticas que realmente marquen la diferencia para su equipo, profundice en aicc—tu centro diario para la productividad de IA en el mundo real en www.ai.ccSeguiremos de cerca cada giro de esta historia a medida que se desarrolle.

Se trata de quién controla el futuro de la escasez en sí misma.

Acceso

Acceso