Le podcast explosif de Jensen Huang, PDG de Nvidia, sur Dwarkesh : avantage concurrentiel de la chaîne d’approvisionnement, concurrence des TPU, ventes de puces chinoises et pourquoi le dialogue sino-américain sur l’IA est désormais incontournable (avril 2026)

En seulement 24 heures après sa diffusion le 15 avril 2026, l'entretien d'une heure et quarante-trois minutes entre Jensen Huang, PDG de Nvidia, et Dwarkesh Patel a cumulé des centaines de milliers de vues sur YouTube, X et Spotify. Cet épisode, intitulé « Jensen Huang – La concurrence des TPU, pourquoi nous devrions vendre des puces à la Chine et l'avantage concurrentiel de la chaîne d'approvisionnement de Nvidia », est considéré comme l'une des interviews les plus franches et stratégiquement révélatrices jamais accordées par Huang.

En tant qu'opérateur de www.ai.cc Avec plus de dix ans d'expérience dans la sélection d'outils d'IA, le suivi des tendances en matière d'infrastructures et le conseil aux équipes de développement sur la mise à l'échelle des ressources de calcul, j'ai assisté à toutes les principales conférences téléphoniques sur les résultats financiers de Nvidia et aux keynotes de la GTC. Ce podcast se distingue car Huang ne se contente pas de défendre la domination de Nvidia ; il repense toute la guerre du matériel d'IA autour de cette nouvelle perspective. pénurie de la chaîne d'approvisionnement, coût total de possession (CTP), et réalité géopolitiqueEt dans une semaine déjà dominée par l'aperçu de Mythos d'Anthropic, ses commentaires sur la coopération sino-américaine en matière d'IA ont fait l'effet d'un coup de tonnerre.

Le véritable avantage concurrentiel de Nvidia n'est pas CUDA, mais la chaîne d'approvisionnement mondiale qui présente des goulots d'étranglement.

La thèse centrale de Huang est sans détour : la ressource la plus rare en IA n’est ni le talent ni même les algorithmes, c’est… capacité de fabrication avancée de semi-conducteursNvidia a sécurisé les chaînes d'approvisionnement les plus tendues au monde pour la mémoire à large bande passante (HBM), le packaging avancé et les plaquettes de silicium de pointe. « Si notre chiffre d'affaires des prochaines années atteint mille milliards de dollars, nous avons la chaîne d'approvisionnement nécessaire », a-t-il déclaré, faisant référence aux engagements pluriannuels et plurimilliardaires de Nvidia auprès de TSMC, Samsung et ASML.

Il ne s'agit pas d'un argument marketing. À l'heure où tous les géants du cloud se lancent dans la construction de clusters à millions de GPU, Huang affirme que la maîtrise de l'infrastructure physique dédiée au calcul IA confère à Nvidia une rapidité et une résilience inégalées. Les concurrents peuvent concevoir des ASIC, mais ils ont toujours besoin des mêmes créneaux de production rares – et Nvidia les réserve des années à l'avance.

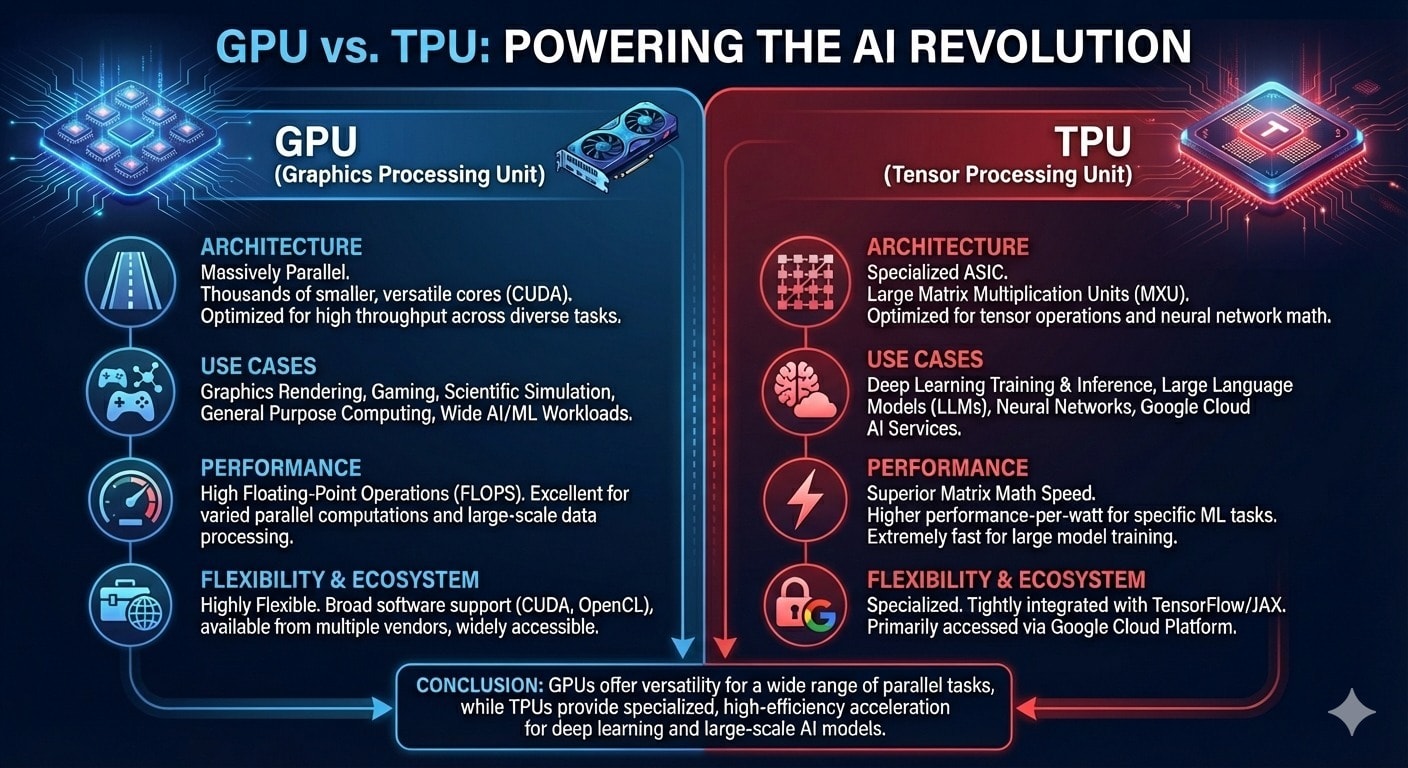

Compétition TPU : Jensen met Google et Amazon au défi de réaliser un benchmark

L'un des segments les plus attendus (à partir de 16:25 environ) aborde le sujet qui fâche : les TPU de Google et Amazon Trainium. Claude et Gemini ont été entraînés sur des TPU, et les géants du cloud aiment vanter leurs coûts d'inférence réduits. La réponse de Huang ? Qu'ils se lancent !

Il a mis au défi à plusieurs reprises Google et Amazon de soumettre leurs résultats aux benchmarks publics tels qu'InferenceMax et MLPerf. « Aucune entreprise ne peut me présenter une plateforme offrant de meilleures performances par rapport au coût total de possession. » Huang a souligné que si les TPU excellent dans des charges de travail spécifiques et hautement optimisées au sein de l'environnement Google, l'écosystème logiciel complet de Nvidia (CUDA, cuDNN, Triton) offre des performances supérieures. de bout en bout valeur ajoutée pour l'entraînement, l'inférence et les flux de travail d'agents.

La question chinoise : pourquoi Huang affirme que la vente de puces est en réalité bénéfique pour la sécurité des États-Unis

Le passage le plus politiquement sensible commence sans doute vers 57 min 36 s. Huang plaide sans ambages pour un assouplissement des contrôles à l'exportation des puces d'IA vers la Chine. Il soutient que l'isolement de 40 % du marché mondial des technologies affaiblit l'innovation et la sécurité américaines, au lieu de les renforcer. Selon lui, les ventes marginales à la Chine maintiennent les entreprises américaines à la pointe de la technologie, tandis que la Chine reste largement en retard (encore largement bloquée au 7 nm, alors que Nvidia propose des technologies 3 nm/2 nm).

Cette position a suscité de vives réactions, notamment de la part des milieux anthropologiques, mais Huang la présente comme un réalisme pragmatique plutôt que comme un idéalisme.

Moment de vérité : Pourquoi le dialogue entre les États-Unis et la Chine sur la recherche en IA n'est « plus une option »

Huang a explicitement lié ses commentaires à la version préliminaire de Claude Mythos, récemment publiée par Anthropic – le modèle de cybersécurité ultra-performant qu'Anthropic a choisi. pas Il a décidé de rendre le logiciel libre en raison de son potentiel offensif. Il a qualifié Mythos de « tournant » qui rend indispensable un dialogue formel entre chercheurs américains et chinois. « Nous voulons que les États-Unis gagnent, mais je pense qu'un dialogue, et notamment un dialogue de recherche, est probablement la solution la plus sûre. »

Alors que les banques, les autorités de régulation et même les clients de Nvidia s'efforcent cette semaine d'évaluer les cyber-risques d'une ampleur comparable à celle de Mythos, le message de Huang résonne particulièrement : l'intelligence artificielle de pointe progresse plus vite que les contrôles à l'exportation ou les traités internationaux. Une compréhension commune entre les deux plus grandes puissances en matière d'IA constitue peut-être le seul rempart réaliste.

Vision parallèle : les « ordinateurs neuronaux » de Meta et l’avenir post-système d’exploitation

Alors que Nvidia mise encore plus sur l'accélération matériel Concernant l'infrastructure, l'article de Meta intitulé « Ordinateurs neuronaux » (publié en avril 2026 et co-écrit avec KAUST) propose l'approche opposée : un calcul, une mémoire et des E/S entièrement décentralisés. entièrement intégré au réseau neuronal lui-mêmeLes prototypes construits sur des modèles de diffusion vidéo simulent des sessions de terminal complètes et des interfaces graphiques de bureau sans aucun système d'exploitation traditionnel sous-jacent.

Ce paradigme « purement neuronal » — où le modèle est L'ordinateur représente le contrepoint à long terme à l'approche matérielle complexe de Nvidia. Huang ne l'a pas abordé directement, mais le contraste est frappant : d'un côté, on se lance dans une course effrénée pour concevoir des puces plus grandes et plus efficaces ; de l'autre, on cherche à rendre le silicium invisible grâce à des états latents acquis.

Ce que cela signifie pour les développeurs, les équipes et l'écosystème de l'IA

Pour les spécialistes de l'IA et les responsables d'ingénierie :

- Paris sur les infrastructures L'accent est désormais davantage mis sur le coût total de possession (TCO) et la maturité de l'écosystème que sur les opérations FLOPS brutes.

- Risque géopolitique est désormais un prérequis dans toute feuille de route informatique à long terme.

- Avenirs hybrides sont probables : des GPU Nvidia pour la flexibilité, des puces sur mesure pour une efficacité à très grande échelle et des environnements d’exécution neuronaux natifs pour des modèles d’interaction entièrement nouveaux.

Le podcast a déjà suscité des milliers de discussions sur X, d'analyses approfondies sur Reddit et de notes d'investisseurs. Il ne s'agit pas d'un simple effet de mode ; c'est une véritable leçon magistrale sur la façon dont la couche matérielle d'IA envisage les 3 à 5 prochaines années.

En tant que personne ayant passé la dernière décennie à aider des équipes à s'adapter précisément à ces changements d'infrastructure, www.ai.ccJe peux affirmer que cette interview illustre parfaitement pourquoi il est essentiel de rester informé. matériel + géopolitique + modèle L'intersection n'a jamais été aussi précieuse. Que vous entraîniez des modèles de pointe, développiez des agents ou cherchiez simplement à maîtriser les coûts d'inférence, comprendre l'avantage concurrentiel de Nvidia, le défi des TPU et la vision émergente des réseaux neuronaux vous permettra d'orienter votre stratégie.

Si vous souhaitez accéder aux analyses les plus récentes, aux comparatifs d'outils pratiques, aux référentiels d'infrastructure et aux guides pratiques qui auront un réel impact sur votre équipe, approfondissez vos recherches sur aicc—Votre plateforme quotidienne pour une productivité IA concrète sur www.ai.ccNous continuerons à suivre chaque rebondissement de cette histoire au fur et à mesure qu'elle se déroule.

Il s'agit de savoir qui contrôle l'avenir de la rareté elle-même.

Se connecter

Se connecter