Podcast explosivo de Jensen Huang, CEO da Nvidia, sobre Dwarkesh: Vantagem competitiva na cadeia de suprimentos, concorrência de TPUs, vendas de chips na China e por que o diálogo sobre IA entre EUA e China agora é inegociável (abril de 2026)

Apenas 24 horas após seu lançamento em 15 de abril de 2026, a conversa de 1 hora e 43 minutos do CEO da Nvidia, Jensen Huang, com Dwarkesh Patel, acumulou centenas de milhares de visualizações no YouTube, X e Spotify. O episódio — intitulado “Jensen Huang – Competição de TPU, por que devemos vender chips para a China e a vantagem competitiva da cadeia de suprimentos da Nvidia” — está sendo considerado uma das entrevistas mais francas e estrategicamente reveladoras que Huang já concedeu.

Como operador de www.ai.cc Com mais de uma década de experiência em curadoria de ferramentas de IA, acompanhamento de tendências de infraestrutura e consultoria para equipes de desenvolvimento sobre escalonamento de computação, assisti a todas as principais teleconferências de resultados da Nvidia e apresentações da GTC. Este podcast se destaca porque Huang não apenas defende o domínio da Nvidia — ele reformula toda a guerra do hardware de IA em torno de escassez na cadeia de suprimentos, custo total de propriedade (TCO), e realidade geopolíticaE em uma semana já dominada pela prévia do Mythos da Anthropic, seus comentários sobre a cooperação entre EUA e China em IA caíram como um trovão.

A verdadeira vantagem competitiva da Nvidia não é o CUDA, mas sim a sua cadeia de suprimentos global com gargalos.

A tese central de Huang é direta: o recurso mais escasso em IA não é o talento, nem mesmo os algoritmos — é a capacidade de processamento. capacidade avançada de fabricação de semicondutoresA Nvidia garantiu as cadeias de suprimentos mais restritas do mundo para memória de alta largura de banda (HBM), embalagens avançadas e wafers de última geração. "Se nossos próximos anos envolverem uma escala de trilhões de dólares, temos a cadeia de suprimentos para isso", afirmou, referindo-se aos compromissos plurianuais e multibilionários da Nvidia com a TSMC, a Samsung e a ASML.

Isso não é mera propaganda. Numa era em que todos os hiperescaladores competem para construir clusters com milhões de GPUs, Huang argumenta que possuir a infraestrutura física para computação de IA confere à Nvidia uma velocidade e resiliência incomparáveis. Os concorrentes podem projetar ASICs, mas ainda precisam das mesmas vagas de fabricação escassas — e a Nvidia as tem reservadas com anos de antecedência.

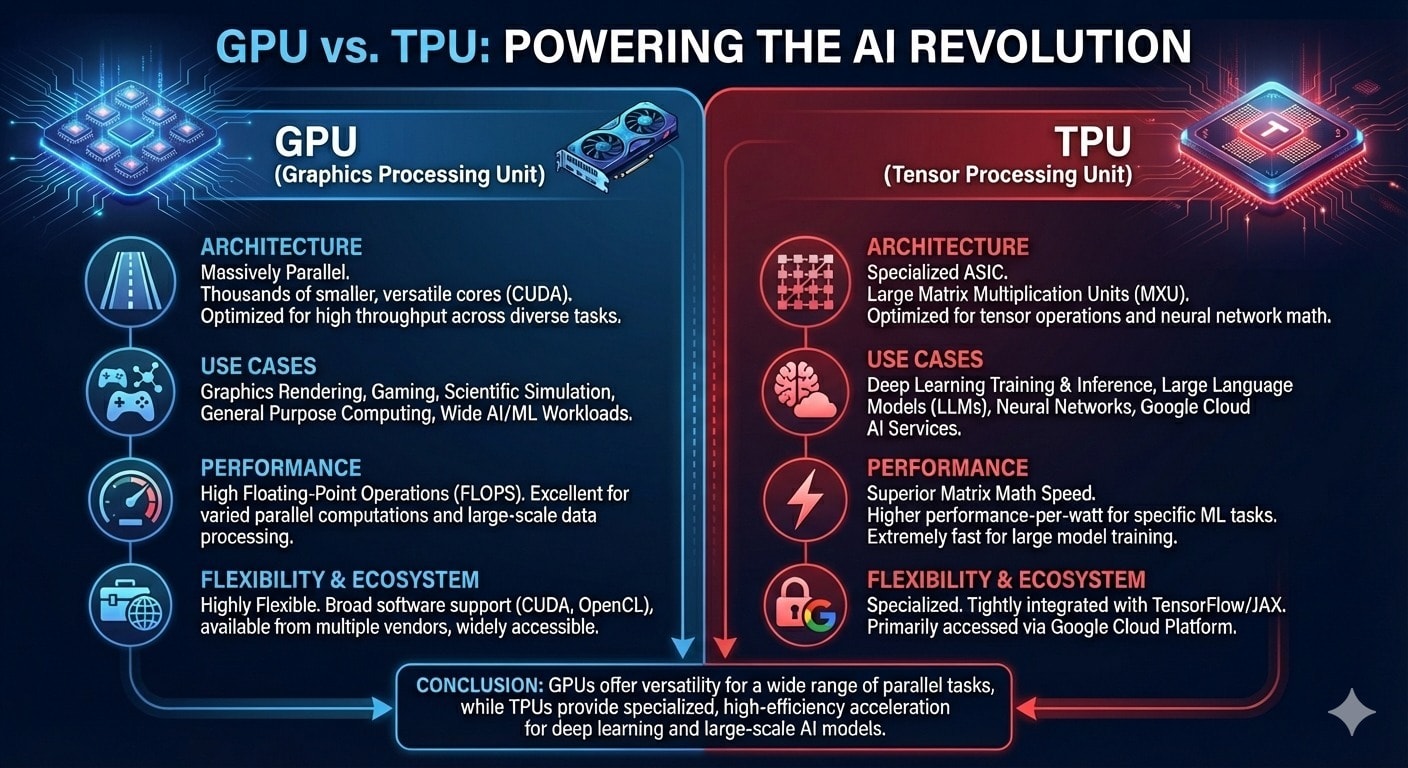

Competição TPU: Jensen desafia Google e Amazon a realizarem benchmarking.

Um dos segmentos mais aguardados (a partir de ~16:25) aborda o elefante na sala: TPUs do Google e Amazon Trainium. Claude e Gemini foram treinados em TPUs, e os hiperescaladores adoram alardear custos de inferência mais baixos. A resposta de Huang? Que venham.

Ele desafiou repetidamente o Google e a Amazon a submeterem resultados para benchmarks públicos como InferenceMax e MLPerf. "Ninguém consegue me mostrar uma plataforma com melhor desempenho por Custo Total de Propriedade (TCO). Nenhuma empresa." Huang enfatizou que, embora as TPUs se destaquem em cargas de trabalho específicas e altamente otimizadas dentro da própria plataforma do Google, o ecossistema completo de software da Nvidia (CUDA, cuDNN, Triton) oferece desempenho superior. de ponta a ponta valor em fluxos de trabalho de treinamento, inferência e agentes.

A questão da China: por que Huang afirma que vender chips é, na verdade, bom para a segurança dos EUA?

Talvez a parte mais politicamente carregada comece por volta dos 57:36. Huang defende, sem rodeios, a flexibilização dos controles de exportação de chips de IA para a China. Ele argumenta que isolar 40% do mercado global de tecnologia enfraquece a inovação e a segurança americanas, em vez de fortalecê-las. As vendas marginais para a China, afirma ele, mantêm as empresas americanas na vanguarda, enquanto a China permanece vários nós tecnológicos atrás (ainda em grande parte presa aos 7 nm, enquanto a Nvidia já utiliza tecnologia de 3 nm/2 nm).

Essa posição gerou forte reação negativa — especialmente em círculos antrópicos —, mas Huang a enquadra como realismo pragmático, e não idealismo.

Momento Mythos: Por que o diálogo entre EUA e China sobre pesquisa em IA “não é mais opcional”

Huang vinculou explicitamente seus comentários ao recém-lançado Claude Mythos Preview da Anthropic — o modelo de cibersegurança ultra-capaz escolhido pela Anthropic. não Ele defendeu a abertura do código-fonte devido ao seu potencial ofensivo. Chamou o Mythos de um "ponto de virada" que torna essencial o diálogo formal entre pesquisadores dos EUA e da China. "Queremos que os Estados Unidos vençam, mas acho que dialogar, e dialogar na área de pesquisa, é provavelmente a coisa mais segura a se fazer."

Em uma semana em que bancos, reguladores e até mesmo os clientes da Nvidia estão se esforçando para avaliar riscos cibernéticos do nível do Mythos, a mensagem de Huang ressoa: a IA de ponta está avançando mais rápido do que os controles de exportação ou tratados. Um entendimento compartilhado entre as duas maiores potências em IA pode ser a única proteção realista.

A Visão Paralela: Os “Computadores Neurais” da Meta e o Futuro Pós-SO

Enquanto a Nvidia reforça sua aposta na aceleração hardware A infraestrutura, conforme proposto no artigo "Neural Computers" da Meta, de abril de 2026 (em parceria com a KAUST), sugere o extremo oposto: computação, memória e E/S simplificadas. inteiramente na própria rede neuralProtótipos construídos com base em modelos de difusão de vídeo simulam sessões completas de terminal e interfaces gráficas de usuário (GUIs) de desktop sem nenhum sistema operacional tradicional subjacente.

Este paradigma “neural puro” — onde o modelo é O computador representa o contraponto de longo prazo à estratégia da Nvidia, que prioriza o hardware. Huang não abordou isso diretamente, mas o contraste é impressionante: de um lado, a corrida para construir silício maior e mais eficiente; do outro, a tentativa de fazer o silício desaparecer dentro de estados latentes aprendidos.

O que isso significa para desenvolvedores, equipes e o ecossistema de IA?

Para profissionais de IA e líderes de engenharia:

- Apostas em infraestrutura Agora, dependem mais do Custo Total de Propriedade (TCO) e da maturidade do ecossistema do que do número bruto de FLOPS.

- risco geopolítico Agora é um requisito básico em qualquer planejamento estratégico de computação de longo prazo.

- Futuros híbridos É provável que sejam GPUs da Nvidia para flexibilidade, silício personalizado para eficiência em hiperescala e tempos de execução nativos de redes neurais para modelos de interação totalmente novos.

O podcast já gerou milhares de tópicos no fórum X, discussões aprofundadas no Reddit e notas de investidores. Não é apenas hype; é uma aula magistral sobre como a camada de hardware de IA pensa nos próximos 3 a 5 anos.

Como alguém que passou a última década ajudando equipes a lidar exatamente com essas mudanças de infraestrutura na www.ai.ccPosso afirmar que esta entrevista cristaliza a importância de se manter informado sobre o assunto. hardware + geopolítica + modelo A interseção nunca foi tão valiosa. Seja para treinar modelos de ponta, construir agentes ou simplesmente tentar manter os custos de inferência sob controle, entender a vantagem competitiva da Nvidia, o desafio das TPUs e a visão computacional neural emergente moldará seu planejamento estratégico.

Se você busca as análises mais recentes, resumos práticos de ferramentas, benchmarks de infraestrutura e guias práticos que realmente fazem a diferença para sua equipe, aprofunde-se em aicc—seu centro diário de produtividade de IA no mundo real em www.ai.ccContinuaremos acompanhando cada reviravolta dessa história conforme ela se desenrola.

Trata-se de quem controla o futuro da própria escassez.

Conecte-se

Conecte-se