Xiaomi MiMo V2.5:

Le modèle 310B qui vient de rattrapé Claude Opus a traité de l'efficacité des jetons.

MiMo V2.5 de Xiaomi Il s'agit de la version open-weight la plus importante du deuxième trimestre 2026 : un modèle Mixture-of-Experts clairsemé de 310 milliards de jetons avec une compréhension multimodale native, une fenêtre de contexte d'un million de jetons et des performances de référence qui le placent au coude à coude avec Claude Opus et Gemini 3 Pro, tout en consommant 40 à 60 % de jetons en moinsVoici une analyse complète : architecture, benchmarks, tâches concrètes, prix et comparaison avec les solutions propriétaires.

Qu'est-ce que Xiaomi MiMo V2.5 ?

MiMo V2.5 est la dernière famille de modèles de L'équipe MiMo de Xiaomi, sorti fin avril 2026 et directement mis en avant Visage étreint en poids libres. La collection comprend en réalité deux modèles phares, ainsi qu'une suite TTS et un modèle ASR ; cette distinction est importante car la plupart des articles en ligne les confondent.

La ligne se divise ainsi :

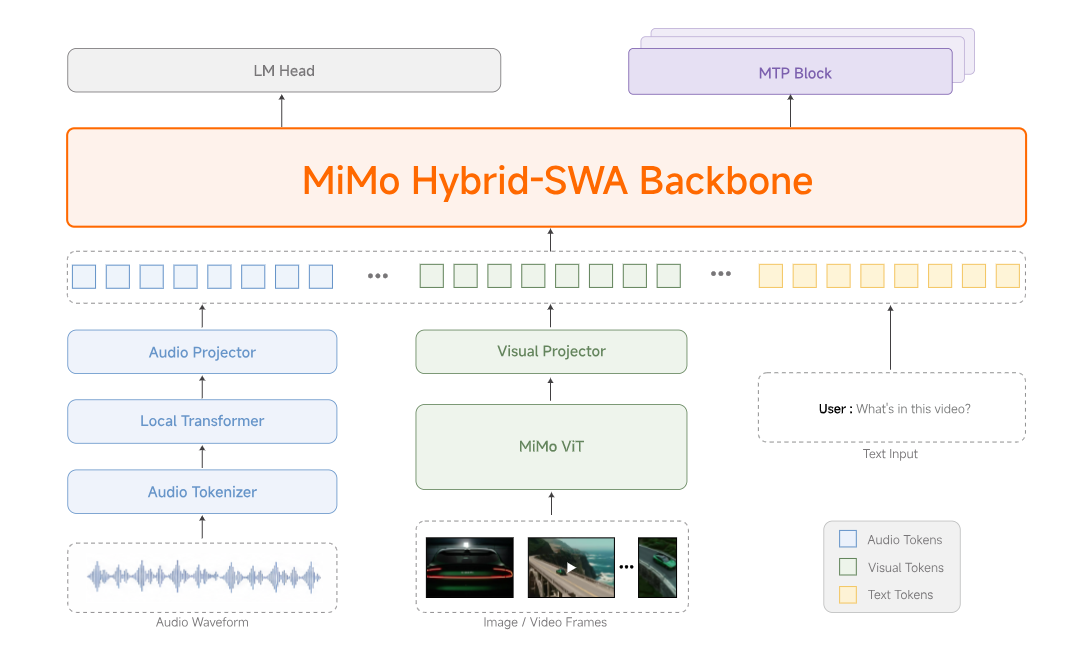

- MiMo-V2.5 — Le généraliste multimodal « Omni ».

310B paramètres totaux,15B actifArchitecture MoE clairsemée, entraînée sur 48 000 jetons. Compréhension native de la vision et de l’audio. Un système polyvalent. - MiMo-V2.5-Pro — Le spécialiste « Agent ».

1,02T paramètres totaux,42B actifMême architecture d'attention hybride, mais optimisée pour le codage à long terme et les trajectoires de milliers d'appels d'outils. - MiMo-V2.5-TTS — Une suite vocale à trois modèles (TTS, VoiceDesign, VoiceClone) pour la génération de parole de production, avec un contrôle des instructions de style sur la vitesse, l'émotion et le ton.

- MiMo-V2.5-ASR — Reconnaissance vocale de bout en bout qui gère les dialectes chinois (Wu, cantonais, hokkien, sichuanais), la parole codée, les paroles de chansons et les environnements acoustiques bruyants.

Les deux modèles phares partagent une technologie interne. attention aux fenêtres coulissantes hybrides Architecture héritée de MiMo-V2-Flash, avec des encodeurs vidéo et audio dédiés connectés via des projecteurs légers. Les deux sont livrés avec un logiciel natif. fenêtre de contexte de 1 048 576 jetonsAucun des deux ne facture de multiplicateur de longueur de contexte — Xiaomi l'a supprimé le jour du lancement.

Comparaison entre MiMo V2.5, Claude Opus, Gemini 3 Pro et GPT-5.4

Le principal critère de référence — et celui avec lequel Xiaomi a lancé sa campagne — est ClawEval, une suite de tâches multi-tours où le modèle doit planifier, appeler des outils et itérer sur de longs horizons. le un benchmark qui correspond aux charges de travail réelles des agents de production, et c'est là que MiMo V2.5 semble le plus performant.

| Modèle | Passe d'évaluation de la griffe³ | Jetons / Trajectoire | Rang ajusté aux coûts |

|---|---|---|---|

| MiMo V2.5-Pro | 63,8 – 64,0 % | ~70K | #1 (Frontière de Pareto) |

| MiMo V2.5 (base) | 62,3% | ~75K | Frontière liée |

| Claude Opus 4.6 | ~65,4% | ~120–175K | coût plus élevé |

| Gemini 3.1 Pro | ~63% | ~115K | coût plus élevé |

| GPT-5.4 | ~62% | ~110K | coût plus élevé |

Conclusion : Claude Opus 4.6 conserve un léger avantage en termes de capacités brutes.Mais MiMo V2.5-Pro atteint les mêmes performances tout en dépensant environ 40 à 60 % de jetons en moins. En termes de prix par trajet, c'est… pas une erreur d'arrondi. Comme VentureBeat a notéDans un monde où GitHub Copilot et la plupart des plateformes d'agents adoptent une facturation basée sur l'utilisation, cette efficacité en termes de jetons se traduit directement en argent réel pour toute équipe gérant des agents à grande échelle.

Sur d'autres points, le portrait est celui d'un spécialiste privilégiant le codage :

- SWE-bench Pro :

57,2%— à un demi-point près de Claude Opus 4.6 et GPT-5.4. - Terminal-Bench 2.0 : Surpasse largement Opus 4.6 et Gemini 3.1 Pro.

- Vidéo-MME :

87,7— équivalent au Gemini 3 Pro en matière de compréhension vidéo. - GDPVal-AA (Elo) :

1581— surpasse Kimi K2.6 et GLM 5.1. - Rappel de contexte long (1M) :

0,37 BFS / 0,62 Parents— là où la plupart des concurrents s'effondrent à presque zéro au-delà de 512 000.

Ses lacunes : HLE (Le dernier examen de l'humanité) et Raisonnement général GDPVal-AA Ces deux modèles privilégient la polyvalence à l'expertise pointue en programmation. Si vous avez besoin d'un tuteur ou d'un esprit universel, ce modèle ne vous convient pas. En revanche, si vous avez besoin d'un agent capable de déployer du code, alors il est parfaitement adapté.

Que peut faire concrètement le MiMo V2.5-Pro ?

Les benchmarks, c'est une chose. Xiaomi est allé plus loin et en a publié quatre exécutions de tâches autonomes de plusieurs heures — le genre de travail où l'agent ne peut pas être assisté manuellement. Ce sont ces démonstrations qu'il faut prendre au sérieux, car elles incluent la trace complète des appels d'outils.

C'est l'exécution du compilateur Rust qu'il faut absolument maîtriser. Ce n'est pas un gadget. C'est un véritable projet de cours PKU, avec une véritable suite de tests non officielle, et un modèle propriétaire de pointe aurait eu bien du mal à le réaliser du premier coup avec un budget aussi limité. Voilà à quoi ressemble concrètement la notion de « cohérence à long terme » en production.

Prix du MiMo V2.5 : et pourquoi c’est la vraie histoire

C’est là que le positionnement open source devient intéressant. MiMo V2.5 est distribué sous licence haltères ouvertes sur Hugging Face pour l'auto-hébergement, mais Xiaomi propose également une API hébergée avec des tarifs agressifs — et un modèle d'abonnement « Token Plan » qui ressemble aux offres à tarif fixe de Claude Code et d'OpenAI.

Deux points à signaler : les accès au cache font baisser le coût d’entrée jusqu’à un niveau très bas. 0,20 $–0,40 $ par million de jetons, et Xiaomi a effectué l'écriture du cache gratuitement pour une période de lancement limitée. Le multiplicateur de contexte de 1 million a également disparu. Si vous utilisez des agents à long terme, l'écart de coût réel par rapport aux modèles propriétaires de pointe est plus proche de 10× que 5×.

Pour les équipes qui préfèrent un tarif forfaitaire, il existe un système à quatre niveaux. Plan de jetons va de 63,36 $/an (Lite, 720 millions de crédits) à 1 056 $/an (Max, 19,2 milliards de crédits) — et est compatible avec Claude Code, OpenCode et Kilo en tant que structures prêtes à l'emploi.

Devriez-vous utiliser MiMo V2.5 ? Avantages, inconvénients et à qui cela s'adresse.

Points forts

- Meilleure efficacité de jetons de sa catégorie sur les tâches d'agent (40 à 60 % de jetons en moins que Claude Opus 4.6).

- Un véritable contexte utilisable pour 1 million de jetons — ne s'effondre pas au-delà de 512 000 comme la plupart de ses concurrents.

- Multimodal natif dans un seul modèle (image, vidéo, audio, texte).

- Poids libres sur Hugging Face — auto-hébergés et finement réglables.

- « Exploiter la conscience » — gère activement son propre contexte à travers des milliers d'appels d'outils.

- Compatible avec Claude Code, OpenCode et Kilo.

Faiblesses

- Parcours sur des bancs d'essai de raisonnement général (HLE, GDPVal-AA) — conception axée sur le codage.

- Les chiffres autodéclarés concernant l'efficacité des jetons nécessitent une réplication indépendante.

- L'infrastructure hébergée hors de Chine est encore en développement — la latence est variable.

- L'écosystème d'appel d'outils et les intégrations de harnais sont moins éprouvés que Claude ou GPT.

- La documentation et le soutien communautaire sont encore en train de rattraper leur retard par rapport aux prestataires occidentaux.

Qui devrait utiliser MiMo V2.5

Si vous construisez flux de travail de codage agentiel — Vision à long terme, multi-outils, évolutivité — et si votre rentabilité dépend du coût du jeton, MiMo V2.5-Pro est désormais en lice. Il en va de même pour toute équipe gérant des agents multimodaux nécessitant une compréhension poussée de la vidéo ou des documents.

Qui devrait rester fidèle à Claude ou à GPT ?

Si votre charge de travail principale est discussion de fond, synthèse de recherche ou travaux de connaissances généralesClaude Opus 4.7 et GPT-5.5 conservent leur avantage. Les modèles occidentaux bénéficient également d'écosystèmes d'outils plus matures, d'une plus grande stabilité éprouvée en production et de garanties plus solides en matière de gestion des données d'entreprise.

Foire aux questions

MiMo V2.5 est-il réellement open source ?

MiMo V2.5 est-il meilleur que Claude Opus 4.7 ?

Quel est le prix de MiMo V2.5 via API ?

Puis-je utiliser MiMo V2.5 avec Claude Code ou OpenCode ?

De quel matériel ai-je besoin pour héberger moi-même MiMo V2.5 ?

Qu’est-ce que la « sensibilisation au harnais » et pourquoi est-ce important ?

La frontière de l'open source vient de se déplacer.

MiMo V2.5 ne remplace pas Claude Opus pour toutes les charges de travail, mais pour le développement multi-agents à grande échelle, il s'impose comme la nouvelle référence en termes de rapport coût-efficacité, et l'écart avec les solutions propriétaires est désormais minime. Nous suivrons son déploiement en conditions réelles, les benchmarks tiers et son adoption par l'écosystème au fur et à mesure de son évolution.

Se connecter

Se connecter