¿Qué es Apache MXNet?

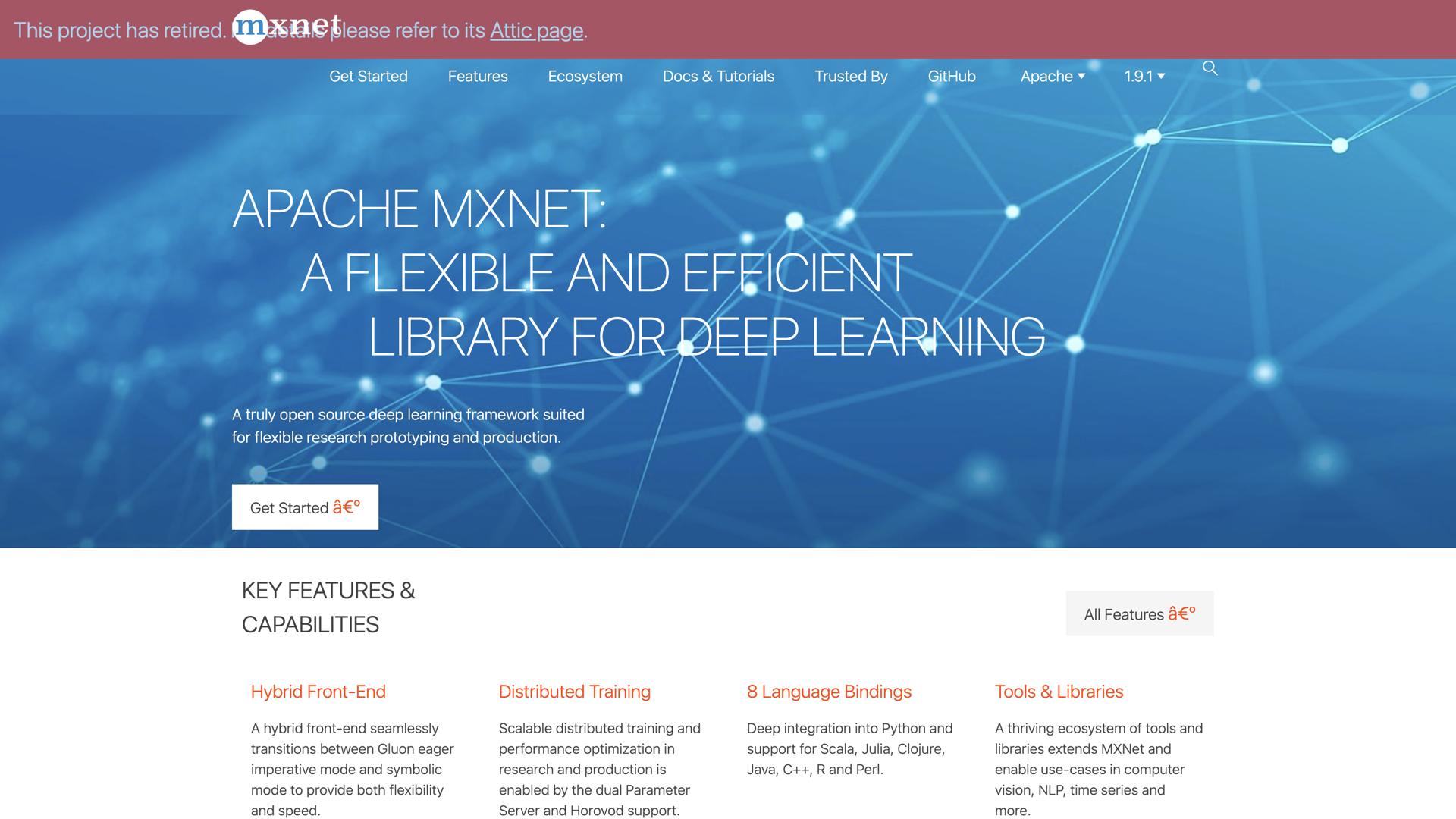

Apache MXNet es un marco de aprendizaje profundo de código abierto que permite a los desarrolladores crear, entrenar e implementar modelos de aprendizaje automático potentes de forma rápida y sencilla. Con Apache MXNet, los desarrolladores pueden desarrollar e implementar modelos utilizando lenguajes de programación tradicionales como Python y Ry utilizar herramientas como Keras y Gluon para acelerar el proceso.

Apache MXNet también proporciona un Amplia biblioteca de modelos de aprendizaje profundo, incluyendo redes convolucionales, redes recurrentes y perceptrones multicapa, lo que facilita a los desarrolladores el desarrollo y la implementación rápidos de sus propios modelos personalizados. Apache MXNet también admite formación distribuida, lo que permite a los desarrolladores aprovechar los potentes clústeres de GPU para un entrenamiento de modelos más rápido.

Con Apache MXNet, los desarrolladores pueden crear, entrenar e implementar modelos de aprendizaje automático de forma rápida y sencilla, lo que les da la capacidad de crear aplicaciones avanzadas que pueden Aprende de los datos y haz predicciones..

Casos de uso y características

1. Aprovechar la amplia biblioteca de Apache MXNet de modelos de aprendizaje profundo para desarrollar rápidamente modelos personalizados.

2. Utilice el entrenamiento distribuido de Apache MXNet. para aprovechar los potentes clústeres de GPU.

3. Utilizar los lenguajes de programación Python y R. para crear e implementar modelos Apache MXNet.

Interacción con el sitio web de la herramienta

Última actualización: hace 2 años

- Descargo de responsabilidad: Las estadísticas provienen de proveedores externos. Su precisión puede variar.

Total de visitas mensuales: 8M

Tasa de rebote: 52%

Duración de la visita (promedio): 251,52 segundos

Páginas por visita: 3,78

Clasificación del país: 156

Clasificación mundial: 7.719

Tráfico mensual

Fuentes de tráfico

Cuota de tráfico por país

Porcelana: 19,60%

Estados Unidos: 13,75%

India: 9,25%

Alemania: 2,88%

Rusia: 2,80%

Acceso

Acceso