const { OpenAI } = require('openai');

const api = new OpenAI({

baseURL: 'https://api.ai.cc/v1',

apiKey: '',

});

const main = async () => {

const result = await api.chat.completions.create({

model: 'deepseek/deepseek-non-reasoner-v3.1-terminus',

messages: [

{

role: 'system',

content: 'You are an AI assistant who knows everything.',

},

{

role: 'user',

content: 'Tell me, why is the sky blue?'

}

],

});

const message = result.choices[0].message.content;

console.log(`Assistant: ${message}`);

};

main();

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.ai.cc/v1",

api_key="",

)

response = client.chat.completions.create(

model="deepseek/deepseek-non-reasoner-v3.1-terminus",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices[0].message.content

print(f"Assistant: {message}")

Detalles del producto

✨ Chat de DeepSeek V3.1 es un modelo de IA conversacional híbrido especializado centrado en respuestas rápidas y directas sin recurrir a razonamientos complejos. Basándose en la arquitectura DeepSeek V3.1, esta variante omite el modo de pensamiento Prioriza la baja latencia en las salidas, manteniendo al mismo tiempo sólidas capacidades multimodales. Está optimizado para aplicaciones que requieren interacciones eficientes y directas en chat, generación de código y flujos de trabajo de agentes, y resulta ideal para desarrolladores y empresas que valoran la rapidez de respuesta y la ejecución ágil de tareas.

Especificaciones técnicas

- Ventana de contexto hasta 128.000 tokens para facilitar conversaciones prolongadas de varios turnos y sesiones de codificación.

- Límite de tokens de salida hasta 8.000 tokens Optimizado para respuestas concisas y coherentes.

- Arquitectura de transformador híbrido con Capas de mezcla de expertos (MoE) para una asignación eficiente de recursos computacionales.

- Admite llamadas a herramientas estructuradas, funcionalidad de agentes de código y agentes de búsqueda para mejorar la flexibilidad de las tareas.

- Entrenamiento extendido en conjuntos de datos de contexto extenso utilizando microescalado FP8 para una mayor eficiencia en la inferencia.

- Soporte multilingüe en Más de 100 idiomas con alta precisión contextual.

Características principales

🚀 DeepSeek V3.1 Chat funciona exclusivamente en un modo no pensante que entrega Respuestas rápidas y directas sin recurrir a un razonamiento de varios pasos. Esta configuración permite una capacidad extremadamente interacciones de baja latencia Ideal para consultas sencillas y ejecución de tareas. El modelo conserva capacidades mejoradas de llamada a herramientas y agentes, lo que permite una integración fluida con agentes de código y agentes de búsqueda para flujos de trabajo versátiles. Basado en una arquitectura de transformador MoE optimizada, logra un uso eficiente de los recursos a la vez que admite llamadas a funciones estructuradas para una invocación precisa de herramientas. Si bien no realiza razonamiento profundo, es ideal para chat multimodal, generación rápida de código y flujos de trabajo de agentes optimizados que requieren resultados rápidos y fiables.

Rendimiento y capacidades

- ⚡ Tiempos de respuesta rápidos con una utilización optimizada de las herramientas y una mínima sobrecarga computacional.

- Alta precisión en la generación directa de código y la ejecución de tareas con bajas tasas de error.

- Manejo eficaz de entradas multimodales, incluyendo texto e imágenes, enfocado en tareas que no requieren razonamiento.

- Adaptable a entornos de ingeniería de software, asistencia a la investigación y aplicaciones basadas en agentes.

Casos de uso

- Asistencia rápida en ingeniería de software, incluyendo síntesis de código y depuración.

- Chatbots multimodales centrados en la comprensión de imágenes y texto con respuestas inmediatas.

- Investigación rutinaria y análisis de documentos con requisitos de contexto moderados.

- Diálogo eficiente de múltiples turnos, idóneo para herramientas educativas básicas orientadas a tareas.

- Procesos de inteligencia empresarial que hacen hincapié en la interpretación visual rápida de los datos.

- Aplicaciones basadas en agentes que requieren llamadas a herramientas inteligentes sin una sobrecarga de razonamiento profundo.

Precios de API

• 1 millón de tokens de entrada: $0.294

• 1 millón de tokens de salida: $0.441

Ejemplo de código

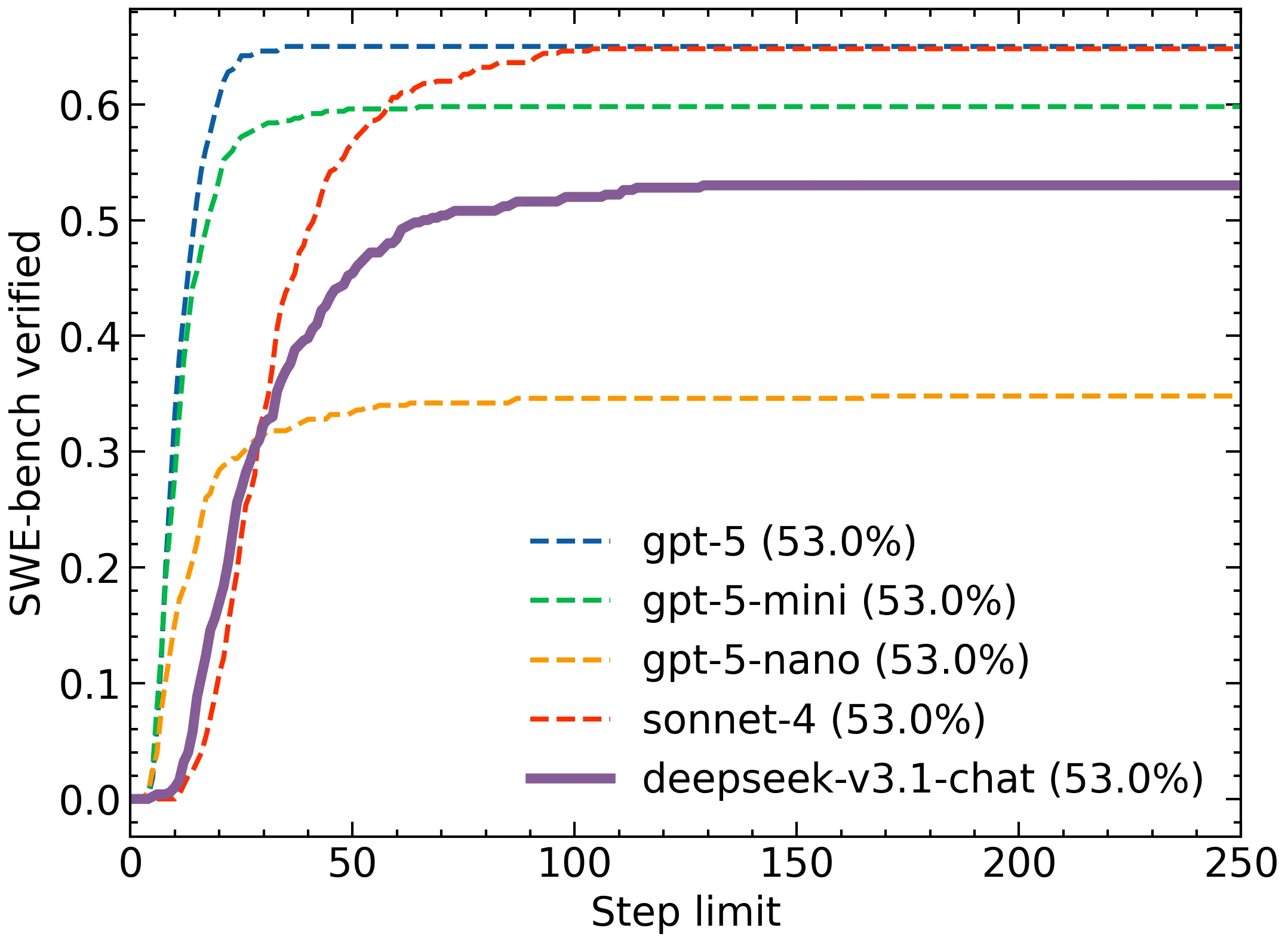

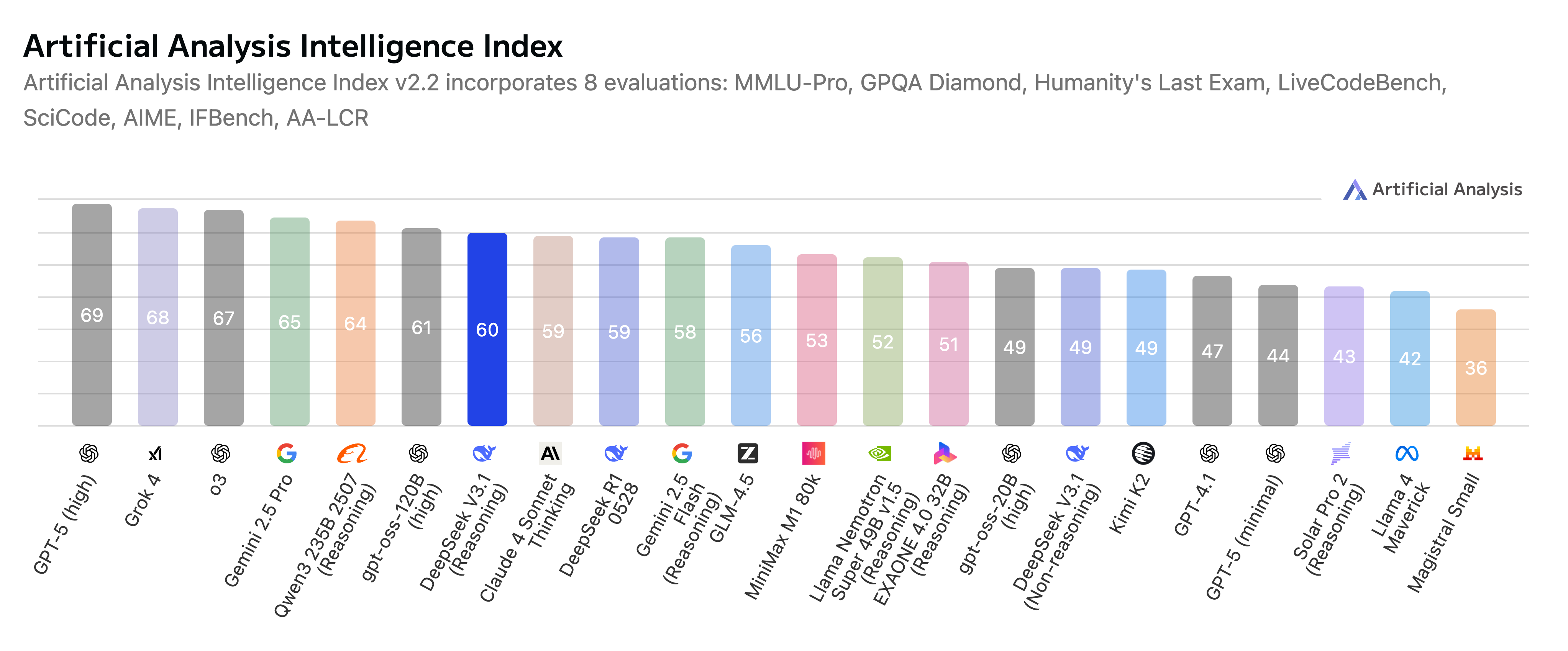

Comparación con otros modelos

DeepSeek V3.1 Chat ofrece un equilibrio óptimo entre inferencia de alta velocidad, sólida integración multimodal y rentabilidad para casos de uso donde el razonamiento profundo no es necesario. Está diseñado para desarrolladores y empresas que priorizan la velocidad y la ejecución optimizada de tareas en flujos de trabajo de IA conversacional multimodal y agentes.

💡 vs GPT-5: Si bien GPT-5 cuenta con una ventana de contexto de 400 000 tokens mucho mayor e incluye modalidades de audio y video emergentes, además de capacidades de texto e imagen, DeepSeek V3.1 Chat destaca por una mayor integración de la manipulación del contexto visual, una modularidad experta dinámica para un procesamiento eficiente y herramientas avanzadas de adaptación de dominio. DeepSeek ofrece un sólido enfoque de modelo de ponderación abierta con ventajas en cuanto a costos y se especializa en el razonamiento de imágenes complejas y la fusión multimodal, mientras que GPT-5 lidera en escala de contexto y amplitud multimodal con integración en el ecosistema empresarial.

💡 vs DeepSeek V3: La nueva versión mejora la velocidad de inferencia en aproximadamente un 30 %, amplía la ventana de contexto de 128 KB a una escala más flexible optimizada para tareas de chat y mejora significativamente la precisión de la alineación multimodal. Estas mejoras permiten un mejor razonamiento, especialmente en lenguajes con pocos recursos y escenarios visuales complejos, lo que la hace más capaz para la IA conversacional avanzada y la comprensión de código a gran escala.

💡 vs OpenAI GPT-4.1: En comparación con la arquitectura de GPT-4.1, optimizada para el código y centrada en el texto, DeepSeek V3.1 equilibra las entradas multimodales a gran escala con un sofisticado método de entrenamiento de mezcla de expertos. Este equilibrio proporciona una coherencia visual-textual superior y una adaptación más rápida a diversas tareas multimodales, lo que hace que DeepSeek sea especialmente adecuado para flujos de trabajo que requieren una integración perfecta de texto e imágenes con razonamiento avanzado.

Preguntas frecuentes (FAQ)

¿Cuál es el objetivo principal del chat de DeepSeek V3.1?

DeepSeek V3.1 Chat está diseñado para IA conversacional rápida y directaPriorizando las respuestas de baja latencia para consultas sencillas y la ejecución de tareas, en lugar de razonamientos complejos de varios pasos.

¿Cómo logra DeepSeek V3.1 Chat tiempos de respuesta tan rápidos?

El modelo opera exclusivamente en un modo "no pensante", omitiendo el razonamiento de múltiples pasos para ofrecer resultados inmediatos. Su arquitectura de transformador optimizada de Mezcla de Expertos (MoE) también contribuye a un uso eficiente de los recursos y a una mayor velocidad.

¿Qué capacidades multimodales ofrece DeepSeek V3.1 Chat?

Mantiene sólidas capacidades multimodales, lo que permite interacciones eficientes en todos los ámbitos. texto e imágenes Para tareas como el chat multimodal y la generación rápida de código, incluso sin funcionalidad de razonamiento profundo.

¿En qué escenarios resulta más eficaz DeepSeek V3.1 Chat?

Está optimizado para aplicaciones que requieren interacciones eficientes y sencillas En chat, generación de código y flujos de trabajo de agentes, resulta ideal para desarrolladores y empresas que valoran los tiempos de respuesta rápidos y la ejecución optimizada de tareas.

Campo de juegos de IA

Acceso

Acceso