const { OpenAI } = require('openai');

const api = new OpenAI({

baseURL: 'https://api.ai.cc/v1',

apiKey: '',

});

const main = async () => {

const result = await api.chat.completions.create({

model: 'deepseek/deepseek-v3.2-speciale',

messages: [

{

role: 'system',

content: 'You are an AI assistant who knows everything.',

},

{

role: 'user',

content: 'Tell me, why is the sky blue?'

}

],

});

const message = result.choices[0].message.content;

console.log(`Assistant: ${message}`);

};

main();

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.ai.cc/v1",

api_key="",

)

response = client.chat.completions.create(

model="deepseek/deepseek-v3.2-speciale",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices[0].message.content

print(f"Assistant: {message}")

Detalles del producto

DeepSeek V3.2 Especial es un modelo de lenguaje grande (LLM) avanzado y centrado en el razonamiento, diseñado para sobresalir en la resolución de problemas lógicos de varios pasos y el procesamiento de contexto extenso. Con una impresionante ventana de contexto de hasta 128.000 tokensEstá diseñado para tareas analíticas complejas. Una característica innovadora, modo "solo pensar"Esto permite que el modelo realice un razonamiento interno silencioso antes de generar cualquier resultado. Este enfoque innovador mejora significativamente la precisión, la coherencia fáctica y la deducción paso a paso, especialmente para consultas complejas.

Este modelo cumple con las especificaciones de prefijo de chat/completado FIM de DeepSeek y ofrece sólidas capacidades de llamada a herramientas. Accesible a través de un punto final Speciale durante periodos limitados, tiende un puente entre la investigación de vanguardia y las aplicaciones prácticas de razonamiento de IA, garantizando la coherencia analítica en diversos ámbitos como la generación de código, los cálculos matemáticos y la exploración científica.

✨ Especificaciones técnicas ✨

- ✅ Arquitectura: Maestría en Derecho (LLM) con especialización en razonamiento basado en texto

- ✅ Longitud del contexto: 128.000 tokens

- ✅ Capacidades: Chat, razonamiento avanzado, uso de herramientas, finalización de FIM

- ✅ Datos de entrenamiento: Conjuntos de datos optimizados para el razonamiento, alineación de la retroalimentación humana

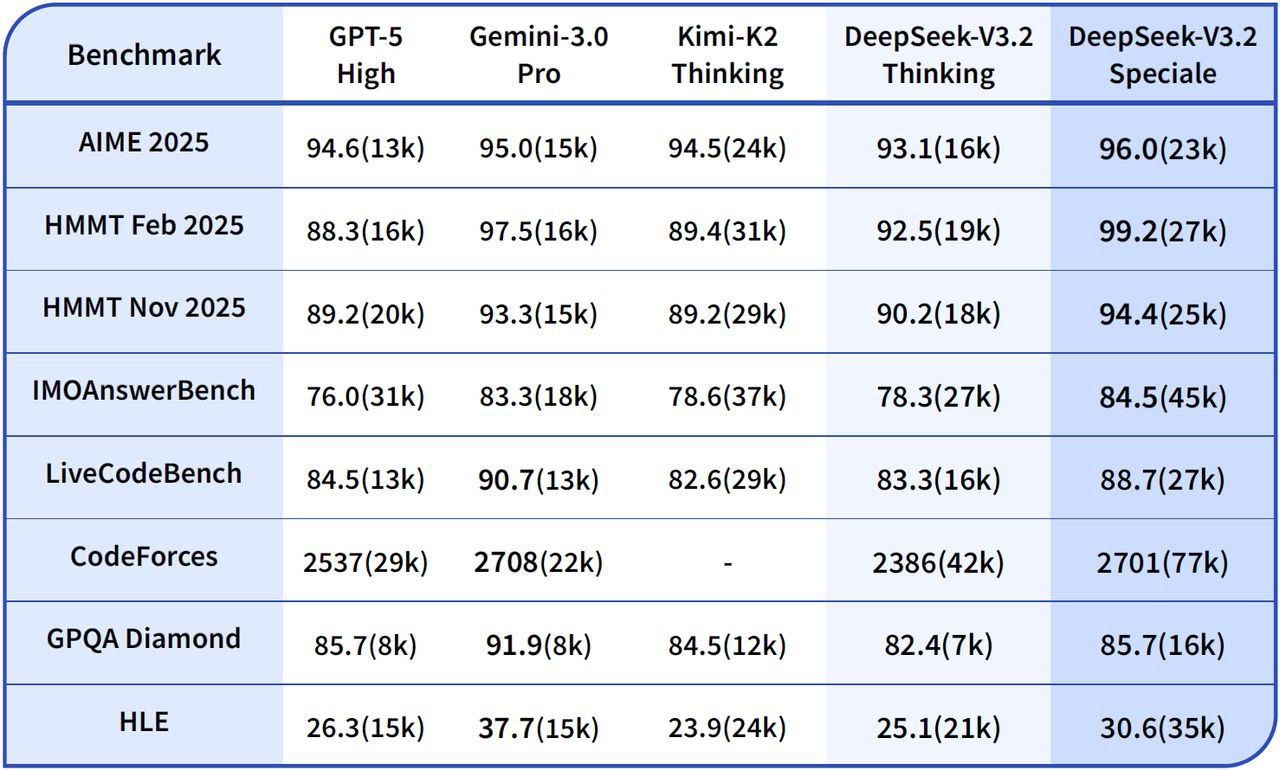

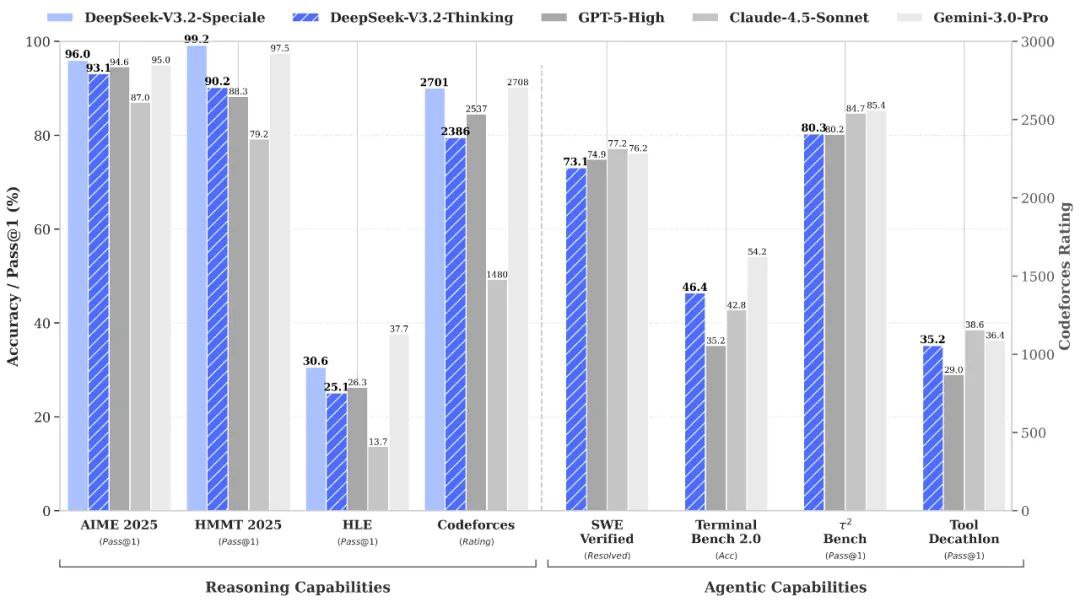

🧠 Pruebas de rendimiento 🧠

- 📈 Razonamiento complejo: Demuestra una mayor estabilidad en cadenas de varios pasos, incluidas tareas matemáticas y simbólicas.

- 💻 Síntesis/depuración de código: Proporciona una mejor explicabilidad de los registros, lo que facilita los procesos de desarrollo y depuración.

💡 Calidad de salida y rendimiento de razonamiento 💡

🌟 Mejoras de calidad

- ✔️ Razonamiento coherente: Los hilos de razonamiento consistentes mantienen la coherencia a lo largo de más de 100.000 tokens.

- ✔️ Recuperación de errores mejorada: Mejora de la recuperación de errores durante secuencias largas mediante el control adaptativo de la atención.

- ✔️ Precisión simbólica superior: Supera a los modelos anteriores de DeepSeek en lógica multivariable e inferencia de código.

- ✔️ Tono analítico equilibrado: Ofrece explicaciones precisas al tiempo que reduce el sobreajuste o la deriva semántica.

⚠️ Limitaciones

- Tono formal: Puede sonar demasiado formal o rígido en tareas informales.

- Mayor latencia: El modo "solo procesamiento" aumenta ligeramente la latencia en cadenas de procesamiento muy complejas.

- Variación creativa limitada: Mínima variación en el tono creativo en comparación con los másteres en Derecho orientados a la narración de historias.

🚀 Nuevas funciones y mejoras técnicas 🚀

DeepSeek-V3.2-Speciale introduce marcos de razonamiento innovadores y capas de optimización internas, diseñadas para ofrecer una estabilidad, interpretabilidad y precisión en contextos extensos superiores.

Actualizaciones clave

- 🧠 Modo Solo Pensar: Añade un paso cognitivo silencioso antes de la salida visible para el usuario, lo que reduce drásticamente las tasas de contradicción y las alucinaciones para obtener respuestas más fiables.

- 📏 Ventana de contexto extendida (128K): Permite la síntesis exhaustiva de documentos extensos, la memoria de diálogos sostenida y el razonamiento basado en datos a partir de múltiples fuentes.

- 🔍 Auditoría interna de la cadena de suministro: Ofrece una mayor visibilidad del rastro de razonamiento, algo invaluable para los investigadores que validan inferencias de varios pasos y garantizan la transparencia.

- ✏️ Completar FIM (Fill-in-the-Middle): Facilita las inserciones a nivel de contexto y la aplicación de parches de código estructurados sin necesidad de volver a enviar la solicitud completa, lo que aumenta la eficiencia de los desarrolladores.

Impacto práctico

Estas importantes mejoras se traducen en una mayor profundidad interpretativa en matemáticas, lógica científica y tareas analíticas extensas. Por lo tanto, DeepSeek V3.2 Speciale es ideal para sofisticados sistemas de automatización y experimentos avanzados de investigación cognitiva.

💰 Precios de la API 💰

- Aporte: 0,2977 dólares por cada millón de tokens

- Producción: 0,4538 dólares por cada millón de tokens

💻 Ejemplo de código 💻

# Código Python de ejemplo para la llamada a la API DeepSeek V3.2 Speciale import openai client = openai.OpenAI( base_url="https://api.deepseek.com/v1", api_key="YOUR_API_KEY" ) response = client.chat.completions.create( model="deepseek/deepseek-v3.2-speciale", messages=[ {"role": "user", "content": "Explica el concepto de entrelazamiento cuántico de forma lógica paso a paso."}, {"role": "assistant", "content": "(Modo de solo pensamiento activado: deconstruyendo la consulta, identificando conceptos clave, planificando la progresión lógica, recordando principios físicos relevantes, estructurando la explicación en pasos discretos.)"} ], # El modo 'solo pensamiento' es un mecanismo interno. # La llamada a la API en sí sigue siendo estándar, pero el procesamiento interno del modelo cambia. temperature=0.7, max_tokens=500 ) print(respuesta.opciones[0].mensaje.contenido) 🆚 Comparación con otros modelos 🆚

DeepSeek V3.2 Especial vs. Gemini-3.0-Pro: Las pruebas de rendimiento indican que DeepSeek-V3.2-Speciale alcanza un rendimiento general comparable al de Gemini-3.0-Pro. Sin embargo, DeepSeek pone un énfasis significativamente mayor en el razonamiento transparente y gradual, lo que lo hace particularmente ventajoso para aplicaciones de IA con agentes.

DeepSeek V3.2 Especial vs. GPT-5: Las evaluaciones publicadas sitúan a DeepSeek-V3.2-Speciale por delante de GPT-5 en tareas de razonamiento exigentes, especialmente en pruebas comparativas con un alto componente matemático y de estilo competitivo. Además, mantiene una alta competitividad en codificación y fiabilidad en el uso de herramientas, lo que la convierte en una alternativa atractiva para tareas complejas.

DeepSeek V3.2 Especial vs. DeepSeek-R1: Speciale está diseñado para escenarios de razonamiento aún más complejos, con una ventana de contexto de 128 KB y un "modo de pensamiento" de alta capacidad de procesamiento. Esto lo hace excepcionalmente adecuado para marcos de trabajo de agentes avanzados y experimentos de referencia, diferenciándolo de DeepSeek-R1, que está diseñado para un uso interactivo más informal.

💬 Comentarios de la comunidad 💬

Comentarios de los usuarios en plataformas como Reddit DeepSeek V3.2 Speciale destaca constantemente como una herramienta excepcional para tareas de razonamiento de alto riesgo. Los desarrolladores elogian particularmente su dominio en las pruebas de rendimiento y su impresionante eficiencia en costos, señalando su superioridad sobre GPT-5 en pruebas de rendimiento matemáticas, de código y lógicas, a menudo en un Coste 15 veces menorMuchos lo describen como "extraordinario" para flujos de trabajo automatizados y resolución de problemas complejos. Los usuarios también elogian su impresionante coherencia en largas cadenas, la significativa reducción de errores y su profundidad "similar a la humana", especialmente en comparación con versiones anteriores de DeepSeek.

❓ Preguntas frecuentes (FAQ) ❓

P1: ¿Cuál es el enfoque principal de DeepSeek V3.2 Speciale?

A1: Se centra principalmente en el razonamiento avanzado y la resolución de problemas lógicos de varios pasos, y está diseñado para tareas analíticas complejas en los ámbitos de la programación, las matemáticas y las ciencias.

P2: ¿Cómo funciona el modo "solo pensar"?

A2: Este modo permite que el modelo realice un razonamiento interno silencioso antes de generar cualquier resultado visible. Este proceso cognitivo interno mejora significativamente la precisión, la coherencia fáctica y el flujo lógico de las respuestas, especialmente en consultas complejas.

P3: ¿Cuál es la longitud máxima del contexto para DeepSeek V3.2 Speciale?

A3: DeepSeek V3.2 Speciale admite una ventana de contexto extendida de hasta 128 000 tokens, lo que le permite manejar documentos muy largos, mantener una memoria de diálogo sostenida y realizar razonamientos basados en datos a través de múltiples fuentes.

P4: ¿Cómo se compara su precio con el de otros modelos?

A4: Los comentarios de la comunidad sugieren que DeepSeek V3.2 Speciale ofrece precios muy competitivos, y los desarrolladores informan que puede costar hasta 15 veces menos que algunos competidores como GPT-5 para tareas complejas similares.

P5: ¿Es DeepSeek V3.2 Speciale adecuado para tareas de escritura creativa?

A5: Si bien posee una gran capacidad de razonamiento analítico, sus "limitaciones" incluyen una mínima variación en el tono creativo en comparación con los másteres en Derecho orientados a la narración. Puede resultar demasiado formal o rígido para tareas informales o altamente creativas.

Campo de juegos de IA

Acceso

Acceso