const { OpenAI } = require('openai');

const api = new OpenAI({

baseURL: 'https://api.ai.cc/v1',

apiKey: '',

});

const main = async () => {

const result = await api.chat.completions.create({

model: 'zhipu/glm-4.6',

messages: [

{

role: 'system',

content: 'You are an AI assistant who knows everything.',

},

{

role: 'user',

content: 'Tell me, why is the sky blue?'

}

],

});

const message = result.choices[0].message.content;

console.log(`Assistant: ${message}`);

};

main();

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.ai.cc/v1",

api_key="",

)

response = client.chat.completions.create(

model="zhipu/glm-4.6",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices[0].message.content

print(f"Assistant: {message}")

Detalles del producto

✨ Descripción general de la API GLM-4.6

GLM-4.6 es un modelo de lenguaje grande avanzado desarrollado por Zhipu AI (ahora Z.ai)Cuenta con un sistema de última generación de 355 mil millones de parámetros. Arquitectura de mezcla de expertos (MoE)Optimizado para una amplia gama de tareas que incluyen razonamiento complejo, codificación, escritura y diálogo de múltiples turnos, GLM-4.6 ofrece una funcionalidad extendida. Ventana de contexto de 200.000 tokensEste modelo demuestra un rendimiento líder en la industria, especialmente en tareas de programación y de agentes, lo que lo convierte en una opción ideal para desarrolladores y empresas que buscan eficiencia y versatilidad.

⚙️ Especificaciones técnicas

- Arquitectura del modelo: 355B Parámetro Mezcla de Expertos (MoE)

- Modalidad de entrada: Texto

- Modalidad de salida: Texto

- Tamaño de la ventana de contexto: 200.000 tokens (Ampliado desde 128.000 en GLM-4.5)

- Tokens de salida máximos: 128.000 tokens

- Eficiencia: Aproximadamente Consumo de tokens un 30 % más eficiente que las versiones anteriores

- Lenguajes de programación compatibles: Python, JavaScript, Java (para tareas de programación)

📈 Indicadores de rendimiento

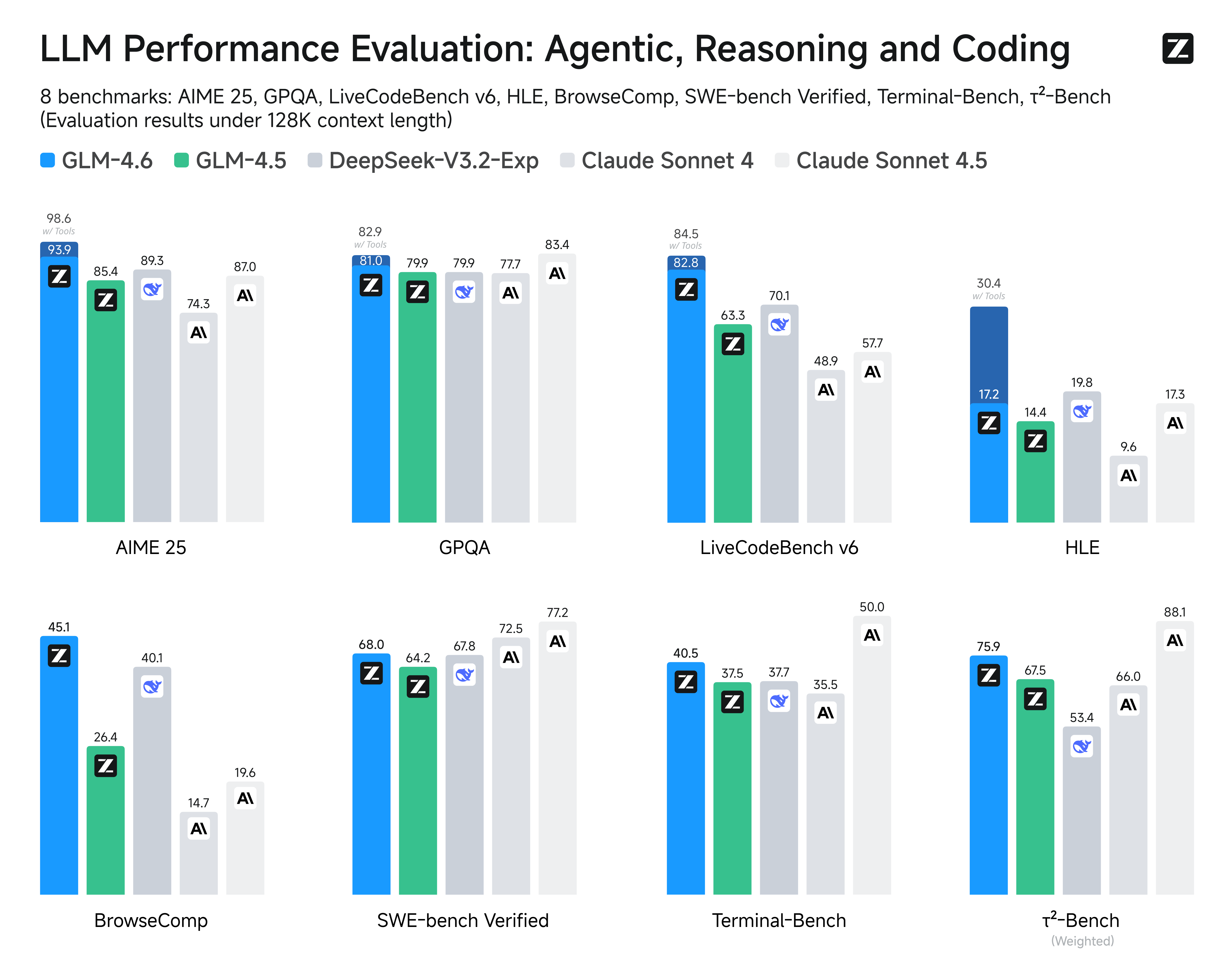

GLM-4.6 ha sido evaluado rigurosamente mediante pruebas comparativas autorizadas, demostrando resultados competitivos o superiores frente a los modelos líderes:

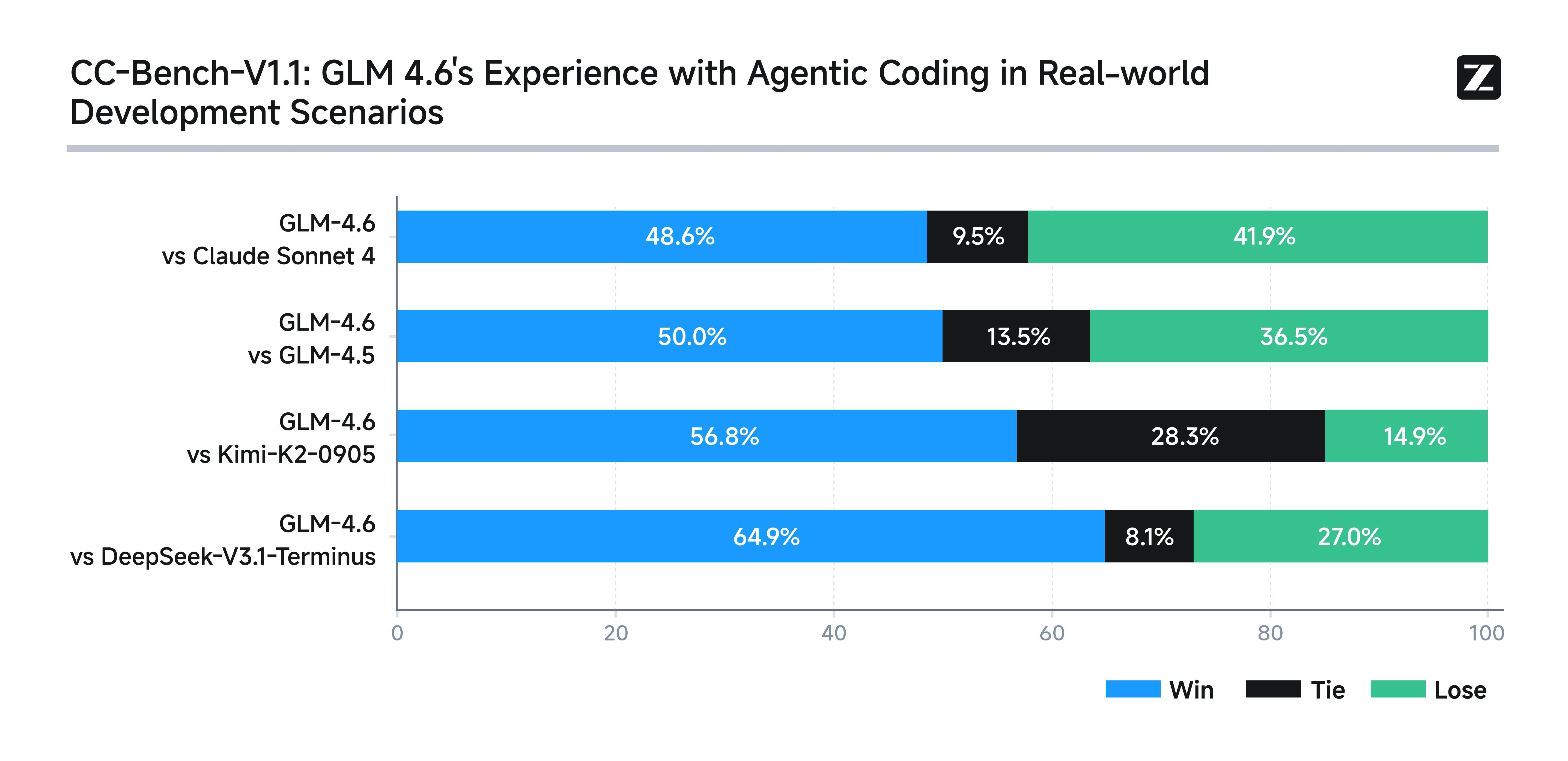

- Pruebas de codificación en el mundo real: Supera a modelos nacionales similares en 74 escenarios de codificación, demostrando una mayor corrección del código y un mejor rendimiento.

- Eficiencia comparativa: Consume aproximadamente un 30 % menos de fichas para obtener una producción equivalente, lo que reduce los costes y las necesidades de recursos.

- Resultados de referencia: Comparable a Claude Sonnet 4 y 4.6 en pruebas de rendimiento de PLN multidominio como AIME, GPQA, LCB v6 y SWE-Bench Verified.

- Razonamiento y tareas del agente: Excelente desempeño en la toma de decisiones y en tareas asistidas por herramientas, a menudo igualando o superando a la competencia en las pruebas comparativas.

- Comprensión del contexto: El contexto ampliado permite un rendimiento superior en tareas que requieren un análisis profundo de documentos e instrucciones complejas.

Imagen: Pruebas de rendimiento de GLM-4.6

💡 Características y capacidades clave

- Manejo de contexto extendido: Con una enorme Ventana de tokens de 200.000GLM-4.6 puede realizar una comprensión detallada de textos extensos, resolver problemas en varios pasos y mantener diálogos coherentes y prolongados.

- Rendimiento de codificación superior: Supera a GLM-4.5 y a muchos competidores nacionales en 74 pruebas prácticas de codificación dentro del entorno Claude Code. Destaca en el desarrollo front-end, la organización del código y la planificación autónoma.

- Razonamiento avanzado y toma de decisiones: Las capacidades mejoradas de uso de herramientas durante la inferencia permiten mejores marcos de agentes autónomos y una ejecución de tareas basada en búsquedas.

- Generación de lenguaje natural: Produce textos con una mejor adaptación a las preferencias estilísticas humanas, destacando en juegos de rol, creación de contenido (novelas, guiones, anuncios) y conversaciones de varios turnos.

Imagen: Características y capacidades clave de GLM-4.6

💰 Precios de la API GLM-4.6

- Aporte: $0.63

- Producción: $2.31

- En caché: $0.1155

🚀 Casos de uso para GLM-4.6

- Análisis de documentos de contexto extenso y resumen

- Razonamiento complejo de varios pasos y resolución de problemas

- Programación del mundo real y generación de código en múltiples lenguajes

- Creación de contenido en lenguaje natural incluyendo escritura creativa y guiones

- Chatbots con conversaciones sostenidas, coherentes y de múltiples turnos.

- Sistemas agentes con el uso de herramientas y la toma de decisiones autónoma

- Aplicaciones industriales de gran volumen que requieren modelos eficientes en tokens

💻 Ejemplo de código

Esta sección normalmente incluiría un fragmento de código interactivo para la integración de API, por ejemplo:

import openai from openai import OpenAI # Para Zhipu AI (Z.ai) GLM-4.6 client = OpenAI( api_key= "YOUR_API_KEY" , base_url= "https://api.z.ai/v1" , # Ejemplo de URL base ) completion = client.chat.completions.create( model= "zhipu/glm-4.6" , messages=[ { "role" : "system" , "content" : "Eres un asistente útil." }, { "role" : "user" , "content" : "Explica grandes modelos de lenguaje en términos sencillos." } ] ) print (completion.choices[0].message.content)⚖️ Comparación con otros modelos

Vs. GLM-4.5: GLM-4.6 ofrece mejoras notables en la precisión de la generación de código y mantiene una ventaja constante en el manejo de entradas de contexto ultralargas, al tiempo que conserva un sólido rendimiento en tareas de agentes similar al de GLM-4.5.

Vs. OpenAI GPT-4.5: GLM-4.6 reduce la brecha en el razonamiento y la precisión en tareas de varios pasos, aprovechando su ventana de contexto mucho mayor; sin embargo, GPT-4.5 sigue liderando en precisión bruta en algunas pruebas estandarizadas.

Vs. Soneto 4 de Claude: Si bien Claude 4 Sonnet destaca en codificación y eficiencia multiagente, GLM-4.6 lo iguala o supera en razonamiento agente y comprensión de documentos extensos, lo que lo hace más sólido para aplicaciones de contexto extendido.

Vs. Gemini 2.5 Pro: GLM-4.6 equilibra las capacidades avanzadas de razonamiento y codificación con una mejor comprensión de documentos extensos, mientras que Gemini 2.5 Pro se centra más en optimizar los puntos de referencia individuales de codificación y razonamiento.

🔗 Integración de API

Accesible a través de la API de IA/ML. Para obtener documentación detallada, consulte: Documentación de la API de GLM-4.6.

❓ Preguntas frecuentes (FAQ)

P1: ¿Qué es GLM-4.6 y qué mejoras significativas ofrece?

GLM-4.6 es la última versión de la serie de modelos de lenguaje general de Zhipu AI, que presenta mejoras sustanciales en las capacidades de razonamiento, el rendimiento multilingüe y el conocimiento especializado del dominio. Entre las mejoras clave se incluyen un razonamiento matemático y lógico avanzado, una mejor generación y comprensión de código, una mayor compatibilidad multilingüe con capacidades superiores para el idioma chino y una mayor eficiencia en el procesamiento de tareas complejas de varios pasos.

P2: ¿Cómo se compara GLM-4.6 con otros modelos de lenguaje líderes como GPT-4 y Claude?

GLM-4.6 demuestra un rendimiento competitivo con modelos de primer nivel, destacando especialmente en tareas de idioma chino, razonamiento matemático y aplicaciones de codificación. Si bien puede tener fortalezas diferentes a las de GPT-4 en escritura creativa o Claude en alineación de seguridad, a menudo iguala o supera a modelos comparables en dominios técnicos y comprensión de idiomas asiáticos. Su arquitectura eficiente también ofrece ventajas de costos para muchas aplicaciones empresariales.

P3: ¿Cuáles son las principales innovaciones técnicas en la arquitectura de GLM-4.6?

GLM-4.6 introduce varias innovaciones arquitectónicas: mecanismos de atención mejorados para un mejor manejo de contextos extensos, técnicas de entrenamiento optimizadas para el razonamiento matemático y lógico, tokenización optimizada para una mayor eficiencia multilingüe, enfoques avanzados de ajuste fino para dominios especializados y una mayor eficiencia de parámetros que ofrece un rendimiento sólido sin necesidad de una escala extrema. Estas innovaciones contribuyen a su rendimiento equilibrado en diversas tareas.

P4: ¿Para qué aplicaciones prácticas resulta especialmente adecuado GLM-4.6?

GLM-4.6 destaca en: aplicaciones empresariales para mercados asiáticos que requieren un sólido soporte en chino, documentación técnica y generación de código, análisis matemático y científico, herramientas educativas para disciplinas STEM, inteligencia empresarial y análisis de datos, y automatización de la atención al cliente multilingüe. Su rendimiento equilibrado la hace versátil para tareas creativas y analíticas en diversos sectores.

P5: ¿Cómo aborda GLM-4.6 las aplicaciones multilingües e interculturales?

GLM-4.6 ofrece sofisticadas capacidades multilingües, especialmente en chino y otros idiomas asiáticos, incluyendo la comprensión del contexto cultural, las expresiones idiomáticas y las variaciones regionales. El modelo demuestra un sólido aprendizaje por transferencia interlingüística, lo que permite un rendimiento eficaz incluso cuando los datos de entrenamiento no están distribuidos uniformemente entre los idiomas. Esto lo convierte en una herramienta especialmente valiosa para empresas globales que operan en mercados asiáticos o que requieren un soporte multilingüe robusto.

Campo de juegos de IA

Acceso

Acceso