Las empresas de la región Asia-Pacífico trasladan su infraestructura de IA al entorno perimetral para reducir los costes de inferencia.

Gasto en IA en el Asia Pacífico (APAC) La región está experimentando un crecimiento vertiginoso, pero muchas empresas tienen dificultades para obtener un retorno de la inversión tangible. El principal obstáculo es la infraestructura: los sistemas existentes a menudo no están diseñados para la velocidad ni la escala necesarias para la inferencia de IA moderna. Según estudios del sector, las elevadas inversiones en herramientas de IA general suelen quedar por debajo de los objetivos debido a estas limitaciones arquitectónicas.

Esta brecha de rendimiento resalta el papel crítico de Infraestructura de IA en la gestión de costes y la ampliación de las implementaciones. Para abordar esto, Elegante ha presentado su Nube de inferencia, impulsado por GPU NVIDIA Blackwellcon el objetivo de acercar la toma de decisiones al usuario para eliminar la latencia y reducir la sobrecarga.

Cerrando la brecha entre la experimentación y la producción.

Jay JenkinsEl director de tecnología de computación en la nube de Akamai señaló en una entrevista sobre la tendencia de que "las empresas de la región Asia-Pacífico trasladan la infraestructura de IA al borde de la red a medida que aumentan los costos de inferencia" que muchas iniciativas fracasan porque las organizaciones subestiman la transición de la fase piloto a la producción. Los elevados costos de infraestructura y la alta latencia suelen frenar el progreso.

Si bien las nubes centralizadas son la norma, se vuelven prohibitivamente caras a medida que aumenta su uso, sobre todo en regiones alejadas de los principales centros de datos. "La IA es tan potente como la infraestructura sobre la que se ejecuta." Jenkins subraya que la complejidad de la multinube y el cumplimiento de las normativas sobre datos complican aún más el panorama.

El cambio del entrenamiento de IA a la inferencia en tiempo real

A medida que la adopción de la IA madura en toda la región APAC, el enfoque está cambiando del entrenamiento ocasional de modelos a inferencia continuaEsta demanda operativa diaria consume la mayor parte de la capacidad de procesamiento, especialmente a medida que se implementan modelos de lenguaje, visión y multimodales en diversos mercados. Los sistemas centralizados, que nunca fueron diseñados para tal capacidad de respuesta, se están convirtiendo en el principal cuello de botella.

Infraestructura de borde optimiza esto mediante:

- Reduciendo la distancia de los datos: Acortar la ruta de transmisión de datos para garantizar respuestas más rápidas del modelo.

- Reducción de costes: Evitar los elevados costes de transferencia de datos asociados al enrutamiento de datos entre centros de datos en la nube distantes.

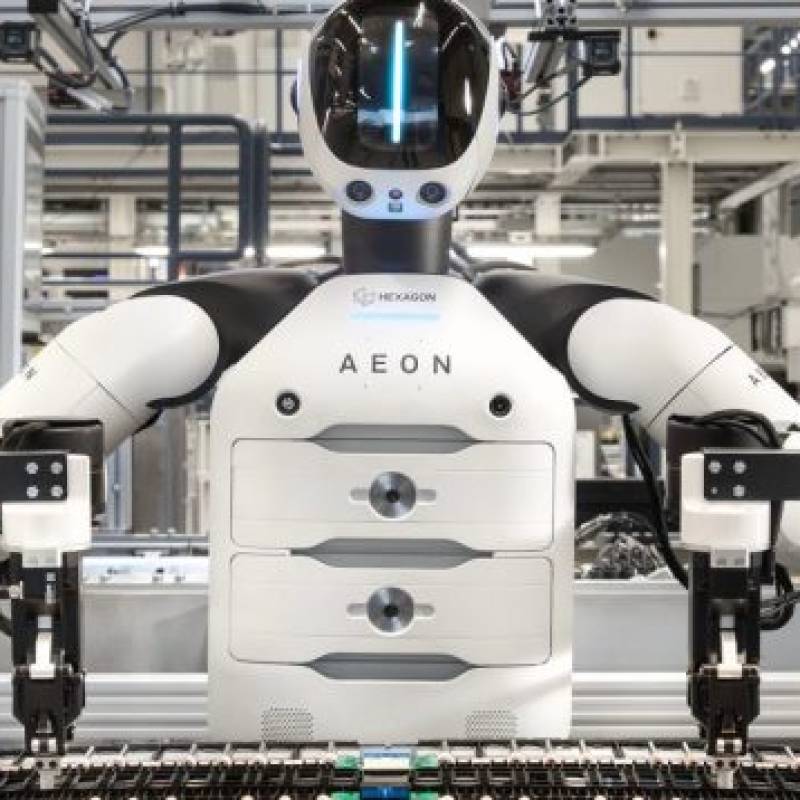

- Habilitación de la acción en tiempo real: Brindar soporte a sistemas de IA físicos, como robots y máquinas autónomas, que requieren la toma de decisiones en milisegundos.

Adopción por parte de la industria: comercio minorista, finanzas y más allá

Las industrias sensibles a los retrasos están liderando el cambio hacia la periferia:

- Comercio minorista y comercio electrónico: La inferencia localizada potencia las recomendaciones personalizadas y la búsqueda multimodal, evitando que el usuario abandone la página debido a la lentitud.

- Finanzas: La detección de fraudes y la aprobación de pagos dependen de cadenas de decisiones rápidas basadas en IA. El procesamiento local de datos ayuda a las empresas a mantener la velocidad sin dejar de cumplir con la normativa.

Construyendo el futuro: IA ámbrica y seguridad

La siguiente fase de la IA implica Agente de IA—sistemas que toman secuencias autónomas de decisiones. Esto requiere un "Red de distribución de IA" que distribuye la inferencia a través de miles de ubicaciones de borde. Este enfoque distribuido no solo aumenta el rendimiento, sino que también simplifica gobernanza de datos para el 50% de las organizaciones de la región Asia-Pacífico que actualmente tienen dificultades con las diversas regulaciones regionales.

A medida que la inferencia se desplaza hacia el borde, seguridad Sigue siendo fundamental. Implementar controles de confianza cero y proteger las canalizaciones de API en cada sitio garantiza que la resiliencia no se logre a costa de la vulnerabilidad. Para las empresas en 2025 y en adelante, la migración al borde ya no es opcional, sino un requisito indispensable para una IA escalable y rentable.

Acceso

Acceso