Nvidia lanza Alpamayo: modelos de IA abiertos que permiten a los vehículos autónomos "pensar como un humano".

El amanecer del razonamiento de IA similar al humano en vehículos autónomos

En el CES 2026, Nvidia lanzó Alpamayo, una revolucionaria familia de modelos de IA de código abierto, herramientas de simulación y conjuntos de datos para entrenar robots y vehículos físicos, diseñados para ayudar a los vehículos autónomos a razonar en situaciones de conducción complejas con una inteligencia humana sin precedentes.

Alpamayo 1: El juego revolucionario de los 10 mil millones de parámetros

En el centro de la innovadora iniciativa de Nvidia se encuentra Alpamayo 1Se trata de un sofisticado modelo de acción-lenguaje visual (VLA) basado en la lógica y la razón, con 10 mil millones de parámetros, que representa un salto cualitativo en la inteligencia de los vehículos autónomos. Este avanzado sistema de IA permite que los vehículos autónomos piensen de forma más parecida a los humanos, lo que les permite resolver casos complejos sin experiencia previa.

El enfoque revolucionario del modelo implica desglosar los problemas en pasos lógicosAnalizando todas las posibilidades y seleccionando el camino más seguro, esta metodología refleja los procesos cognitivos humanos, tomando decisiones en fracciones de segundo basadas en un análisis exhaustivo de la situación.

Procesamiento de la cadena de pensamiento

Algoritmos de razonamiento avanzados que imitan los procesos de toma de decisiones humanas, lo que permite a los vehículos afrontar escenarios sin precedentes mediante un análisis lógico paso a paso.

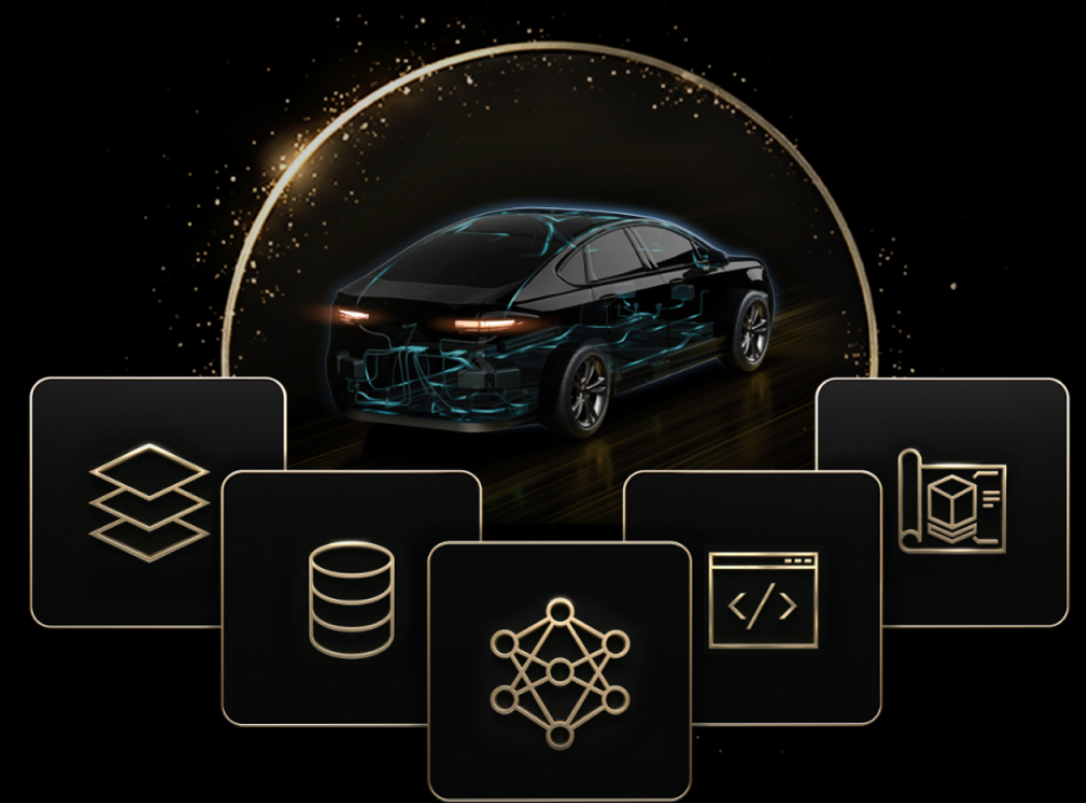

Visión, Lenguaje y Acción (VLA)

Inteligencia artificial multimodal integrada que procesa datos visuales, comprende el contexto mediante modelos de lenguaje y ejecuta acciones físicas precisas en tiempo real.

Arquitectura de código abierto

Disponible en Hugging Face, permite a los desarrolladores de todo el mundo ajustar, optimizar y desarrollar los modelos de IA fundamentales de Nvidia para aplicaciones especializadas.

Aplicaciones en el mundo real y soluciones para casos excepcionales

La verdadera innovación de Alpamayo radica en su capacidad para manejar casos límite complejos que presentan dificultades para los sistemas tradicionales de vehículos autónomos. Consideremos escenarios como sortear un semáforo averiado en una intersección concurrida, responder a vehículos de emergencia o adaptarse a zonas de construcción con patrones de tráfico inusuales.

El enfoque integral del sistema implica múltiples niveles de análisis:

- Procesamiento de la entrada del sensor: Análisis en tiempo real de datos de cámara, lidar y radar.

- Comprensión del contexto: Interpretación de las señales de tráfico, las condiciones de la carretera y el comportamiento de los peatones.

- Modelado predictivo: Anticipación de posibles escenarios y sus resultados

- Explicación de la decisión: Justificación clara de las acciones elegidas y consideraciones alternativas.

La tecnología detrás del razonamiento humano

El avance de Nvidia va más allá de los enfoques tradicionales de aprendizaje automático al incorporar principios de IA explicablesComo explicó Jensen Huang durante su discurso de apertura, Alpamayo no se limita a recibir información de los sensores y activar los controles del vehículo, sino que razona activamente sobre las acciones que pretende llevar a cabo.

El sistema proporciona una toma de decisiones transparente al explicar:

Ecosistema de desarrolladores y posibilidades de integración

La naturaleza de código abierto de Alpamayo 1 crea oportunidades sin precedentes para la innovación en la industria de los vehículos autónomos. Con el código subyacente disponible en Cara de abrazoLos desarrolladores pueden:

Ajustar modelos para tipos de vehículos específicos, regiones geográficas o condiciones de conducción. Esta capacidad de personalización permite a los fabricantes de automóviles adaptar la IA a sus necesidades particulares, manteniendo al mismo tiempo las capacidades de razonamiento fundamentales.

Construir herramientas complementarias Esto incluye sistemas de etiquetado automático que etiquetan automáticamente los datos de vídeo con fines de entrenamiento, y evaluadores sofisticados que valoran si los vehículos autónomos toman decisiones óptimas en diversos escenarios.

Crear sistemas de formación híbridos que combinan datos de conducción del mundo real con escenarios sintéticos generados a través de la plataforma Cosmos de Nvidia, lo que permite un entrenamiento de IA más completo y rentable.

Integración del cosmos: La revolución en la generación de datos sintéticos

La integración de Alpamayo con Cosmos de Nvidia Representa un cambio de paradigma en la metodología de entrenamiento de IA. Cosmos, la marca de modelos generativos del mundo de Nvidia, crea representaciones detalladas de entornos físicos que permiten a los sistemas de IA hacer predicciones y tomar medidas en escenarios simulados.

Esta capacidad de generación de datos sintéticos aborda uno de los desafíos más importantes en el desarrollo de vehículos autónomos: la necesidad de grandes cantidades de datos de entrenamiento diversos que cubran escenarios de conducción poco frecuentes pero críticos.

Impacto en la industria e implicaciones futuras

El lanzamiento de Alpamayo marca un cambio fundamental en la forma en que la industria automotriz aborda el desarrollo de vehículos autónomos. Al democratizar el acceso a capacidades avanzadas de razonamiento de IA, Nvidia está acelerando la innovación en todo el ecosistema.

Las implicaciones van más allá de la inteligencia de cada vehículo individual y abarcan lo siguiente:

- Gestión de flotas: Toma de decisiones coordinada entre múltiples vehículos autónomos

- Integración de infraestructura: Sistemas de ciudades inteligentes que se comunican con vehículos impulsados por IA

- Normas de seguridad: Nuevos marcos regulatorios basados en decisiones de IA explicables

- Modelos de seguros: Transparencia en la evaluación de riesgos basada en el razonamiento de la IA

A medida que la tecnología madure, podemos esperar ver colaboración entre humanos e IA convertirse en el estándar en la operación de vehículos autónomos, donde los sistemas de IA no solo toman decisiones, sino que también comunican su razonamiento a los supervisores humanos y a los pasajeros.

El futuro de los vehículos autónomos ya está aquí, impulsado por una IA que piensa, razona y explica sus decisiones como nunca antes.

Acceso

Acceso