const { OpenAI } = require('openai');

const api = new OpenAI({

baseURL: 'https://api.ai.cc/v1',

apiKey: '',

});

const main = async () => {

const result = await api.chat.completions.create({

model: 'openai/gpt-5-2',

messages: [

{

role: 'system',

content: 'You are an AI assistant who knows everything.',

},

{

role: 'user',

content: 'Tell me, why is the sky blue?'

}

],

});

const message = result.choices[0].message.content;

console.log(`Assistant: ${message}`);

};

main();

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.ai.cc/v1",

api_key="",

)

response = client.chat.completions.create(

model="openai/gpt-5-2",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices[0].message.content

print(f"Assistant: {message}")

GPT-5.2

GPT-5.2 est la série de modèles la plus avancée d'OpenAI à ce jour, conçue spécifiquement pour les tâches de traitement des connaissances à enjeux élevés.

Présentation de l'API GPT-5.2

GPT-5.2 représente la dernière avancée d'OpenAI en matière de modèles de langage de grande taille, conçu pour des analyses plus poussées et une gestion supérieure des tâches complexes du monde réel. Il excelle dans l'assistance à la programmation, la synthèse de longs documents, l'analyse précise des fichiers téléchargés, la décomposition détaillée des calculs mathématiques et logiques, ainsi que dans l'aide structurée à la planification et à la prise de décision, offrant une clarté accrue et des informations exploitables.

Ce modèle s'appuie sur les itérations précédentes avec des chaînes de raisonnement affinées et une production plus soignée, ce qui le rend idéal pour les flux de travail professionnels exigeant fiabilité et profondeur dans les domaines techniques et cognitifs.

Spécifications techniques

- Architecture: LLM génératif basé sur un transformateur

- Longueur du contexte : Jusqu'à 64 000 jetons (contexte étendu)

- Capacités : Discussion, raisonnement, intégration multimodale, génération de code, utilisation d'outils

- Données d'entraînement : Corpus diversifiés à l'échelle du Web, littérature scientifique, dialogues et ensembles de données de code avec alignement par rétroaction humaine (RLHF)

- Améliorations de l'inférence : Mécanismes d'attention adaptatifs et noyaux de transformateurs optimisés pour une latence et une consommation d'énergie réduites

Indicateurs de performance

- Raisonnement logique : Stabilité et précision supérieures sur les tâches de raisonnement à plusieurs étapes

- Génération de code : Haute correction fonctionnelle dans plusieurs langages de programmation

- Compréhension multilingue : Prend en charge plus de 40 langues avec une forte mémorisation contextuelle

- Tâches en contexte étendu : Garantit la cohérence et l'intégrité factuelle des données d'entrée dépassant 50 000 jetons.

- Apprentissage par l'expérience : Amélioration de 30 % de la généralisation par rapport à GPT-5.0

Améliorations de la qualité

- Maintient un raisonnement cohérent dans des contextes comportant des millions de jetons, sans dérive.

- Les analyses étape par étape incluent désormais des chemins logiques vérifiables pour les mathématiques, le code et les décisions.

- La compréhension améliorée des fichiers fournit des résumés contextuels et des questions-réponses avec des citations précises.

- Un ton professionnel équilibré, une structure concrète et des résultats minimisant les formulations vagues ou trop verbeuses.

Tarification de l'API

- Saisir: 2,275 $ / 1 M

- Sortir: 18,2 $ / 1 M

Nouvelles fonctionnalités et améliorations techniques

- Mode de raisonnement adaptatif : Un processus cognitif silencieux en plusieurs étapes avant la sortie réduit les erreurs et les contradictions.

- Fenêtre de contexte étendue (64 000 jetons) : Permet le traitement de documents longs, les dialogues soutenus et le raisonnement basé sur les données.

- Compatibilité multimodale : Intégration transparente avec les modalités visuelles et vocales pour des flux d'entrée/sortie plus riches

- Couches de sortie sécurisées : La version améliorée de RLHF garantit des garde-fous plus robustes contre les contenus toxiques ou biaisés

- Optimisations de l'efficacité : Inférence 20 % plus rapide et consommation d'énergie réduite de 15 % par rapport aux versions précédentes

Impact pratique

Ces innovations techniques permettent à GPT-5.2 de fournir une assistance en IA de haute précision aux entreprises, aux développeurs, aux enseignants et aux chercheurs. Idéal pour les applications nécessitant une compréhension fiable du contexte étendu, les outils de codage, la communication multilingue et les flux de travail de création de contenu.

Exemple de code

Comparaison avec d'autres modèles

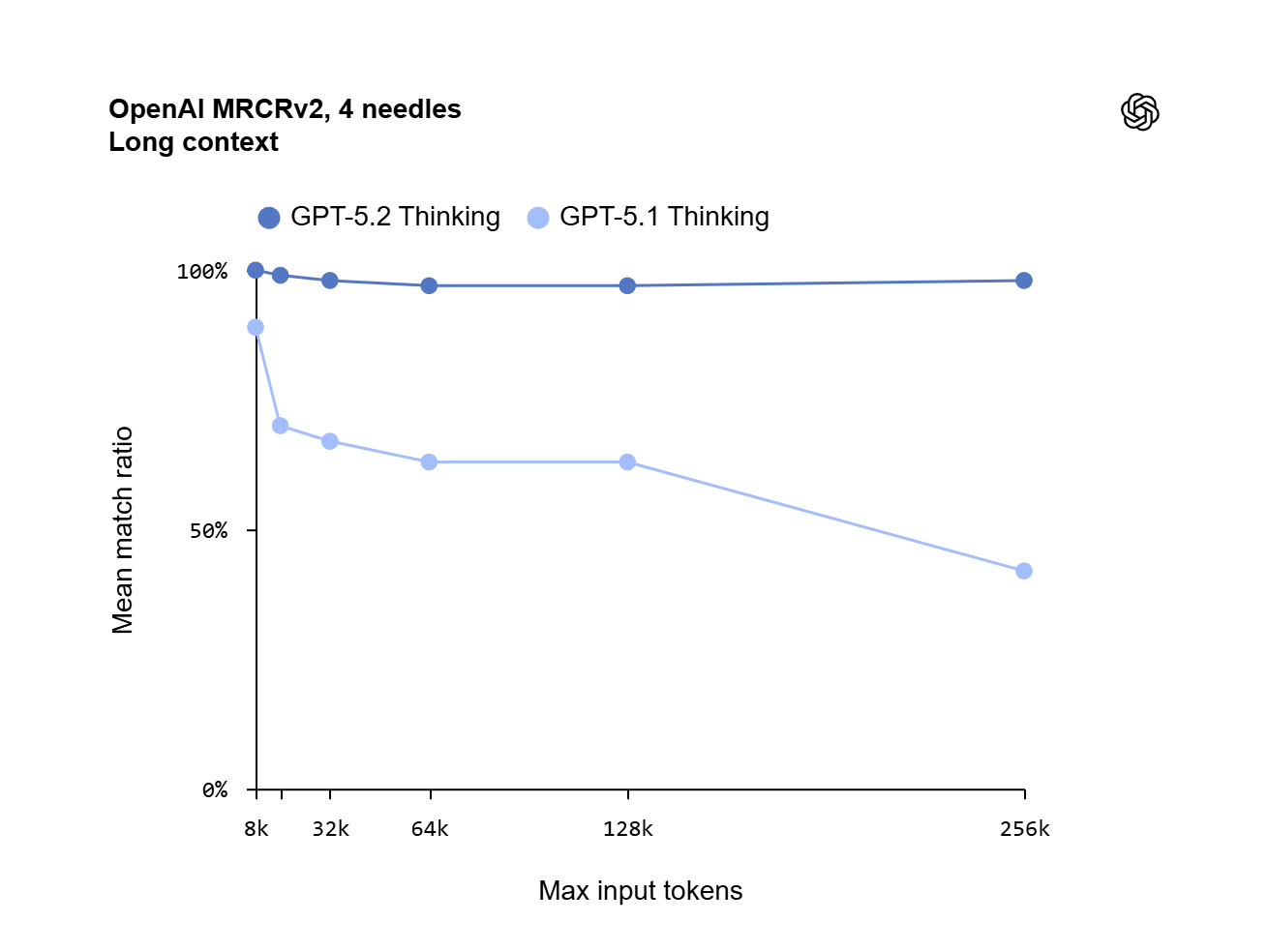

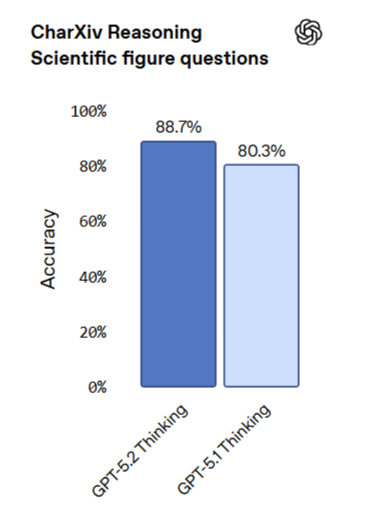

par rapport à GPT-5.1GPT-5.2 offre des gains considérables en termes de précision sur des contextes longs (77 % contre 29,6 % à 256 000 caractères), de codage (55,6 % contre 50,8 % sur SWE-Bench Pro) et de fiabilité des outils (98,7 % contre 95,6 % sur Tau2 Telecom). Les hallucinations sont 30 % moins fréquentes et la qualité des résultats est systématiquement plus professionnelle.

par rapport à GPT-5: 20 % plus rapide avec une consommation d'énergie réduite ; meilleure précision factuelle et moins d'hallucinations dans les contextes étendus. Gestion supérieure des dialogues complexes à plusieurs tours et des tâches de raisonnement abstrait.

Terrain de jeu de l'IA

Se connecter

Se connecter