const { OpenAI } = require('openai');

const api = new OpenAI({

baseURL: 'https://api.ai.cc/v1',

apiKey: '',

});

const main = async () => {

const result = await api.chat.completions.create({

model: 'deepseek/deepseek-non-reasoner-v3.1-terminus',

messages: [

{

role: 'system',

content: 'You are an AI assistant who knows everything.',

},

{

role: 'user',

content: 'Tell me, why is the sky blue?'

}

],

});

const message = result.choices[0].message.content;

console.log(`Assistant: ${message}`);

};

main();

import os

from openai import OpenAI

client = OpenAI(

base_url="https://api.ai.cc/v1",

api_key="",

)

response = client.chat.completions.create(

model="deepseek/deepseek-non-reasoner-v3.1-terminus",

messages=[

{

"role": "system",

"content": "You are an AI assistant who knows everything.",

},

{

"role": "user",

"content": "Tell me, why is the sky blue?"

},

],

)

message = response.choices[0].message.content

print(f"Assistant: {message}")

Detalhes do produto

✨ DeepSeek V3.1 Chat é um modelo híbrido especializado de IA conversacional focado em respostas rápidas e diretas sem recorrer a raciocínios complexos. Baseada na arquitetura DeepSeek V3.1, esta variante omite o modo de pensar Prioriza saídas de baixa latência, mantendo ao mesmo tempo fortes capacidades multimodais. É otimizado para aplicações que exigem interações eficientes e diretas em chat, geração de código e fluxos de trabalho de agentes, sendo ideal para desenvolvedores e empresas que valorizam tempos de resposta rápidos e execução de tarefas simplificada.

Especificações técnicas

- Janela de contexto até 128 mil tokens para dar suporte a conversas prolongadas com múltiplas interações e sessões de programação.

- Limite de tokens de saída até 8.000 tokens Otimizado para respostas concisas e coerentes.

- Arquitetura de transformador híbrido com Camadas de Mistura de Especialistas (MoE) para alocação computacional eficiente.

- Suporta chamadas de ferramentas estruturadas, funcionalidade de agente de código e agentes de pesquisa para aumentar a flexibilidade das tarefas.

- Treinamento estendido em conjuntos de dados de contexto extenso usando microescalonamento FP8 para eficiência de inferência.

- Suporte multilíngue em todo o país Mais de 100 idiomas com alta precisão contextual.

Principais características

🚀 O DeepSeek V3.1 Chat opera exclusivamente em um modo não-pensante que entrega respostas rápidas e diretas sem recorrer a raciocínios de múltiplas etapas. Essa configuração permite uma capacidade extremamente... interações de baixa latência Ideal para consultas simples e execução de tarefas, o modelo mantém recursos aprimorados de chamada de ferramentas e agentes, permitindo uma integração perfeita com agentes de código e agentes de busca para fluxos de trabalho versáteis. Construído sobre uma arquitetura de transformador MoE otimizada, ele alcança uso eficiente de recursos, ao mesmo tempo que suporta chamadas de função estruturadas para invocação precisa de ferramentas. Embora não realize raciocínio complexo, é ideal para bate-papo multimodal, geração rápida de código e fluxos de trabalho com agentes simplificados que exigem resultados rápidos e confiáveis.

Desempenho e capacidades

- ⚡ Tempos de resposta rápidos Com utilização otimizada de ferramentas e sobrecarga computacional mínima.

- Alta precisão na geração direta de código e na execução de tarefas com baixas taxas de erro.

- Processamento eficaz de entradas multimodais, incluindo texto e imagens, com foco em tarefas que não envolvem raciocínio.

- Escalável em ambientes de engenharia de software, assistência à pesquisa e aplicações com agentes.

Casos de uso

- Assistência rápida em engenharia de software, incluindo síntese e depuração de código.

- Chatbots multimodais focados na compreensão de imagens e textos com respostas rápidas.

- Pesquisa rotineira e análise de documentos com requisitos de contexto moderados.

- Diálogo eficiente com múltiplas interações, adequado para ferramentas educacionais básicas orientadas a tarefas.

- Processos de inteligência de negócios com ênfase na interpretação visual rápida de dados.

- Aplicações com agentes que requerem chamadas de ferramentas inteligentes sem sobrecarga de raciocínio complexo.

Preços da API

• 1 milhão de tokens de entrada: $ 0,294

• 1 milhão de tokens de saída: $ 0,441

Exemplo de código

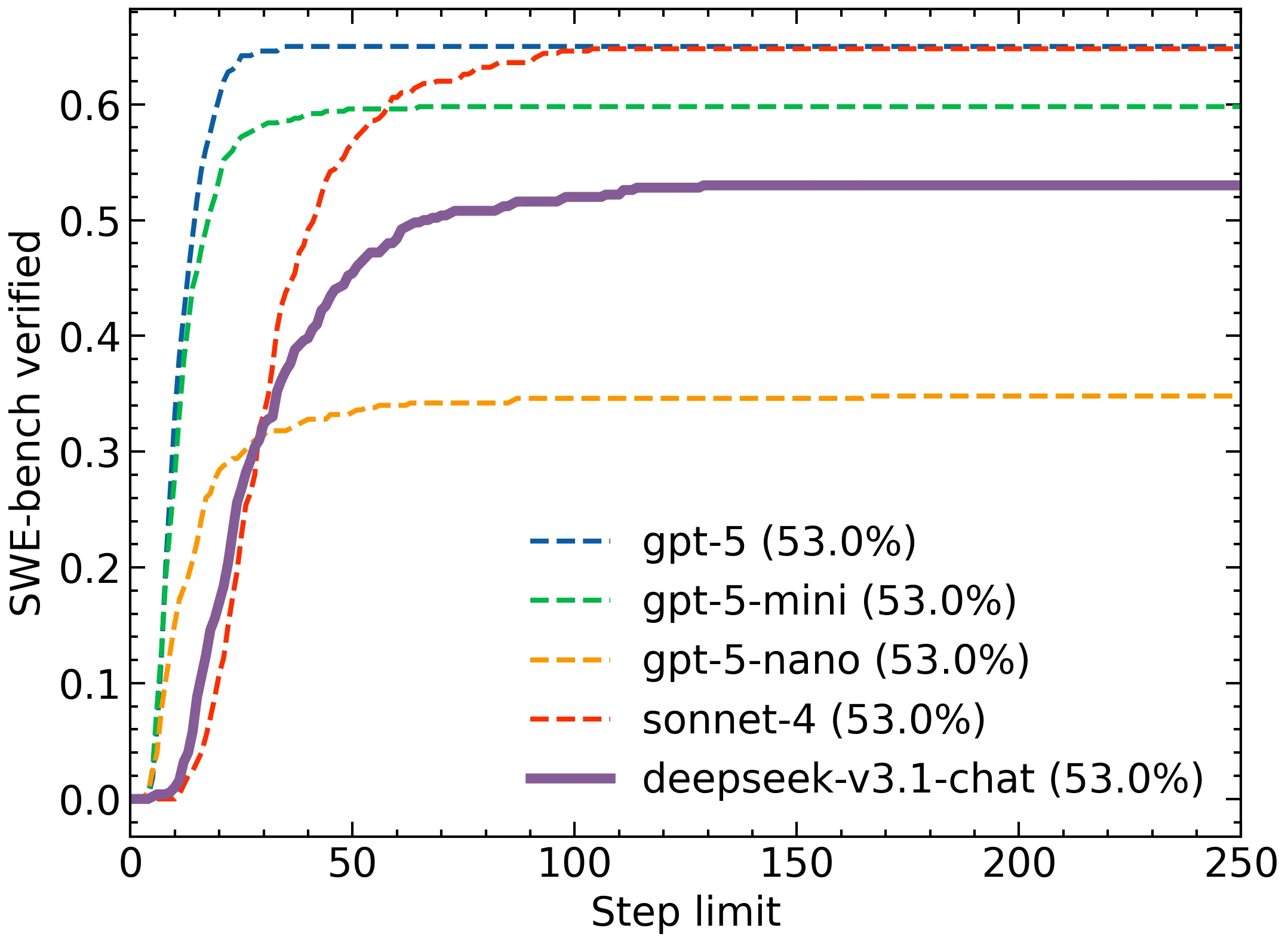

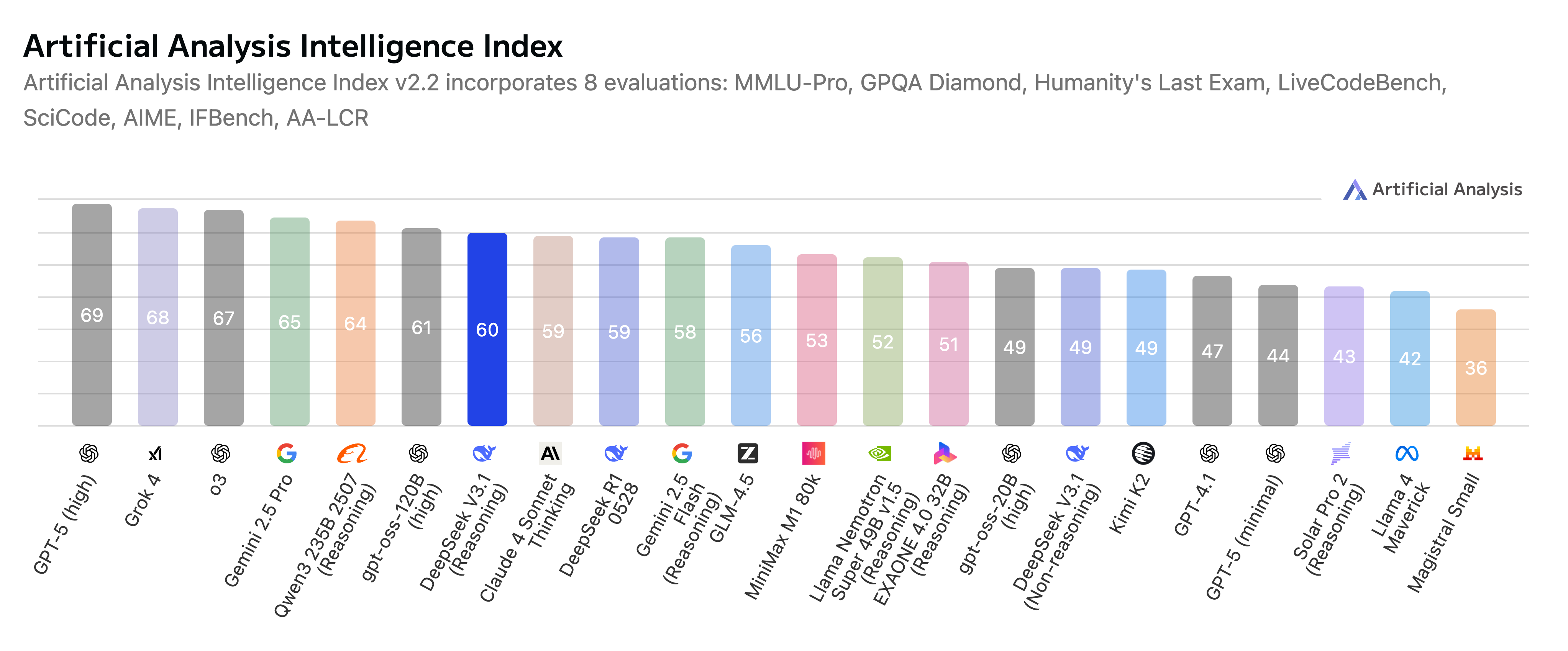

Comparação com outros modelos

O DeepSeek V3.1 Chat oferece um equilíbrio ideal entre inferência de alta velocidade, forte integração multimodal e custo-benefício para casos de uso onde o raciocínio profundo não é necessário. Ele foi projetado para desenvolvedores e empresas que priorizam velocidade e execução simplificada de tarefas em fluxos de trabalho de IA conversacional multimodal e agentes.

💡 vs GPT-5: Embora o GPT-5 possua uma janela de contexto muito maior, com 400 mil tokens, e inclua modalidades emergentes de áudio/vídeo, além de recursos de texto e imagem, o DeepSeek V3.1 Chat se destaca pela integração mais profunda da manipulação do contexto visual, modularidade dinâmica especializada para computação eficiente e ferramentas avançadas de adaptação de domínio. O DeepSeek oferece uma abordagem robusta de modelo de pesos abertos com vantagens de custo e se especializa em raciocínio complexo de imagens e fusão multimodal, enquanto o GPT-5 lidera em escala de contexto e abrangência multimodal, com integração ao ecossistema empresarial.

💡 vs DeepSeek V3: A nova versão melhora a velocidade de inferência em aproximadamente 30%, expande a janela de contexto de 128K para uma escala mais flexível otimizada para tarefas de bate-papo e aprimora significativamente a precisão do alinhamento multimodal. Essas melhorias permitem um raciocínio mais eficiente, especialmente em linguagens com poucos recursos e cenários visuais complexos, tornando-a mais adequada para IA conversacional avançada e compreensão de código em larga escala.

💡 vs OpenAI GPT-4.1: Em comparação com a arquitetura otimizada para código e centrada em texto do GPT-4.1, o DeepSeek V3.1 equilibra entradas multimodais em larga escala com um sofisticado regime de treinamento de Mistura de Especialistas. Esse equilíbrio resulta em coerência visual-textual superior e adaptação mais rápida em diversas tarefas multimodais, tornando o DeepSeek especialmente adequado para fluxos de trabalho que exigem integração perfeita de texto e imagens com raciocínio avançado.

Perguntas frequentes (FAQ)

Qual é o objetivo principal do DeepSeek V3.1 Chat?

O DeepSeek V3.1 Chat foi projetado para IA conversacional rápida e direta, priorizando respostas de baixa latência para consultas simples e execução de tarefas, em vez de raciocínio complexo e de várias etapas.

Como o DeepSeek V3.1 Chat consegue tempos de resposta rápidos?

O modelo opera exclusivamente em um modo "não-pensante", omitindo o raciocínio em várias etapas para fornecer resultados imediatos. Sua arquitetura de transformador Mixture of Experts (MoE) otimizada também contribui para o uso eficiente de recursos e velocidade.

Quais são as funcionalidades multimodais oferecidas pelo DeepSeek V3.1 Chat?

Mantém fortes capacidades multimodais, permitindo interações eficientes em diversas modalidades. texto e imagens Para tarefas como bate-papo multimodal e geração rápida de código, mesmo sem funcionalidades de raciocínio complexo.

Em quais cenários o DeepSeek V3.1 Chat é mais eficaz?

É otimizado para aplicações que exigem interações eficientes e diretas Ideal para chat, geração de código e fluxos de trabalho de agentes, sendo perfeito para desenvolvedores e empresas que valorizam tempos de resposta rápidos e execução de tarefas simplificada.

Playground de IA

Conecte-se

Conecte-se