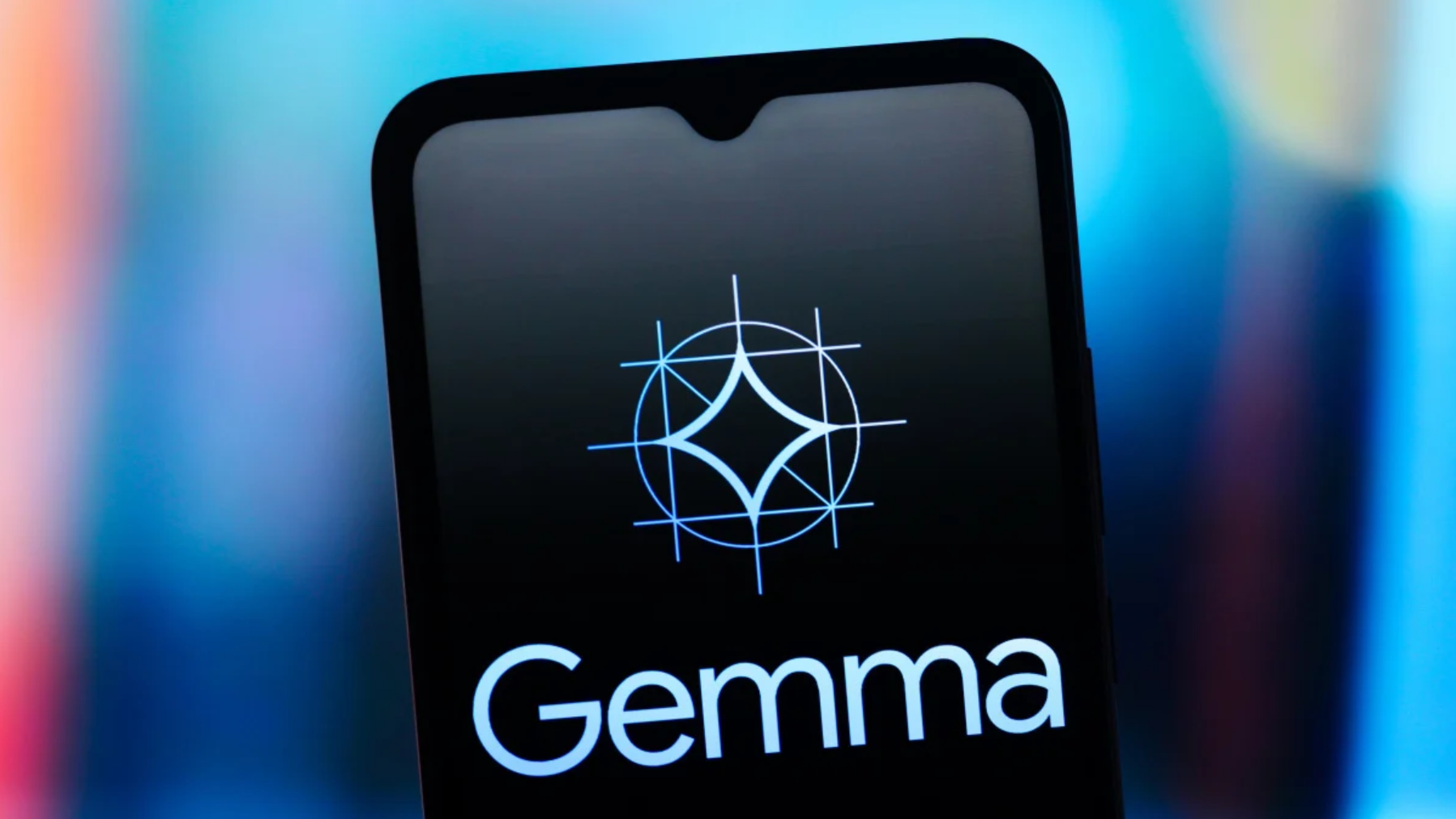

Gemma 4 教程:2026 年集成 Google 最强大的开源多模态 AI 模型 + API 集成的完整指南

Gemma 4:Google最强大工具的完整指南 开源 多模态人工智能

Google DeepMind刚刚发布了 杰玛 4 ——迄今为止功能最强大的真正开源多模式模型系列。于2026年4月2日在完全开放的环境下发布。 Apache 2.0 许可证Gemma 4 将前沿技术(基于与 Gemini 3 相同的研究成果)带到了笔记本电脑、手机、树莓派和高端 GPU 上。本实战教程涵盖所有内容:模型变体、基准测试、实际代码和 API 集成。

模型变体:适用于所有部署场景

Gemma 4 系列包含四种优化尺寸。所有型号均支持多模态输入,并擅长智能体工作流程、原生函数调用、结构化 JSON 输出和长上下文推理。

| 模型变体 | 参数 | 目标硬件 | 上下文窗口 | 主要优势 |

|---|---|---|---|---|

| Gemma 4 E2B | 约20亿 | 移动/边缘设备 | 128K | 超低延迟,设备端 |

| 宝石 4 E4B | 约40亿 | 手机/树莓派 | 128K | 多模态 + 原生音频 |

| Gemma 4 26B A4B | 26B(教育部) | 工作站/GPU | 256K | 速度与质量兼顾 |

| Gemma 4 31B | 31B | 高端服务器 | 256K | 最大推理能力 |

// 多模态人工智能架构:Gemma 4 可无缝处理文本、图像、音频和视频输入

Gemma 4 的突出之处:基准测试

(31B 型号)

钻石

长椅

多种语言

- 多模态原生: 在一个模型中理解图像、音频片段、视频和文本。

- 代理和工具使用: 内置函数调用和工具集成——非常适合自主代理。

- 设备端性能: 在消费级硬件上离线运行,延迟接近于零。

- 详细背景: 对于大型文档或整个代码库,最多可使用 256K 个令牌。

- 商业自由: Apache 2.0 许可证取消了之前的所有限制——可以部署到任何地方。

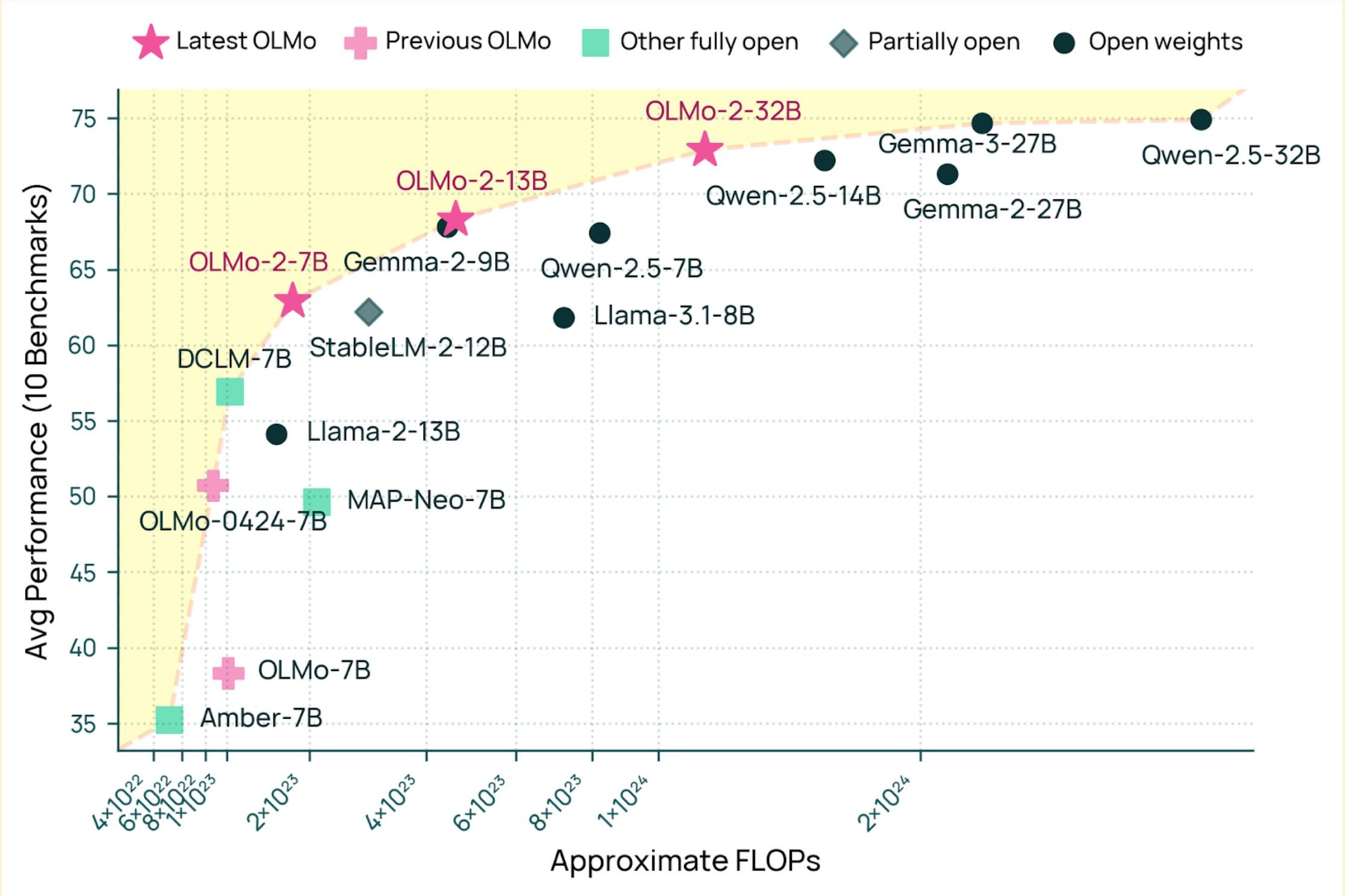

// Gemma 4 与其他开源模型的性能对比——浮点运算次数与基准平均值对比

API集成实战教程(Python)

你有两种主要发展路径: 托管的 Gemini API (最简单,推荐用于原型制作) 本地部署 通过 Hugging Face / Ollama 完全保护您的隐私。

选项 1 — Gemini API 快速入门

from google import genai # 在 ai.google.dev 获取您的免费 API 密钥 client = genai.Client(api_key="YOUR_GEMINI_API_KEY") response = client.models.generate_content( model="gemma-4-31b-it", # 或 gemma-4-26b-a4b-it 等 contents=[ "分析此图像并详细解释图表。", # 您也可以在此处传递图像字节或 URL ] ) print(response.text)

多模态示例——图像+文本

response = client.models.generate_content( model="gemma-4-e4b-it", contents=["这张照片里发生了什么?", genai.types.Part.from_image( genai.types.Image.from_bytes(image_bytes) )] )

方案二——通过 Hugging Face 进行本地部署

from transformers import AutoModelForCausalLM, AutoProcessor import torch model_id = "google/gemma-4-31B-it" # 或更小的变体 processor = AutoProcessor.from_pretrained(model_id) model = AutoModelForCausalLM.from_pretrained( model_id, torch_dtype=torch.bfloat16, device_map="auto") # 多模态提示示例 messages = [ {"role": "user", "content": [ {"type": "image", "image": "https://example.com/chart.png"}, {"type": "text", "text": "描述此数据可视化中的趋势。"} ]} ] inputs = processor.apply_chat_template( messages, add_generation_prompt=True, tokenize=True, return_tensors="pt").to(model.device) outputs = model.generate(**inputs, max_new_tokens=512) print(processor.decode(outputs[0]))

// Google AI Studio — 使用 Gemma 4 进行原型设计的最快方式

常见用例和实际示例

原生工具,用于网页抓取、数据分析或复杂的多步骤自动化工作流程。

图像分析+语音+文本整合于一体——无需拼接。

直接在移动设备或物联网硬件上运行强大的 2B–4B 模型,完全离线。

256K 上下文窗口可以处理海量知识库、整个代码库和法律文件。

常问问题

是的——采用完整的 Apache 2.0 许可证,允许开源权重和商业用途,没有任何限制。

当然。Edge 版本(2B/4B)可在手机上运行;更大的版本则在单个 GPU 上运行,并采用量化技术(4 位/8 位)。

Gemma 4 具备类似的前沿功能,但更加开放,并专注于设备端优化。

集成 Gemma 4 和 100 多个顶级模型 — 一个 SDK

管理多个模型、API密钥、速率限制和部署非常耗时。www.ai.cc 提供一键访问 Gemma 4、Claude、GPT、Grok、Veo 以及数十种其他模型,只需一个简单易用的 SDK 即可完成。

登录

登录