Tutoriel Gemma 4 : Guide complet pour l’intégration du modèle d’IA multimodal open source le plus puissant de Google + intégration API en 2026

Gemma 4 : Guide complet des outils les plus puissants de Google Source libre IA multimodale

Google DeepMind vient de publier Gemma 4 — la famille de modèles multimodaux open source la plus performante à ce jour. Lancée le 2 avril 2026 sous une licence entièrement permissive. Licence Apache 2.0Gemma 4 étend ses fonctionnalités de pointe (issues des mêmes recherches que Gemini 3) aux ordinateurs portables, téléphones, Raspberry Pi et GPU haut de gamme. Ce tutoriel pratique aborde tous les aspects : variantes de modèles, benchmarks, code source et intégration API.

Variantes de modèle : Chaque scénario de déploiement

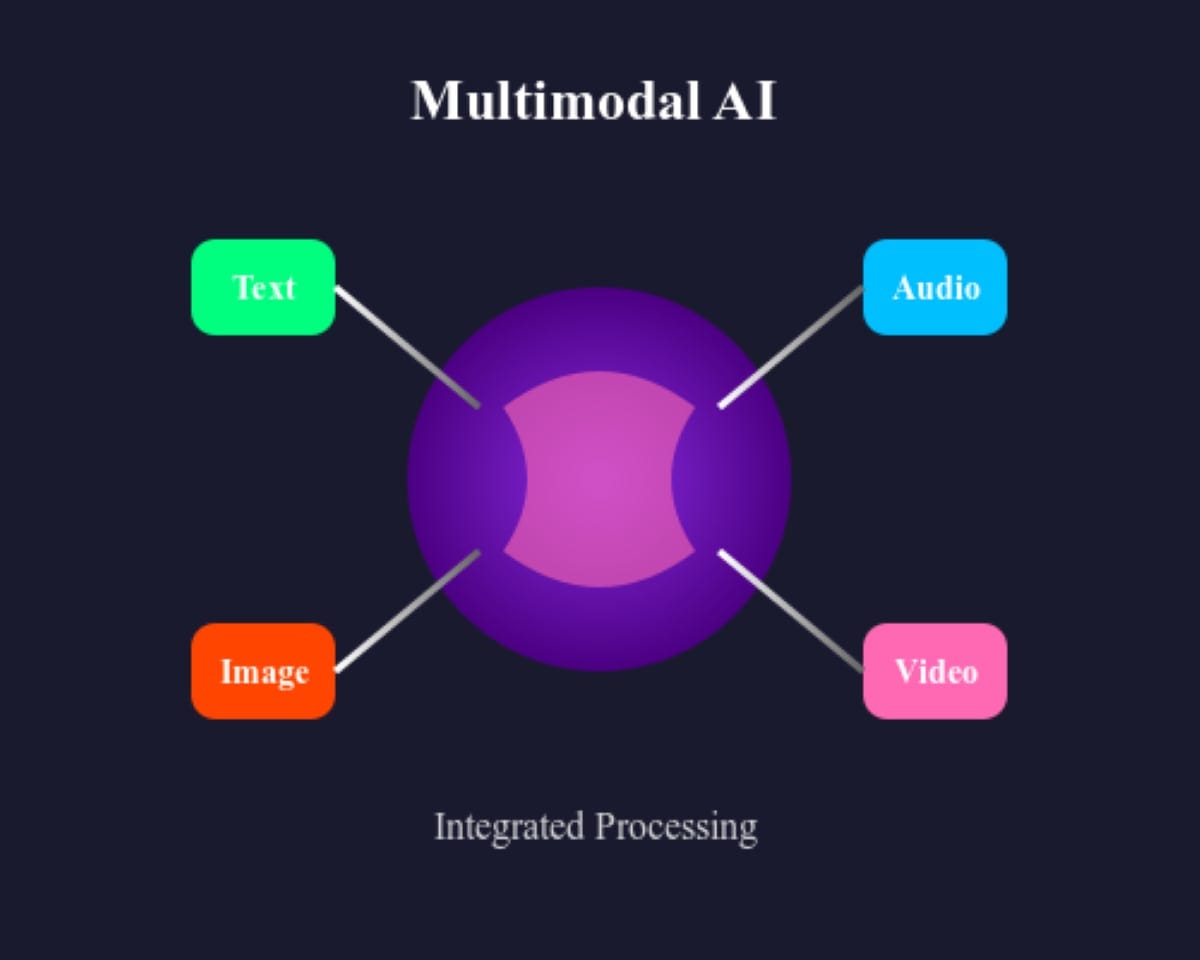

La famille Gemma 4 comprend quatre tailles optimisées. Tous les modèles prennent en charge les entrées multimodales et excellent dans les flux de travail multi-agents, les appels de fonctions natives, la sortie JSON structurée et le raisonnement sur un contexte long.

| Variante du modèle | Paramètres | Matériel cible | Fenêtre contextuelle | Points forts |

|---|---|---|---|---|

| Gemma 4 E2B | ~2B | Appareils mobiles / périphériques | 128K | Latence ultra-faible, sur l'appareil |

| Gemme 4 E4B | ~4B | Téléphones / Raspberry Pi | 128K | Multimodal + audio natif |

| Gemma 4 26B A4B | 26B (MoE) | Stations de travail / GPU | 256K | Vitesse et qualité équilibrées |

| Gemma 4 31B | 31B | Serveurs haut de gamme | 256K | Puissance de raisonnement maximale |

// Architecture d'IA multimodale : Gemma 4 traite les entrées texte, images, audio et vidéo de manière transparente

Pourquoi Gemma 4 se distingue : Points de référence

(Modèle 31B)

Diamant

Banc

Multilingue

- Multimodal-natif : Comprendre les images, les extraits audio et la vidéo en même temps que le texte dans un seul modèle.

- Utilisation des agents et des outils : Appels de fonctions intégrés et intégration d'outils — idéal pour les agents autonomes.

- Performances sur l'appareil : Fonctionne hors ligne avec une latence quasi nulle sur du matériel grand public.

- Contexte détaillé : Jusqu'à 256 000 jetons pour des documents volumineux ou des bases de code entières.

- Liberté commerciale : La licence Apache 2.0 supprime toutes les restrictions précédentes — déployez-la où vous voulez.

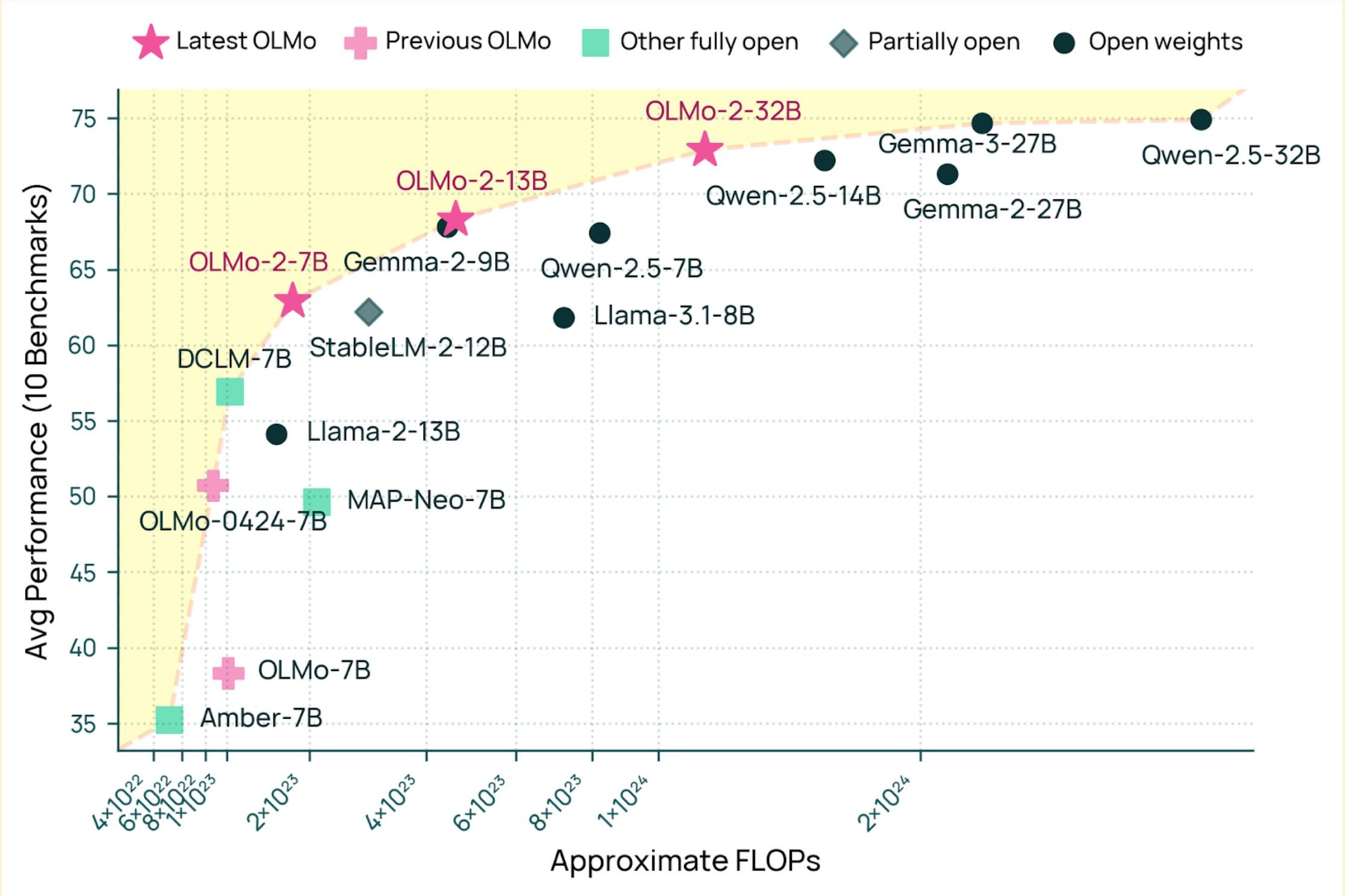

// Performances de Gemma 4 comparées à celles d'autres modèles ouverts — FLOPs par rapport à la moyenne des benchmarks

Tutoriel pratique d'intégration d'API (Python)

Vous avez deux voies principales : API Gemini hébergée (le plus simple, recommandé pour le prototypage) ou déploiement local via Hugging Face / Ollama pour une confidentialité totale.

Option 1 — Démarrage rapide de l'API Gemini

from google import genai # Obtenez votre clé API gratuite sur ai.google.dev client = genai.Client(api_key="VOTRE_CLÉ_API_GEMINI") response = client.models.generate_content( model="gemma-4-31b-it", # ou gemma-4-26b-a4b-it, etc. contents=[ "Analysez cette image et expliquez le graphique en détail.", # Vous pouvez également transmettre des octets d'image ou des URL ici ] ) print(response.text)

Exemple multimodal — Image + Texte

réponse = client.models.generate_content( model="gemma-4-e4b-it", contents=["Que se passe-t-il sur cette photo ?", genai.types.Part.from_image( genai.types.Image.from_bytes(image_bytes) )] )

Option 2 — Déploiement local via Hugging Face

from transformers import AutoModelForCausalLM, AutoProcessor import torch model_id = "google/gemma-4-31B-it" # ou des variantes plus petites processor = AutoProcessor.from_pretrained(model_id) model = AutoModelForCausalLM.from_pretrained( model_id, torch_dtype=torch.bfloat16, device_map="auto" ) # Exemple d'invite multimodale messages = [ {"role": "user", "content": [ {"type": "image", "image": "https://example.com/chart.png"}, {"type": "text", "text": "Décrivez les tendances de cette visualisation de données."} ]} ] inputs = processor.apply_chat_template( messages, add_generation_prompt=True, tokenize=True, return_tensors="pt" ).to(model.device) outputs = model.generate(**inputs, max_new_tokens=512) print(processor.decode(outputs[0]))

// Google AI Studio — le moyen le plus rapide de prototyper avec Gemma 4

Cas d'utilisation courants et exemples concrets

Outil natif nécessitant l'extraction de données Web, l'analyse de données ou des flux de travail d'automatisation complexes en plusieurs étapes.

Analyse d'images + voix + texte dans un modèle unifié — aucun assemblage requis.

Exécutez des modèles 2B–4B puissants directement sur des appareils mobiles ou du matériel IoT, entièrement hors ligne.

La fenêtre de contexte de 256 Ko gère des bases de connaissances massives, des bases de code complètes et des documents juridiques.

FAQ

Oui — licence Apache 2.0 complète avec poids libres et utilisation commerciale pleinement autorisée. Aucune restriction.

Absolument. Les variantes Edge (2B/4B) fonctionnent sur les téléphones ; les plus grandes sur un seul GPU avec quantification (4 bits/8 bits).

Gemma 4 offre des capacités de pointe similaires, mais avec une ouverture totale et une optimisation axée sur l'appareil.

Intégrez Gemma 4 + plus de 100 mannequins de renom — Un seul SDK

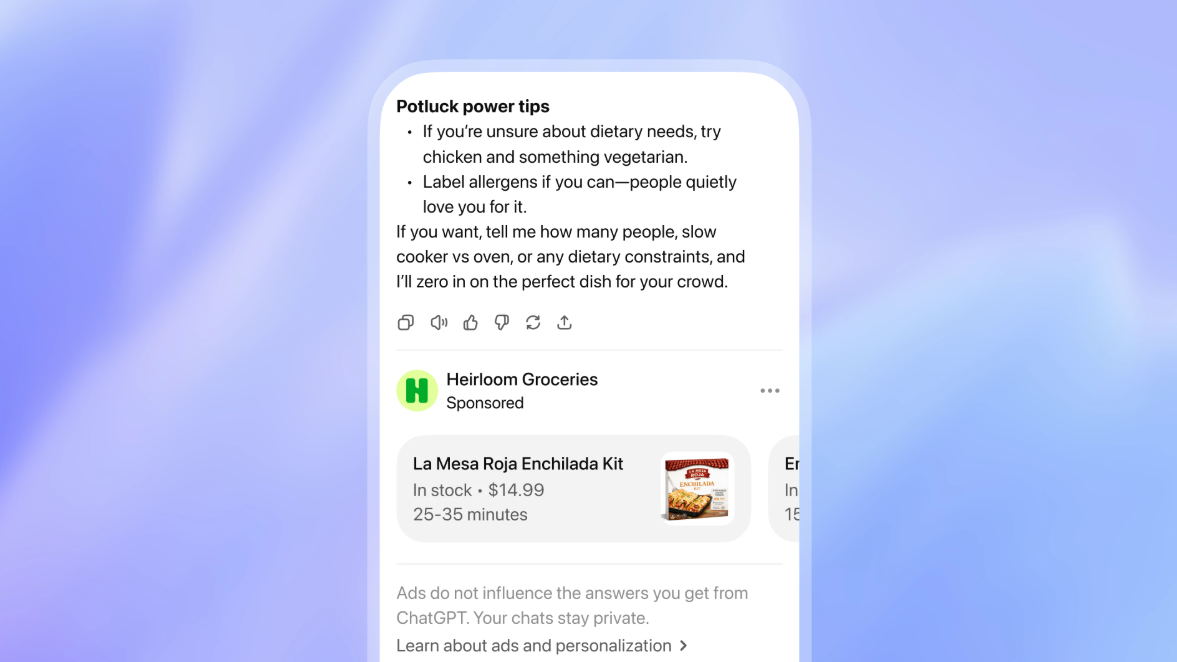

La gestion de plusieurs modèles, clés API, limites de débit et déploiements est chronophage. www.ai.cc vous offre un accès en un clic à Gemma 4, Claude, GPT, Grok, Veo et des dizaines d'autres modèles grâce à un SDK unique et simple.

Se connecter

Se connecter