Учебное пособие по Gemma 4: Полное руководство по интеграции самой мощной модели многомодального ИИ с открытым исходным кодом от Google + интеграция API в 2026 году.

Джемма 4: Полное руководство по самым влиятельным сотрудникам Google Открытый исходный код Мультимодальный ИИ

Компания Google DeepMind только что выпустила Джемма 4 — Самое функциональное семейство многомодальных моделей с действительно открытым исходным кодом на сегодняшний день. Запущено 2 апреля 2026 года на полностью разрешительной основе. Лицензия Apache 2.0Gemma 4 открывает возможности передового уровня (созданные на основе тех же исследований, что и Gemini 3) для ноутбуков, телефонов, Raspberry Pi и высокопроизводительных графических процессоров. В этом практическом руководстве рассматривается все: варианты моделей, тесты производительности, реальный код и интеграция API.

Варианты моделей: все сценарии развертывания

Семейство Gemma 4 включает четыре оптимизированных размера. Все модели поддерживают многомодальные входные данные и превосходно справляются с агентными рабочими процессами, вызовом собственных функций, выводом структурированного JSON и рассуждениями в длительном контексте.

| Вариант модели | Параметры | Целевое оборудование | Контекстное окно | Ключевые преимущества |

|---|---|---|---|---|

| Джемма 4 E2B | ~2B | Мобильные/граничные устройства | 128K | Сверхнизкая задержка, на самом устройстве |

| Gem 4 E4B | ~4B | Телефоны / Raspberry Pi | 128K | Мультимодальный + аудио-нативное |

| Джемма 4 26B A4B | 26B (МЭ) | Рабочие станции / Графические процессоры | 256K | Сбалансированная скорость + качество |

| Джемма 4 31Б | 31Б | Высокопроизводительные серверы | 256K | Максимальная способность к рассуждению |

// Многомодальная архитектура ИИ: Gemma 4 бесперебойно обрабатывает текст, изображения, аудио и видеоданные.

Почему Gemma 4 выделяется среди конкурентов: результаты тестов

(Модель 31B)

Бриллиант

Лавка

Многоязычный

- Multimodal-native: Обрабатывайте изображения, аудиозаписи и видео вместе с текстом в рамках одной модели.

- Применение агентов и инструментов: Встроенная функция вызова функций и интеграция инструментов — идеально подходит для автономных агентов.

- Производительность устройства: Работает в автономном режиме с минимальной задержкой на потребительском оборудовании.

- Подробный контекст: До 256 000 токенов за большие документы или целые кодовые базы.

- Коммерческая свобода: Лицензия Apache 2.0 снимает все предыдущие ограничения — развертывайте приложения где угодно.

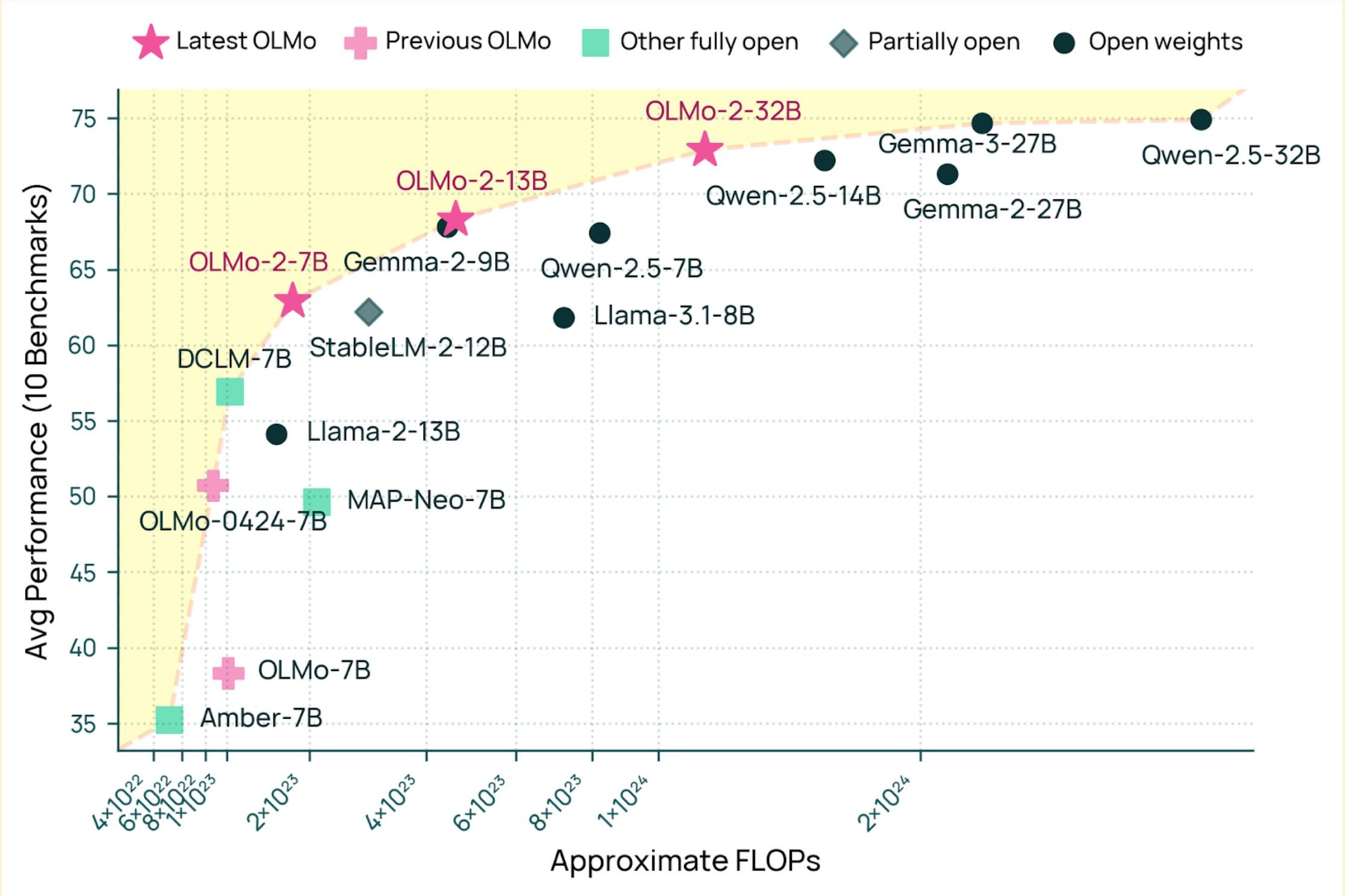

// Производительность Gemma 4 по сравнению с другими открытыми моделями — количество операций с плавающей запятой (FLOPs) по сравнению со средним показателем по бенчмарку

Практическое руководство по интеграции API (Python)

У вас есть два основных пути: размещенный API Gemini (самый простой вариант, рекомендуется для прототипирования) или локальное развертывание Информация предоставлена сайтами Hugging Face / Ollama для обеспечения полной конфиденциальности.

Вариант 1 — Быстрый старт с Gemini API

from google import genai # Получите свой бесплатный API-ключ на ai.google.dev client = genai.Client(api_key="YOUR_GEMINI_API_KEY") response = client.models.generate_content( model="gemma-4-31b-it", # или gemma-4-26b-a4b-it и т. д. contents=[ "Проанализируйте это изображение и подробно объясните диаграмму."", # Здесь также можно передавать байты изображения или URL-адреса ] ) print(response.text)

Пример мультимодального взаимодействия — изображение + текст

response = client.models.generate_content( model="gemma-4-e4b-it", contents=["Что происходит на этой фотографии?", genai.types.Part.from_image( genai.types.Image.from_bytes(image_bytes) )] )

Вариант 2 — Локальное развертывание с помощью Hugging Face

from transformers import AutoModelForCausalLM, AutoProcessor import torch model_id = "google/gemma-4-31B-it" # или более мелкие варианты processor = AutoProcessor.from_pretrained(model_id) model = AutoModelForCausalLM.from_pretrained( model_id, torch_dtype=torch.bfloat16, device_map="auto" ) # Пример многомодального запроса messages = [ {"role": "user", "content": [ {"type": "image", "image": "https://example.com/chart.png"}, {"type": "text", "text": "Опишите тенденции в этой визуализации данных."} ]} ] inputs = processor.apply_chat_template( messages, add_generation_prompt=True, tokenize=True, return_tensors="pt" ).to(model.device) outputs = model.generate(**inputs, max_new_tokens=512) print(processor.decode(outputs[0]))

// Google AI Studio — самый быстрый способ создания прототипов с помощью Gemma 4

Типичные сценарии использования и примеры из реальной жизни

Встроенный инструмент для веб-скрейпинга, анализа данных или сложных многоэтапных автоматизированных рабочих процессов.

Анализ изображений + голос + текст в одной унифицированной модели — сшивание не требуется.

Запускайте мощные модели 2B–4B непосредственно на мобильных устройствах или IoT-оборудовании в полностью автономном режиме.

Окно контекста размером 256 КБ позволяет обрабатывать огромные базы знаний, целые кодовые базы и юридические документы.

Часто задаваемые вопросы

Да — полная лицензия Apache 2.0 с открытыми весами, коммерческое использование полностью разрешено. Без ограничений.

Безусловно. Краевые варианты (2B/4B) работают на телефонах; более крупные — на одном графическом процессоре с квантованием (4-бит/8-бит).

Gemma 4 предлагает аналогичные передовые возможности, но с полной открытостью и акцентом на оптимизацию непосредственно на устройстве.

Интегрируйте Gemma 4 + более 100 лучших моделей — один SDK

Управление множеством моделей, ключей API, ограничений скорости и развертываний отнимает много времени. www.ai.cc предоставляет доступ к Gemma 4, Claude, GPT, Grok, Veo и десяткам других приложений одним щелчком мыши через единый простой SDK.

Авторизоваться

Авторизоваться