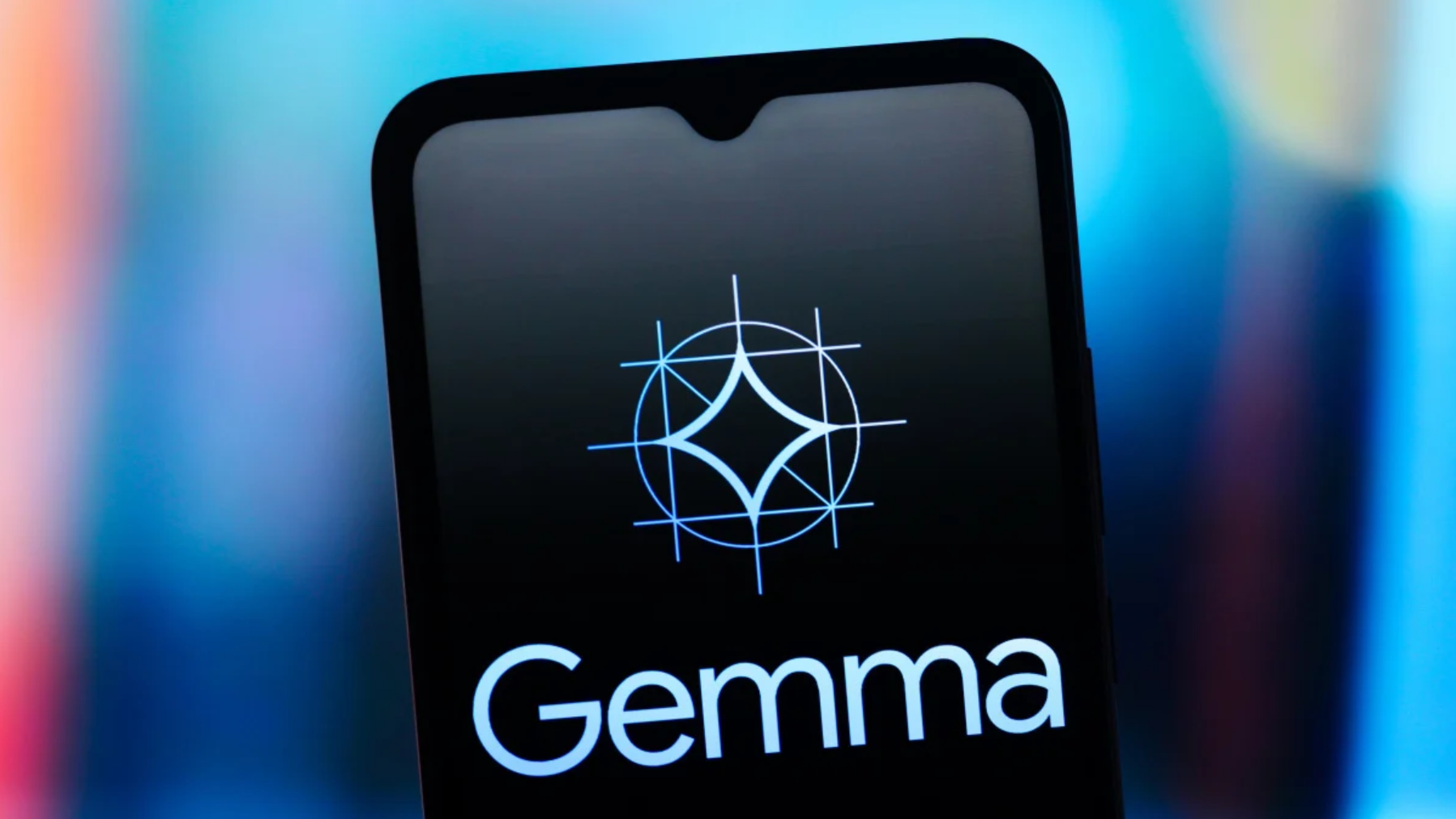

Tutorial Gemma 4: Guia completo para integrar o modelo de IA multimodal de código aberto mais poderoso do Google + integração de API em 2026

Gemma 4: Guia completo para as ferramentas mais poderosas do Google Código aberto Multimodal AI

O Google DeepMind acaba de lançar Gemma 4 — a família de modelos multimodais verdadeiramente de código aberto mais capaz até o momento. Lançada em 2 de abril de 2026 sob um código totalmente permissivo. Licença Apache 2.0O Gemini 4 traz recursos de ponta (desenvolvidos a partir da mesma pesquisa do Gemini 3) para laptops, celulares, Raspberry Pi e GPUs de alto desempenho. Este tutorial prático aborda tudo: variantes do modelo, benchmarks, código real e integração de API.

Variantes do modelo: todos os cenários de implantação

A família Gemma 4 inclui quatro tamanhos otimizados. Todos os modelos suportam entradas multimodais e se destacam em fluxos de trabalho com agentes, chamadas de funções nativas, saída JSON estruturada e raciocínio de contexto extenso.

| Variante do modelo | Parâmetros | Hardware alvo | Janela de contexto | Principais pontos fortes |

|---|---|---|---|---|

| Gemma 4 E2B | ~2B | Dispositivos móveis/de borda | 128 mil | Latência ultrabaixa, no próprio dispositivo |

| Gema 4 E4B | ~4B | Telefones / Raspberry Pi | 128 mil | Multimodal + nativo de áudio |

| Gemma 4 26B A4B | 26B (MoE) | Estações de trabalho / GPUs | 256 mil | Equilíbrio entre velocidade e qualidade |

| Gemma 4 31B | 31B | Servidores de alta gama | 256 mil | Capacidade máxima de raciocínio |

// Arquitetura de IA multimodal: Gemma 4 processa entradas de texto, imagens, áudio e vídeo de forma integrada.

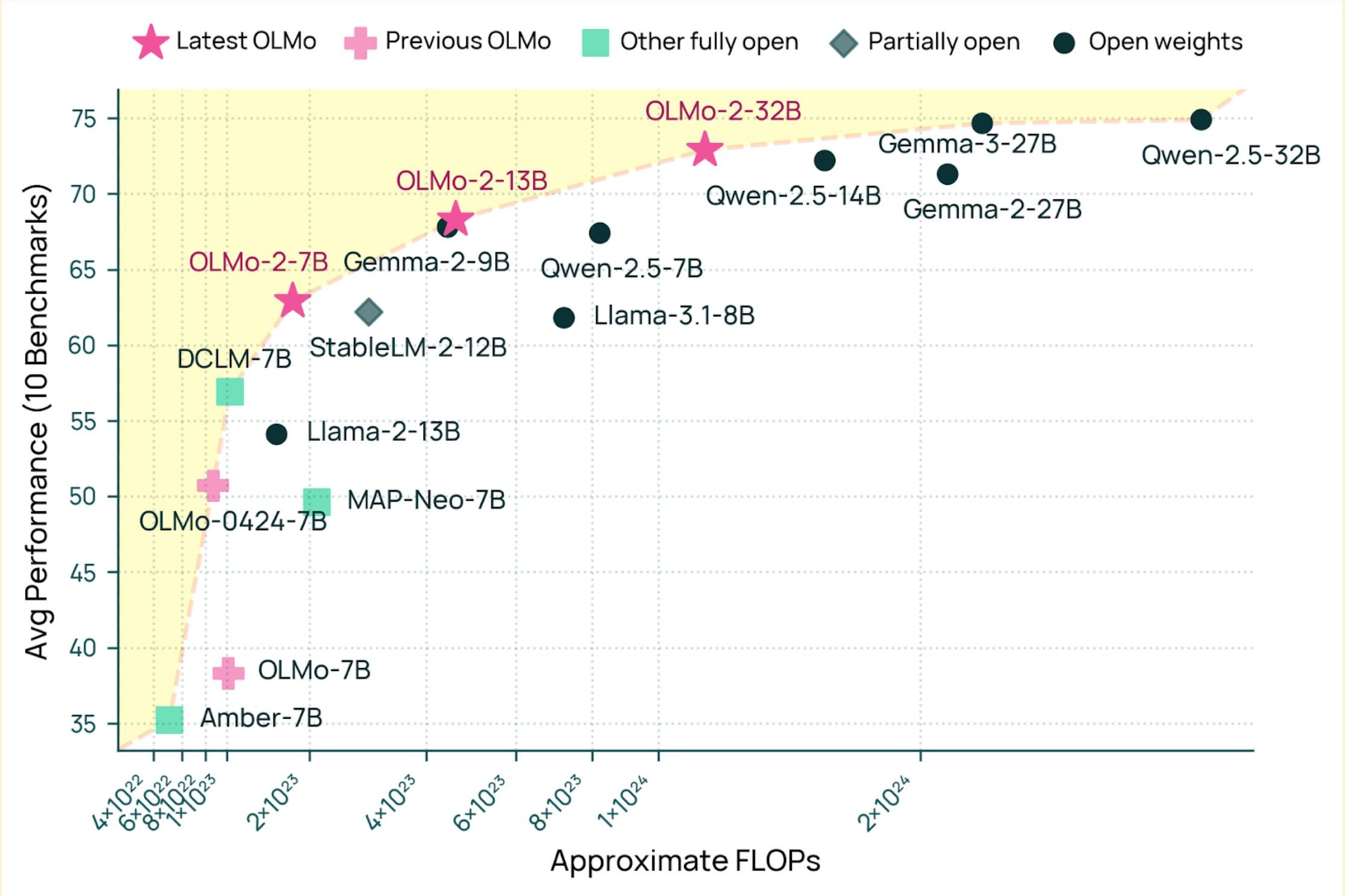

Por que Gemma 4 se destaca: Benchmarks

(Modelo 31B)

Diamante

Banco

Multilíngue

- Multimodal-nativo: Compreenda imagens, clipes de áudio e vídeos juntamente com texto em um único modelo.

- Uso de agentes e ferramentas: Funcionalidades integradas e integração de ferramentas — perfeito para agentes autônomos.

- Desempenho no dispositivo: Funciona offline com latência quase zero em hardware de consumo.

- Contexto longo: Até 256 mil tokens para documentos extensos ou bases de código inteiras.

- Liberdade comercial: A licença Apache 2.0 remove todas as restrições anteriores — implante em qualquer lugar.

// Desempenho do Gemma 4 em comparação com outros modelos de código aberto — FLOPs vs média do benchmark

Tutorial prático de integração de API (Python)

Você tem dois caminhos principais: API Gemini hospedada (mais fácil, recomendado para prototipagem) ou implantação local Via Hugging Face / Ollama para total privacidade.

Opção 1 — Início Rápido da API Gemini

from google import genai # Obtenha sua chave de API gratuita em ai.google.dev client = genai.Client(api_key="SUA_CHAVE_DE_API_GEMINI") response = client.models.generate_content( model="gemma-4-31b-it", # ou gemma-4-26b-a4b-it, etc. contents=[ "Analise esta imagem e explique o gráfico em detalhes.", # Você também pode passar bytes ou URLs da imagem aqui ] ) print(response.text)

Exemplo multimodal — Imagem + Texto

resposta = client.models.generate_content( model="gemma-4-e4b-it", contents=["O que está acontecendo nesta foto?", genai.types.Part.from_image( genai.types.Image.from_bytes(image_bytes) )] )

Opção 2 — Implantação local via Hugging Face

from transformers import AutoModelForCausalLM, AutoProcessor import torch model_id = "google/gemma-4-31B-it" # ou variantes menores processor = AutoProcessor.from_pretrained(model_id) model = AutoModelForCausalLM.from_pretrained( model_id, torch_dtype=torch.bfloat16, device_map="auto" ) # Exemplo de prompt multimodal messages = [ {"role": "user", "content": [ {"type": "image", "image": "https://example.com/chart.png"}, {"type": "text", "text": "Descreva as tendências nesta visualização de dados."} ]} ] inputs = processor.apply_chat_template( messages, add_generation_prompt=True, tokenize=True, return_tensors="pt" ).to(model.device) outputs = model.generate(**inputs, max_new_tokens=512) print(processor.decode(outputs[0]))

// Google AI Studio — a maneira mais rápida de criar protótipos com Gemma 4

Casos de uso comuns e exemplos do mundo real

Ferramenta nativa para extração de dados da web, análise de dados ou fluxos de trabalho de automação complexos com várias etapas.

Análise de imagem + voz + texto em um modelo unificado — sem necessidade de junção de imagens.

Execute modelos robustos de 2B a 4B diretamente em dispositivos móveis ou hardware de IoT, totalmente offline.

A janela de contexto de 256 KB lida com bases de conhecimento massivas, códigos-fonte completos e documentos jurídicos.

Perguntas frequentes

Sim — licença Apache 2.0 completa, com pesos abertos e uso comercial totalmente permitido. Sem restrições.

Com certeza. As variantes Edge (2B/4B) rodam em celulares; as maiores, em uma única GPU com quantização (4 bits/8 bits).

Gemma 4 traz recursos de ponta semelhantes, mas com total abertura e foco na otimização no dispositivo.

Integre Gemma 4 + mais de 100 modelos de sucesso — um único SDK

Gerenciar vários modelos, chaves de API, limites de taxa e implantações consome muito tempo. O www.ai.cc oferece acesso com um clique a Gemma 4, Claude, GPT, Grok, Veo e dezenas de outros modelos por meio de um único SDK simples.

Conecte-se

Conecte-se